내부 신뢰도 분포를 활용한 점진적 보정 강화 학습

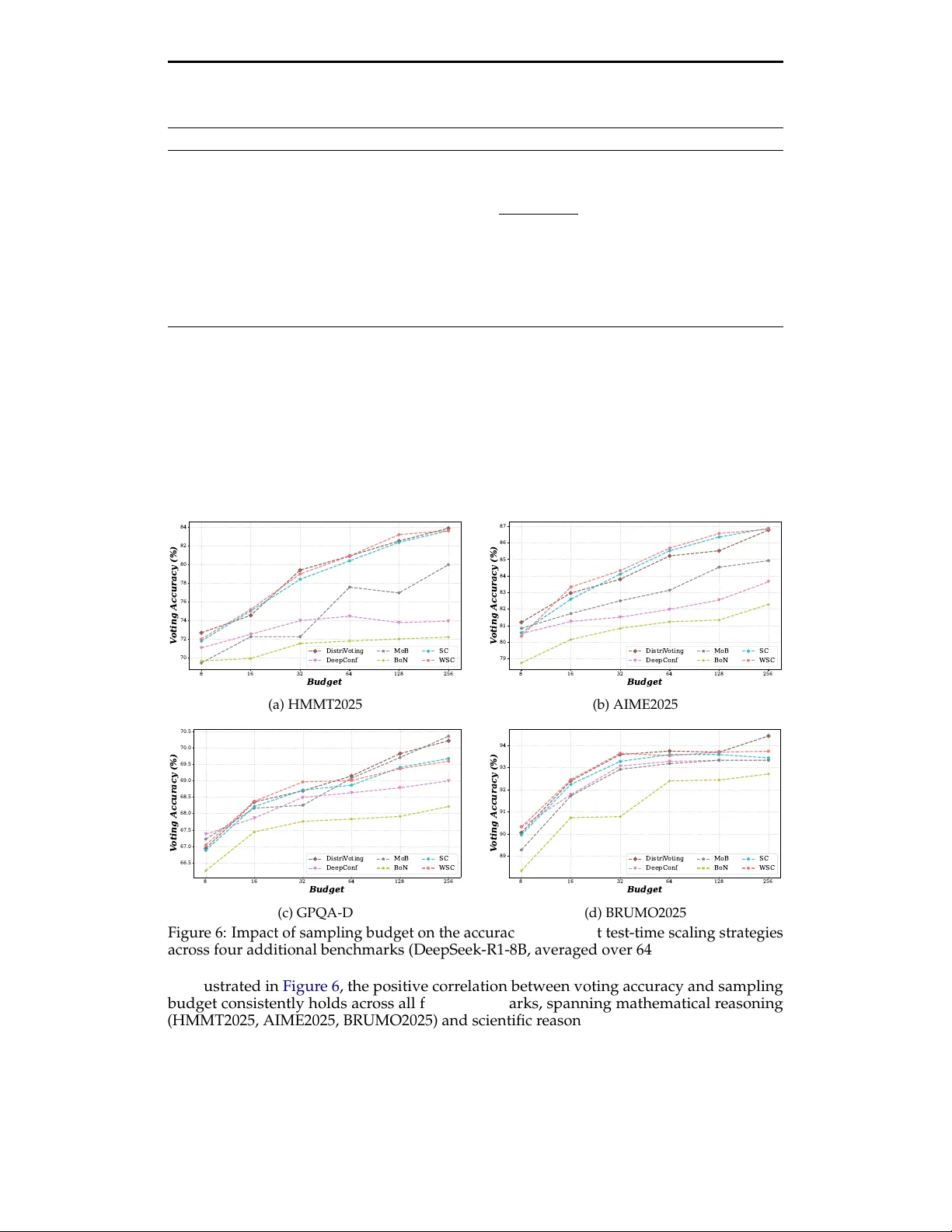

본 논문은 테스트 시점에 모델의 자체 신뢰도 분포를 활용해 보상 신호를 점진적으로 정제하고, 투표 기반 스케일링에서 발생하는 일관성 보상 해킹을 다양성 기반 페널티로 억제하는 DistriTTRL 프레임워크를 제안한다. 실험 결과, 다양한 대형 언어 모델과 수학·코딩·지식 추론 벤치마크에서 기존 방법 대비 성능이 크게 향상됨을 보인다.

저자: Xizhong Yang, Yinan Xia, Huiming Wang

본 연구는 라벨이 없는 테스트‑타임 데이터에서 대형 언어 모델(LLM)의 성능을 향상시키기 위해, 모델 내부에서 생성되는 신뢰도 정보를 자체 보상 신호로 활용하는 강화 학습(RL) 접근법을 제안한다. 기존의 테스트‑타임 트레이닝(TTT) 연구는 주로 다수결 기반 테스트‑타임 스케일링(TTS) 전략을 사용해 여러 샘플 중 가장 빈도가 높은 답을 의사 라벨(pseudo‑label)로 삼고, 이를 보상으로 활용하였다. 그러나 이러한 방법은 두 가지 근본적인 문제를 안고 있다. 첫째, 테스트 단계와 훈련 단계 사이에서 모델 파라미터가 지속적으로 업데이트되면서 내부 신뢰도와 샘플링 분포가 변동(Distribution Shift)한다는 점이다. 둘째, 다수결 투표가 일관된(정답이든 오답이든) 답변을 생성하도록 모델을 유도함으로써 “일관성 보상 해킹”(consistency reward hacking) 현상이 발생한다. 즉, 모델이 정답이 아닌 경우에도 높은 보상을 받기 위해 동일한 오답을 반복 생성하게 된다.

이러한 한계를 극복하고자 저자들은 **DistriTTRL**(Distribution‑guided Test‑time Reinforcement Learning)이라는 프레임워크를 설계하였다. 핵심 아이디어는 모델이 생성한 각 롤아웃(샘플)의 신뢰도 점수를 확률적 분포, 구체적으로는 두 개의 가우시안 컴포넌트를 갖는 Gaussian Mixture Model(GMM)로 모델링하고, 이를 **점진적으로** 축적·보정함으로써 보다 안정적인 “분포 사전”(distribution prior)을 만든 뒤, 이를 기반으로 의사 라벨을 추정한다는 것이다.

### 1. 신뢰도 정의 및 분포 모델링

- **Trajectory Confidence**: 토큰 수준의 로그 확률을 평균화해 문장(또는 답변) 수준의 신뢰도를 C_traj으로 정의한다(식 1).

- **GMM 적용**: 각 쿼리당 G개의 롤아웃에서 얻은 C_traj을 두 개의 정규분포(양성·음성)로 근사한다. 양성 분포는 평균이 높고, 음성 분포는 평균이 낮다(식 2‑6).

### 2. 점진적 분포 구축 및 시프트 보정

- 훈련 단계 k에서 현재 배치의 신뢰도 행렬 C_k와 이전 단계 s(

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기