극단적 비IID 환경을 위한 생성형 원샷 연합 학습 프레임워크

FederatedFactory는 로컬 라벨이 서로 겹치지 않는 단일 클래스 사일로 상황에서 기존 연합 학습이 붕괴되는 문제를 해결한다. 각 클라이언트는 자체 데이터로 학습한 생성 모델(예: EDM2 확산 모델)을 한 번만 전송하고, 서버는 이를 결합해 클래스 균형 합성 데이터를 생성한다. 외부 사전 모델에 의존하지 않으며, 단일 라운드 통신과 정확한 모듈식 삭제를 통해 빠른 학습과 안전한 언러닝을 제공한다. 실험 결과 MedMNIST, ISIC…

저자: Andrea Moleri, Christian Internò, Ali Raza

1. 서론

연합 학습은 데이터 주권을 보장하면서 다수의 클라이언트가 공동으로 모델을 학습하도록 설계되었다. 그러나 기존 이론적 수렴 보장은 데이터가 독립적이며 동일하게 분포(IID)될 때만 성립한다. 실제 의료·금융·법률 등 분야에서는 각 기관이 보유한 라벨이 서로 겹치지 않는 경우가 빈번히 발생한다. 논문은 이러한 상황을 “단일 클래스 사일로(single‑class silo)”라 정의하고, 라벨 지원이 완전히 불연속적일 때 전통적인 가중치 평균 방식(FedAvg 등)이 최적화 경로를 상충시켜 학습이 완전히 붕괴함을 실험과 이론으로 입증한다.

2. 관련 연구

통계적 이질성을 다루는 FedProx, FedDyn, SCAFFOLD 등은 라벨이 겹치는 정도가 어느 정도 존재할 때만 효과적이다. 원샷 연합 학습(OSFL)은 통신 라운드를 최소화하려 하지만, 기존 방법은 사전 학습된 Foundation Model(FM)을 이용해 합성 데이터를 생성한다. 이는 일반 이미지 도메인에서는 유효하지만, 의료 영상처럼 도메인 간 격차가 큰 경우 FM이 제공하는 잠재공간이 실제 데이터와 크게 달라 hallucination 및 bias가 발생한다. 또한, 기존 협업 생성 모델(예: Diffusion Federated Dataset)은 다수 라운드 통신을 필요로 하여 통신 비용이 크게 증가한다.

3. 문제 정의 및 목표

저자는 다음 네 가지 제약을 만족하는 연합 학습 프로토콜을 설계하고자 한다.

- C1: 라벨 지원이 전혀 겹치지 않는 극단적 스큐.

- C2: 외부 사전 모델에 전혀 의존하지 않는 ‘Zero‑Dependency’ 설계.

- C3: 원본 데이터는 절대 전송되지 않는 ‘Strict Sovereignty’.

- C4: 통신 라운드가 정확히 1번인 ‘One‑Shot Communication’.

목표는 이러한 제약 하에서 중앙집중 학습(upper‑bound)과 동등한 성능을 달성하고, 모듈식 언러닝을 지원하는 것이다.

4. 이론적 분석

두 가지 기본 가정을 전제로 한다.

Assumption 1: 각 클라이언트의 생성 모델이 실제 데이터 분포와 KL 다이버전스 ≤ ε_k 로 제한된다.

Assumption 2: 손실 함수 ℓ이 유계 M을 가진다.

Lemma 1은 라벨이 불연속적이므로 전체 합성 분포와 실제 전역 분포 사이의 KL이 ∑π_k ε_k 로 상한이 잡힌다는 것을 증명한다. 이어서 Theorem 1은 합성 데이터에 대해 학습된 판별 모델 w_A와 중앙집중 최적 모델 w_* 사이의 위험 차이가 2M·\bar{ε} 이하임을 보인다. 여기서 \bar{ε}=½∑π_k ε_k이며, 이는 외부 FM에 의해 발생하는 무한대에 가까운 λ 오버랩 오류와는 달리 로컬 생성 모델의 수렴 정도만이 성능을 좌우한다는 강력한 보장을 의미한다.

5. 방법론 – FederatedFactory

연합의 단위를 ‘판별 파라미터’에서 ‘생성 프라이어(θ_k)’로 전환한다. 각 클라이언트는 자체 데이터 D_k에 대해 독립적으로 생성 모델을 학습한다. 구현에서는 EDM2 기반 확산 모델을 사용했으며, 이는 고품질 의료 영상 합성에 적합한 고해상도 복원을 제공한다.

두 가지 운영 모드가 제시된다.

(A) 중앙집중 모드: 신뢰할 수 있는 서버가 모든 θ_k를 수집해 하나의 ‘생성 라이브러리 Θ’를 구성한다. 서버는 표준 정규 잠재공간 Z∼N(0,I)에서 각 클래스별로 샘플링하고, G_{θ_k}를 통해 이미지로 변환해 클래스 균형 합성 데이터셋을 만든다.

(B) P2P 메쉬 모드: 중앙 서버가 없을 경우, 각 클라이언트가 서로의 θ_k를 교환해 로컬에서 합성 데이터를 생성한다. 이때 통신 비용은 여전히 클라이언트당 파라미터 하나만 전송하면 된다.

생성된 합성 데이터는 기존 판별 모델 학습 파이프라인에 그대로 투입될 수 있다. 또한, 특정 클라이언트의 θ_k를 삭제하면 해당 클래스에 대한 합성 데이터가 사라지므로, ‘모듈식 언러닝’이 즉시 구현된다.

6. 실험

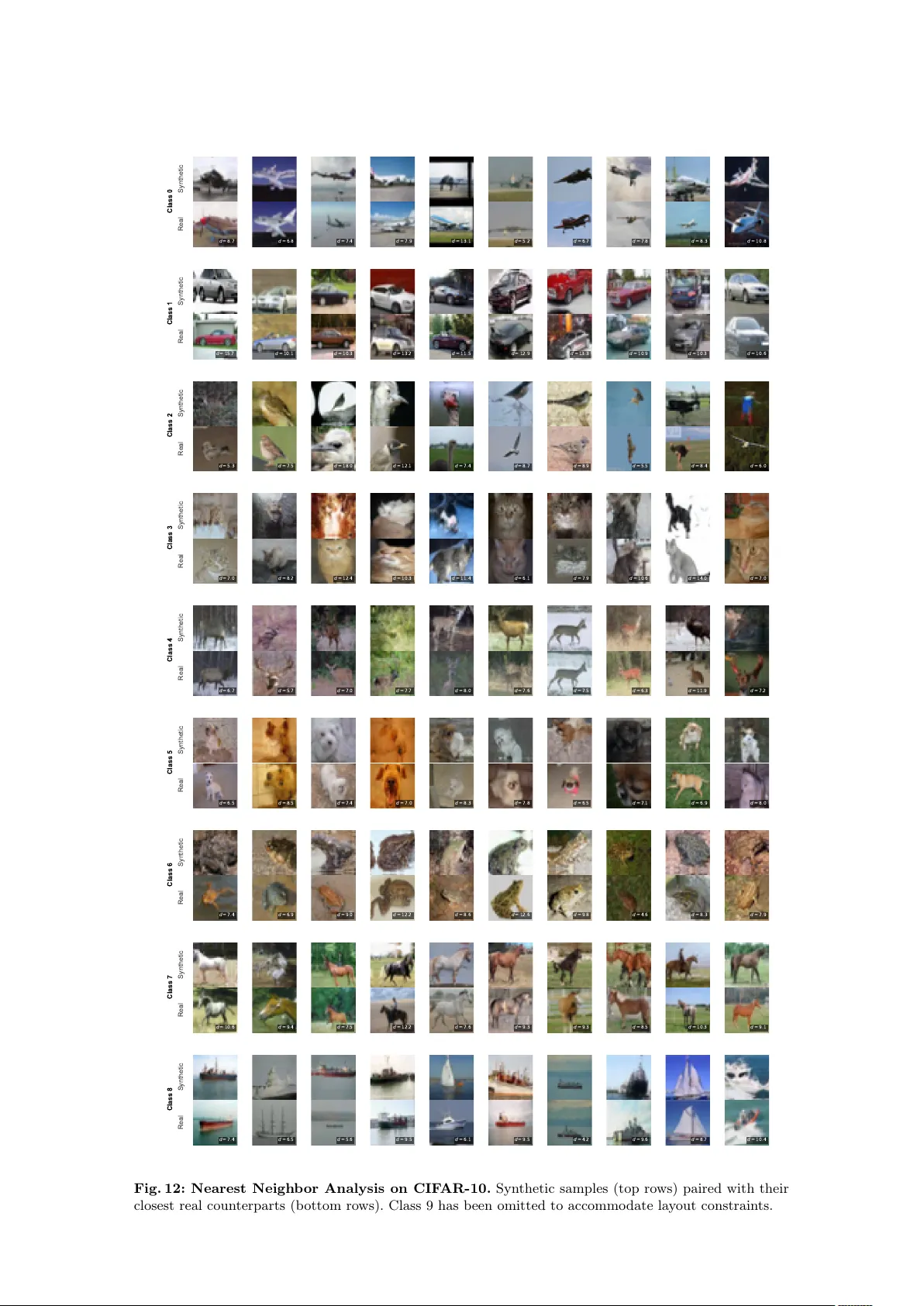

데이터셋: MedMNIST(다양한 의료 영상), ISIC2019(피부암), CIFAR‑10(일반 이미지). 각 데이터셋을 K=10개의 클라이언트에 할당하고, 각 클라이언트는 오직 하나의 클래스만 보유하도록 구성해 단일 클래스 사일로를 시뮬레이션했다.

비교 방법: FedAvg, FedProx, FedDyn, FedAvg+FM(Stable Diffusion 기반 합성), 기존 OSFL(외부 FM 사용) 등.

주요 결과:

- CIFAR‑10에서 기존 FL은 11.36 % 정확도에 머물렀으나, FederatedFactory는 90.57 %를 달성, 중앙집중 학습(92.1 %)에 근접.

- ISIC2019에서는 AUROC 47.31 % → 90.57 %로 회복, 의료 영상에서의 실용성을 입증.

- MedMNIST에서도 평균 정확도 88.3 % (central) 대비 86.9 % (FederatedFactory)로 미세 차이만 보였다.

Ablation: ε_k를 인위적으로 증가시킨 경우 성능이 선형적으로 감소함을 확인했으며, 생성 모델의 파라미터 크기와 통신량 사이의 trade‑off도 분석했다.

언러닝 실험: 특정 클라이언트(예: 클래스 ‘dog’)의 θ_k를 삭제한 후 재학습 없이 바로 평가했을 때, 해당 클래스에 대한 정확도가 0 %가 되면서도 다른 클래스 성능은 유지되는 것을 확인했다.

7. 논의 및 한계

- 장점: 외부 FM에 의존하지 않아 도메인 편향이 없으며, 단일 라운드 통신으로 비용이 최소화된다. 모듈식 언러닝으로 규제 요구에 즉각 대응 가능.

- 제한점: 각 클라이언트가 충분히 복잡한 생성 모델을 학습할 연산 자원과 메모리가 필요하다. 데이터가 극히 적은 경우 ε_k가 커져 성능 저하 위험이 있다. 또한, 생성 모델 자체가 비밀스러운 파라미터이므로 보안 측면에서 추가적인 암호화·검증 메커니즘이 필요할 수 있다.

8. 결론 및 향후 연구

FederatedFactory는 ‘생성‑우선’ 연합 학습이라는 새로운 패러다임을 제시하며, 특히 라벨이 전혀 겹치지 않는 고보안·고민도 환경에서 중앙집중 학습 수준의 성능을 달성한다. 향후 연구에서는 경량화된 생성 모델 설계, 차등 프라이버시와 결합한 보안 강화, 그리고 비동기식 P2P 환경에서의 안정성 분석 등을 진행할 계획이다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기