편향 압축을 활용한 그래디언트 코딩 기반 분산 학습

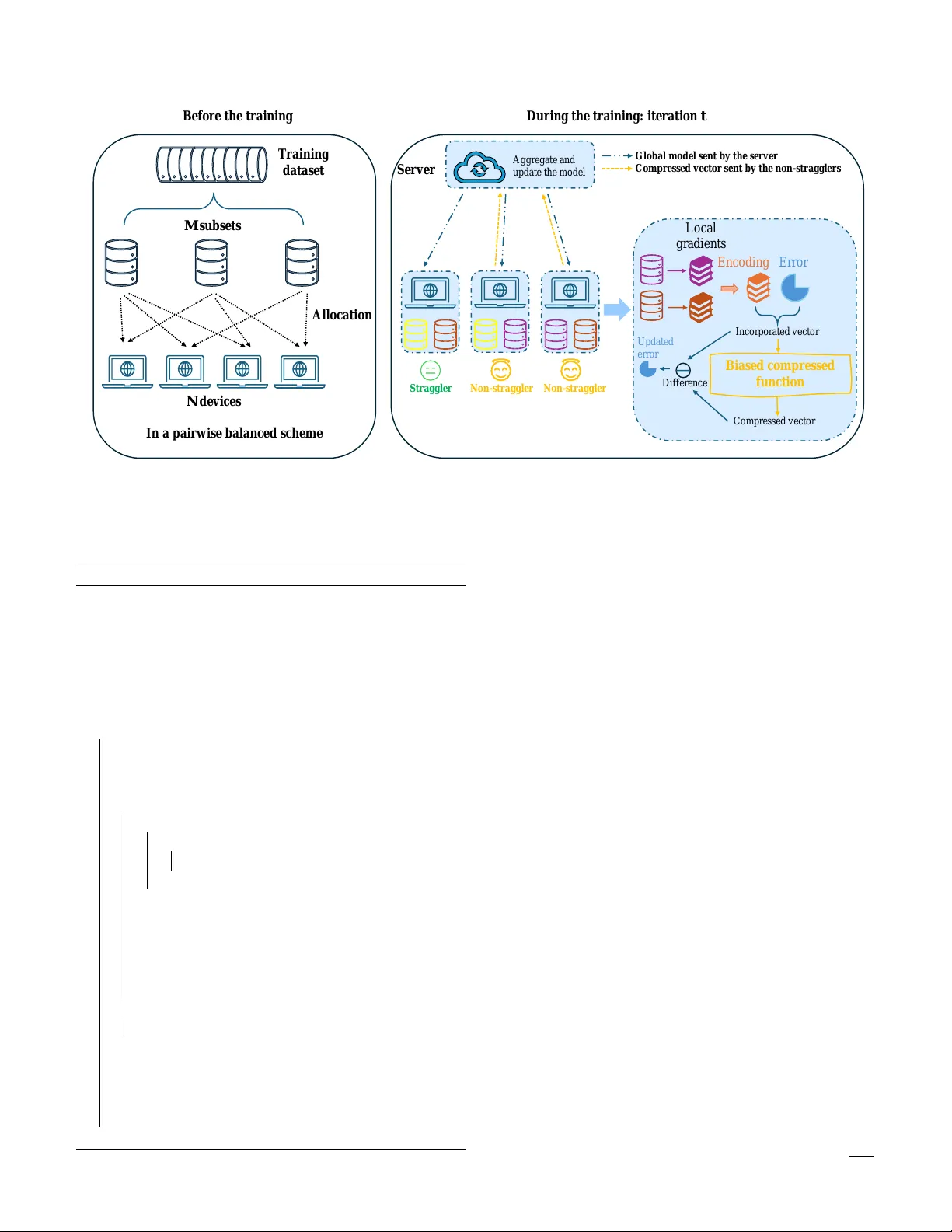

본 논문은 스트래글러와 통신 병목 현상을 동시에 완화하기 위해 편향 압축과 오류 피드백을 결합한 새로운 분산 학습 프레임워크 COCO‑EF를 제안한다. 데이터는 쌍별 균형 방식으로 중복 할당되고, 비스트래글러 디바이스는 로컬 그래디언트를 편향 압축 후 오류 피드백을 적용해 전송한다. 서버는 압축된 메시지를 복원해 전역 그래디언트를 근사하고, 이론적으로 O(1/√T) 수렴률을 보장한다. 실험 결과는 기존 무편향 압축 기반 방법보다 높은 정확도와 …

저자: Chengxi Li, Ming Xiao, Mikael Skoglund

본 논문은 분산 학습(Distributed Learning, DL) 시스템에서 두 가지 실질적인 제약, 즉 통신 병목 현상과 스트래글러(straggler) 문제를 동시에 해결하고자 하는 새로운 프레임워크 COCO‑EF(Compressed Gradient Coding with Error Feedback)를 제안한다. 기존 연구는 주로 무편향 압축(unbiased compression)이나 스트래글러 완화를 위한 그래디언트 코딩(gradient coding)에 초점을 맞추었으며, 편향 압축(biased compression)의 잠재적 이점을 충분히 활용하지 못했다. 편향 압축은 압축 후 평균이 원본과 일치하지 않아 직접 사용하면 수렴 보장이 어려우나, 오류 피드백(error feedback) 메커니즘을 결합하면 이전 반복에서 발생한 압축 오차를 현재 그래디언트에 누적시켜 편향을 상쇄할 수 있다.

**1. 문제 정의와 시스템 모델**

N개의 디바이스와 중앙 서버가 협업하여 전체 데이터셋 W={W₁,…,W_M}를 학습한다. 목표는 전체 손실 F(θ)=∑_{k=1}^M f_k(θ)를 최소화하는 파라미터 θ를 찾는 것이다. 각 디바이스는 사전에 정해진 방식으로 데이터 서브셋을 중복 할당받으며, 스트래글러가 발생하면 해당 디바이스는 현재 라운드에 참여하지 않는다. 스트래글러 발생 확률 p는 독립적으로 각 라운드와 디바이스마다 동일하게 가정한다.

**2. COCO‑EF 알고리즘**

- **데이터 할당**: 쌍별 균형(pairwise balanced) 방식으로 서브셋을 중복 배치한다. 이는 각 서브셋이 d_k개의 디바이스에 할당되고, 두 서브셋이 동시에 할당되는 디바이스 수가 d_{k₁}d_{k₂}/N이 되도록 설계한다.

- **로컬 그래디언트 계산 및 코딩**: 비스트래글러 디바이스 i는 자신이 보유한 서브셋 S_i에 대해 ∇f_k(θ_t)를 계산하고, g_t^i = Σ_{k∈S_i} (1/(d_k(1-p))) ∇f_k(θ_t) 로 코딩한다. 이는 기존 그래디언트 코딩에서 사용되는 선형 결합 형태와 동일하지만, 스트래글러 확률 p를 보정한다.

- **오류 피드백 및 편향 압축**: 각 디바이스는 이전 라운드에서 저장한 오류 벡터 e_t^i 를 현재 코딩 벡터에 더하고, 편향 압축 연산 C(·)를 적용한다. ˆg_t^i = C(γ g_t^i + e_t^i) 로 압축된 메시지를 생성한다. 여기서 γ는 학습률이며, C는 그룹화된 사인 비트 양자화, Top‑K 등 편향 압축 함수 중 하나이다.

- **서버 복원 및 모델 업데이트**: 서버는 비스트래글러들로부터 ˆg_t^i 를 수신하고, 사전에 정의된 복원 행렬을 이용해 전역 그래디언트의 근사값 \tilde{∇}F(θ_t) 를 계산한다. 이후 θ_{t+1}=θ_t - η \tilde{∇}F(θ_t) 로 모델을 업데이트한다.

- **오류 업데이트**: 각 디바이스는 압축 과정에서 발생한 오차 e_{t+1}^i = γ g_t^i + e_t^i - C(γ g_t^i + e_t^i) 를 저장한다.

**3. 이론적 수렴 분석**

편향 압축 함수 C가 압축 부등식 ‖C(x)-x‖² ≤ (1-δ)‖x‖² (0<δ≤1)를 만족한다고 가정한다. 또한 손실 함수 F가 L‑smooth하고, 각 미니배치 그래디언트의 분산이 bounded하다고 가정한다. 이러한 가정 하에, 오류 피드백을 포함한 전체 시스템은 기대값 관점에서 무편향 압축과 동일한 수렴 특성을 보인다. 논문은 고정 학습률 η와 γ에 대해 다음과 같은 수렴 경계식을 도출한다:

\

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기