35B MoE 모델에서 SAE‑디코드된 벡터로 행동을 한 축으로 조정하기

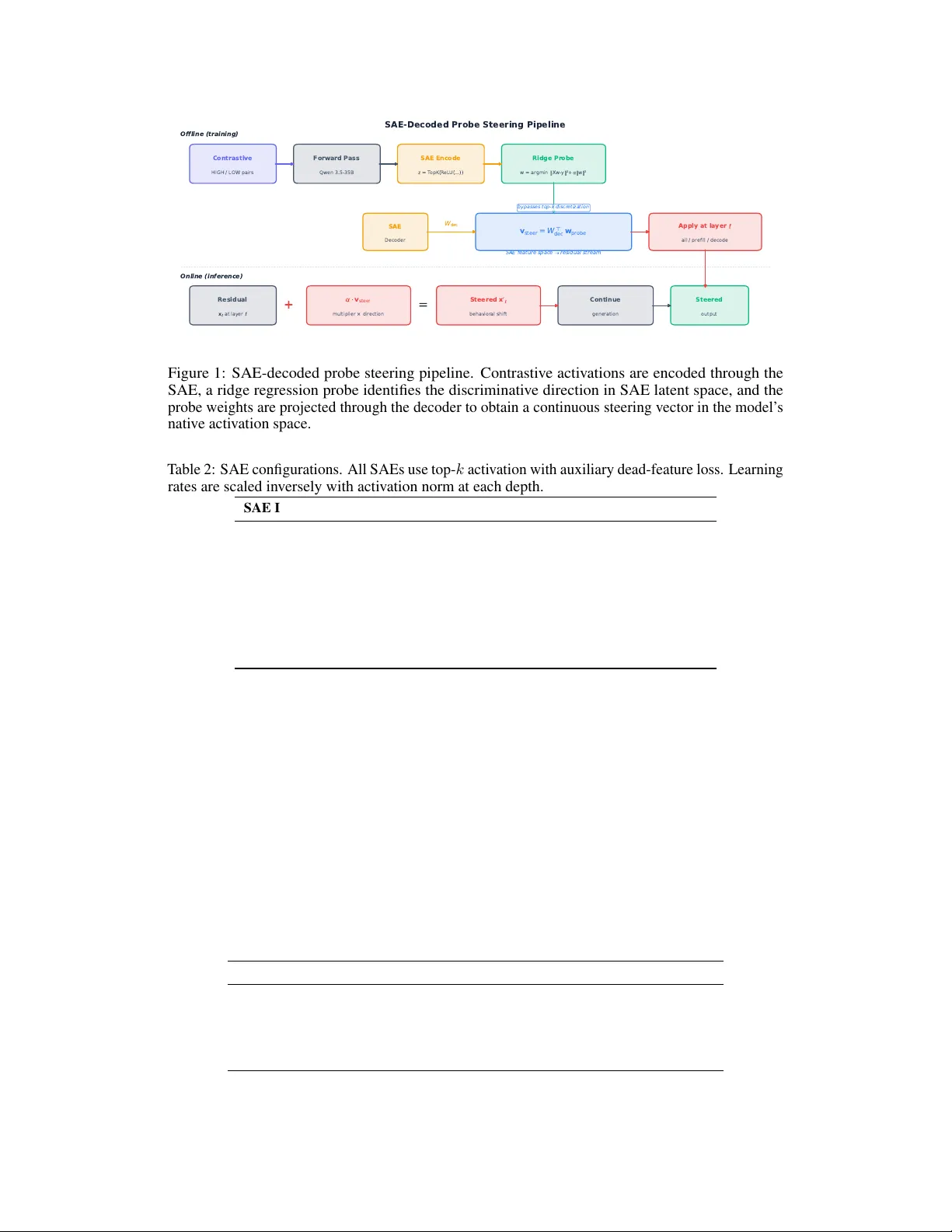

본 연구는 35 억 파라미터 Mixture‑of‑Experts 언어모델 Qwen 3.5‑35B‑A3B에 9개의 Sparse Autoencoder를 학습시켜, SAE 잠재공간에서 선형 프로브를 훈련하고 이를 디코더를 통해 원래 잔차 스트림으로 투사함으로써 5가지 에이전트 행동 특성을 조정한다. 실험 결과, ‘자율성’ 스티어링이 가장 강력하게 작용해 Cohen’s d = 1.01을 기록했으며, 모든 특성의 벡터가 사실상 동일한 ‘행동 독립성 대 사…

저자: Jia Qing Yap

본 논문은 35 억 파라미터 규모의 Mixture‑of‑Experts 언어모델 Qwen 3.5‑35B‑A3B에 Sparse Autoencoder(SAE)를 적용해 모델 내부 표현을 해석하고, 이를 기반으로 행동을 직접 조정하는 방법을 제시한다. 연구자는 총 9개의 SAE를 모델의 잔차 스트림에 서로 다른 깊이와 레이어 유형(DeltaNet과 Attention)에서 학습시켰으며, 각 SAE는 top‑k 활성화와 dead‑feature 보조 손실을 사용해 2 384 ~ 16 384 차원의 사전을 구성한다.

다음으로 ‘자율성’, ‘툴 사용 열망’, ‘지속성’, ‘위험 보정’, ‘복종’이라는 다섯 가지 에이전트 행동 특성을 정의하고, 각 특성에 대해 HIGH/LOW 프롬프트 쌍을 1 520개 생성해 대비적 활성화를 측정했다. 각 특성마다 가장 큰 평균 |TAS|를 보인 SAE를 선택하고, 해당 SAE의 잠재벡터에 대해 Ridge 회귀 프로브를 학습한다. 프로브 가중치 w_probe를 SAE 디코더 W_dec에 전치(transpose)하여 연속 스티어링 벡터 v_steer = W_decᵀ w_probe 를 얻는다. 이 과정은 SAE의 top‑k 이산화를 우회해 미세한 방향성을 유지한다는 장점이 있다.

스티어링은 잔차 스트림에 α·v_steer 를 더하는 방식으로 적용했으며, all_positions, prefill_only, decode_only 세 가지 모드와 α ∈ {1,2,3} 를 실험했다. 결과는 ‘자율성’ 스티어링이 가장 강력했으며, α = 2 (all_positions)에서 ask_user 호출 비율을 78 %→12 %로 감소시키고, 프로액티브 툴 호출을 0.30→2.10으로 증가시켜 Cohen’s d = 1.01을 달성했다. 툴 사용 열망은 α = 3에서 급격히 변해 웹 검색 호출이 주를 이루는 새로운 행동 모드로 전환되었으며, 복종은 프리필 단계에서만 적용했을 때 효과가 가장 컸다. 지속성과 위험 보정은 프로브 R²가 낮거나 높은데도 실제 스티어링 효과가 미미했으며, 특히 위험 보정은 높은 R²(0.795)에도 불구하고 벡터가 행동에 거의 영향을 주지 않아 프로브 정확도와 인과적 영향 사이의 차이를 보여준다.

특히 모든 특성의 스티어링 벡터가 동일한 ‘행동 독립성 대 사용자 의존성’ 축에 정렬된다는 단일 축 현상을 발견했다. 이는 다차원 행동 특성이 실제로는 하나의 잠재적 ‘에이전시’ 차원에 의해 주도된다는 가설을 뒷받침한다. 툴 사용 특성은 이 축 위에서 부수적인 변형(툴 종류 비중, dose‑response 형태)만을 추가한다.

또한 디코딩 단계에서만 스티어링을 적용하면 효과가 없다는 통계적 결과(p > 0.35)를 통해, GatedDeltaNet 기반의 선형 재귀 레이어가 프리필 단계에서 행동 결정을 내리고 이를 이후 토큰 생성에 전달한다는 인과적 메커니즘을 제시한다. 이는 기존 Transformer‑기반 모델에서 관찰된 ‘프롬프트 단계’와는 다른 동역학을 암시한다.

결론적으로, 이 연구는 (1) 대규모 MoE 모델에 SAE‑디코드 스티어링을 성공적으로 적용, (2) 행동 특성이 단일 주축에 귀결된다는 새로운 구조적 통찰, (3) 프로브와 인과적 효과 사이의 차이를 실험적으로 입증, (4) 프리필 단계가 행동 결정의 핵심이라는 아키텍처‑특정 인과관계를 제시한다는 점에서 메커니즘 해석 연구에 중요한 기여를 한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기