대형 추론 모델의 비밀 비판 메커니즘 해독

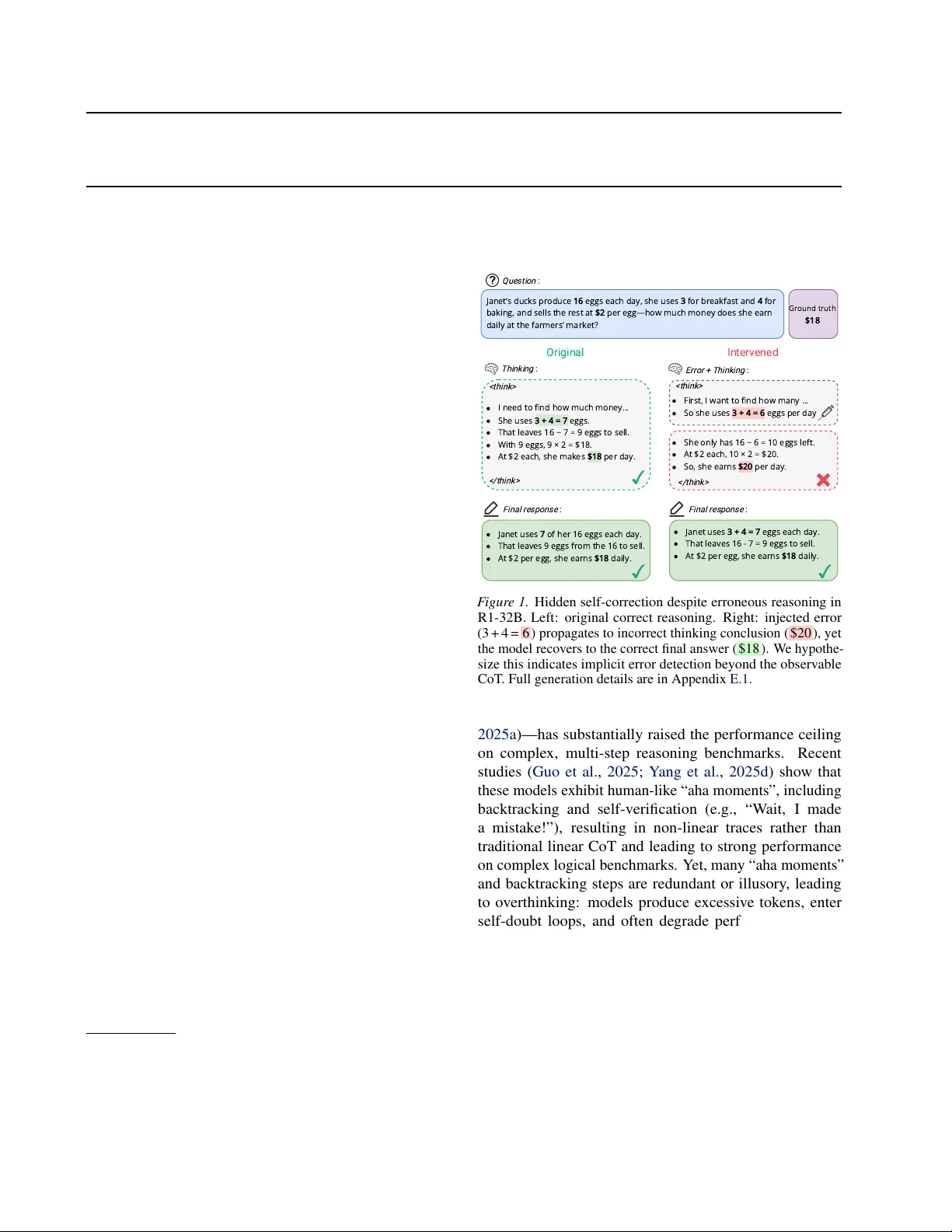

본 논문은 대형 추론 모델(LRM)이 체인‑오브‑생각(COT) 중에 삽입된 산술 오류를 스스로 감지하고, 명시적 수정 없이 최종 답을 올바르게 도출하는 ‘숨겨진 비판 능력’(hidden critique ability)을 발견한다. 활성화 공간에서 오류‑복구와 정상 실행 사이의 선형 구분이 가능함을 보이고, 두 평균 활성화 차이로 정의한 ‘비판 벡터’를 추출한다. 이 벡터를 이용해 잠재 표현을 스티어링하면 오류 감지 성능이 향상되고, 테스트‑타임…

저자: Hoang Phan, Quang H. Nguyen, Hung T. Q. Le

본 논문은 대형 추론 모델(Large Reasoning Models, LRM)이 복잡한 논리 문제를 해결할 때 보이는 “뒤로 돌아가기(backtracking)”와 “자기 검증(self‑verification)” 현상이 실제로 모델 내부에 내재된 오류 감지 메커니즘에 기반하는지를 체계적으로 조사한다. 이를 위해 저자들은 두 단계로 구성된 실험 프레임워크를 설계하였다. 첫 번째 단계에서는 기존 데이터셋(GSM8K, Math500)에서 각 질문마다 하나의 산술 오류를 인위적으로 삽입한다. 오류 삽입은 GPT‑5를 활용한 프롬프트(P_err)를 통해 자동화했으며, 삽입된 오류는 생각 단계(think token 이후)에서 바로 나타난다. 두 번째 단계에서는 다양한 규모와 아키텍처를 가진 오픈소스 LRM(DeepSeek‑R1 8B/14B/32B, Qwen3‑4B)을 사용해 오류가 포함된 사고 흐름을 그대로 이어가게 하고, 최종 답변이 정답과 일치하는지를 평가한다.

실험 결과는 두드러진 두 현상을 보여준다. 첫 번째는 “생각 단계와 답변 단계가 일치하는 경우”가 대부분이지만, 두 번째는 “생각 단계에 오류가 남아 있음에도 최종 답변이 정답인 경우”가 상당히 빈번하게 발생한다는 점이다. 구체적으로 R1‑32B 모델은 GSM8K‑Error에서 전체 샘플 중 약 42 %가 생각 단계는 틀리지만 답변은 맞는 상황을 보였으며, Math500‑Error에서도 41 % 정도가 동일한 패턴을 나타냈다. Qwen3‑4B는 명시적 오류 수정(backtracking) 비율이 더 높아 (GSM8K‑Error에서 37 % ~ 41 %), 하지만 여전히 19 % ~ 25 % 정도에서 숨겨진 복구가 일어났다. 이는 모델이 내부적으로 오류를 감지하고, 해당 정보를 최종 출력 단계에만 반영한다는 강력한 가설을 뒷받침한다.

다음으로 저자들은 이러한 현상이 단순한 우연이 아니라 구조적인 메커니즘에 기반한다는 것을 증명하기 위해 활성화 공간을 분석했다. 오류‑복구가 일어난 실행과 정상 실행 사이의 평균 활성화 벡터 차이를 계산하고, 이를 ‘비판 벡터(critique vector)’로 정의하였다. 이 벡터는 여러 레이어와 토큰 위치에 걸쳐 일관된 방향성을 보였으며, Logit Lens를 이용한 시각화 결과, 비판 벡터가 “오류 여부 판단”과 “정답 선택”에 직접적인 영향을 미치는 선형 변환임을 확인했다.

비판 벡터를 활용한 스티어링 실험에서는 두 가지 조작을 수행했다. 첫 번째는 양의 스케일링(positive steering)으로 비판 벡터를 강화해 모델의 오류 감지 능력을 높이는 것이었다. 이 경우 오류 감지 정확도가 평균 12 % ~ 15 % 상승했으며, 최종 정답률도 4 % ~ 7 % 향상되었다. 두 번째는 음의 스케일링(negative steering)으로 비판 벡터를 억제했을 때, 오류 감지 성능이 급격히 저하되고 정답률이 3 % ~ 5 % 감소했다.

또한 테스트‑타임 스케일링(test‑time scaling)과의 결합 효과를 검증했다. 기존 연구는 “추론 단계에 추가 연산을 할당하면 성능이 향상된다”고 주장했지만, 그 효과는 모델의 자체 검증 능력에 크게 좌우된다고 지적했다. 본 논문은 비판 벡터를 강화한 상태에서 테스트‑타임 스케일링을 적용하면, 동일한 연산량에서도 기존 방식보다 높은 정확도를 달성한다는 것을 실험적으로 입증했다. 이는 비판 능력이 테스트‑타임 스케일링의 핵심 동인임을 시사한다.

결론적으로, 이 연구는 (1) LRM이 명시적 사고 흐름과는 별개로 숨겨진 오류 감지 메커니즘을 보유하고 있음을 실증, (2) 해당 메커니즘을 단일 선형 방향(비판 벡터)으로 추출하고 해석 가능하게 만들었으며, (3) 비판 벡터를 조작함으로써 추가 학습 없이도 모델의 비판 능력과 전체 성능을 향상시킬 수 있음을 보여준다. 이러한 발견은 LLM의 신뢰성 강화, 자동 오류 교정, 비용 효율적인 추론 최적화 등 향후 연구와 실용 시스템 설계에 중요한 기반을 제공한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기