뇌전도 표현 학습의 새로운 패러다임 Laya

Laya는 EEG 데이터에 대한 대규모 사전학습 모델로, 기존의 신호 재구성 기반 SSL 대신 LeJEP A라는 잠재 예측 프레임워크를 적용하였다. 잠재 공간에서 마스크된 구간을 예측하고, SIGReg 정규화를 통해 표현 붕괴를 방지한다. 실험 결과, 선형 프로빙에서 재구성 기반 베이스라인보다 일관되게 높은 정확도를 보이며, 특히 잡음에 강인한 특성을 나타낸다.

저자: Saarang Panchavati, Uddhav Panchavati, Corey Arnold

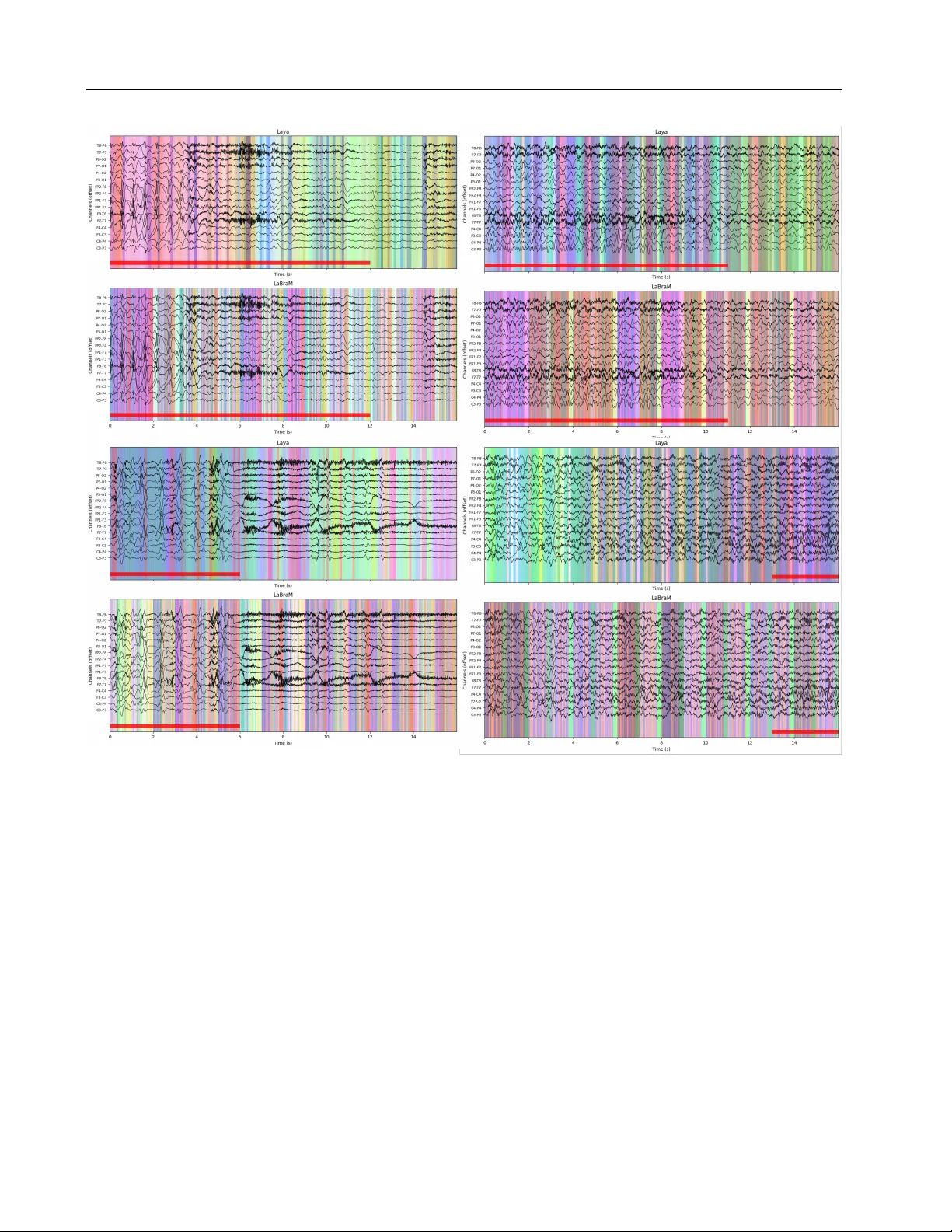

본 논문은 EEG 분야에서 대규모 사전학습 기반의 foundation model이 직면한 핵심 문제를 재조명하고, 이를 해결하기 위한 새로운 학습 프레임워크인 Laya를 제안한다. 기존의 EEG‑foundation 모델들은 LaBraM, LUNA, CBraMod, REVE 등과 같이 대규모 비지도 데이터에 대해 마스크드 토큰 예측이나 신호 재구성 목표를 사용해 사전학습을 수행했지만, 실제 벤치마크에서는 선형 프로빙 성능이 낮고, 전이 학습 시 과도한 파인‑튜닝이 필요하다는 한계를 보였다. 이러한 현상의 원인으로 저자들은 ‘신호 재구성’ 목표가 EEG의 고변동성 잡음(전극 접촉 불량, 눈 깜빡임, 근육 전기활동 등)을 그대로 학습하게 만들며, 의미 있는 뇌 활동 패턴을 압축하는 데 비효율적이라고 주장한다.

이에 대한 대안으로 Joint Embedding Predictive Architectures(JEPA)를 도입한다. JEPA는 입력을 서로 다른 뷰(예: 마스크된 구간과 비마스크된 구간)로 변환하고, 한 뷰의 임베딩을 통해 다른 뷰의 임베딩을 예측하도록 학습한다. 이는 원시 신호가 아니라 ‘잠재 공간’에서의 예측을 목표로 함으로써, 잡음이 높은 차원은 무시하고 예측 가능한 구조만을 강조한다. 그러나 기존 JEPA 구현에서는 표현 붕괴를 방지하기 위해 stop‑gradient, EMA teacher 등 복잡한 메커니즘을 도입해야 했으며, 이는 최적화와 해석을 어렵게 만들었다.

Laya는 이러한 문제를 LeJEP A(LeCun & Balestriero, 2025)와 SIGReg(스케치된 등방성 가우시안 정규화)를 결합해 해결한다. LeJEP A는 여러 뷰의 임베딩을 동시에 고려하고, 배치 내 임베딩이 등방성 가우시안 분포를 따르도록 정규화한다. SIGReg는 랜덤 1‑D 프로젝션을 이용해 배치 차원에서 가우시안성 검정을 수행하고, 이를 손실에 포함시켜 표현이 한 방향으로 수축하거나 붕괴되는 현상을 방지한다. 이 접근법은 단일 하이퍼파라미터 λ만으로 안정적인 학습을 가능하게 하며, 복잡한 teacher‑student 구조를 제거한다.

모델 아키텍처는 크게 세 부분으로 구성된다. 첫 번째는 1‑D 컨볼루션 기반 패치 임베더로, 각 채널을 독립적으로 처리해 시간 축을 일정 길이(P)로 나누고, 각 패치를 E 차원의 벡터로 변환한다. 두 번째는 동적 채널 믹서로, LUNA에서 제안된 학습 가능한 쿼리와 교차‑어텐션 메커니즘을 활용한다. 전극 좌표를 Fourier 특성으로 인코딩해 채널 임베딩에 더함으로써, 전극 배열에 대한 의존성을 최소화하면서도 공간적 관계를 학습한다. 세 번째는 마스크된 시퀀스를 예측하는 예측기이다. 전체 시퀀스와 마스크된 시퀀스를 각각 Encoder에 통과시켜 Z와 Z_ctx를 얻고, Z는 stop‑gradient를 적용해 타깃 T로 사용한다. Z_ctx는 Projector와 Predictor를 거쳐 ˆT를 생성하고, MSE 손실을 통해 ˆT와 T

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기