오디오·비디오 공동 생성의 새로운 지평: 확산 모델과 순차 파이프라인

본 논문은 13시간 분량의 게임 클립과 64시간 분량의 콘서트 영상을 포함한 두 개의 고품질 오디오‑비디오 데이터셋을 공개하고, 이를 기반으로 MM‑Diffusion을 처음부터 학습시켜 시·청각적 일관성을 입증한다. 또한 사전 학습된 영상·음성 인코더‑디코더를 활용한 공동 잠재 확산의 한계를 분석하고, 텍스트‑투‑비디오 모델과 텍스트‑투‑오디오 모델을 순차적으로 결합하는 두 단계 파이프라인을 제안한다. 실험 결과, 순차 파이프라인이 단일 통합 …

저자: Alej, ro Paredes La Torre

본 논문은 오디오와 비디오를 동시에 생성하는 멀티모달 확산 모델의 현주소와 한계를 진단하고, 새로운 데이터셋과 모델링 전략을 제시한다. 서론에서는 최근 이미지·비디오·오디오 분야에서 확산 모델이 차지하는 비중을 강조하며, 기존 연구가 주로 단일 모달리티에 집중해 왔음을 지적한다. 특히, MM‑Diffusion과 그 변형들이 교차‑어텐션을 통해 두 모달리티를 동기화하려 했지만, 고품질·고해상도 데이터가 부족하고, 학습 비용이 크게 요구된다는 문제점을 제시한다.

관련 연구 파트에서는 이미지·비디오·오디오 각각에 대한 최신 확산 모델(Stable Video Diffusion, Sora, AudioLDM, MusicGen 등)을 정리하고, 멀티모달 확산의 대표적 접근인 MM‑Diffusion, Any‑to‑Any, UniForm, AV‑DiT 등을 비교한다. 이 과정에서 각 방법이 라티스 공간 설계, 교차‑어텐션 구조, 그리고 학습 전략에서 차별화된 점을 설명한다.

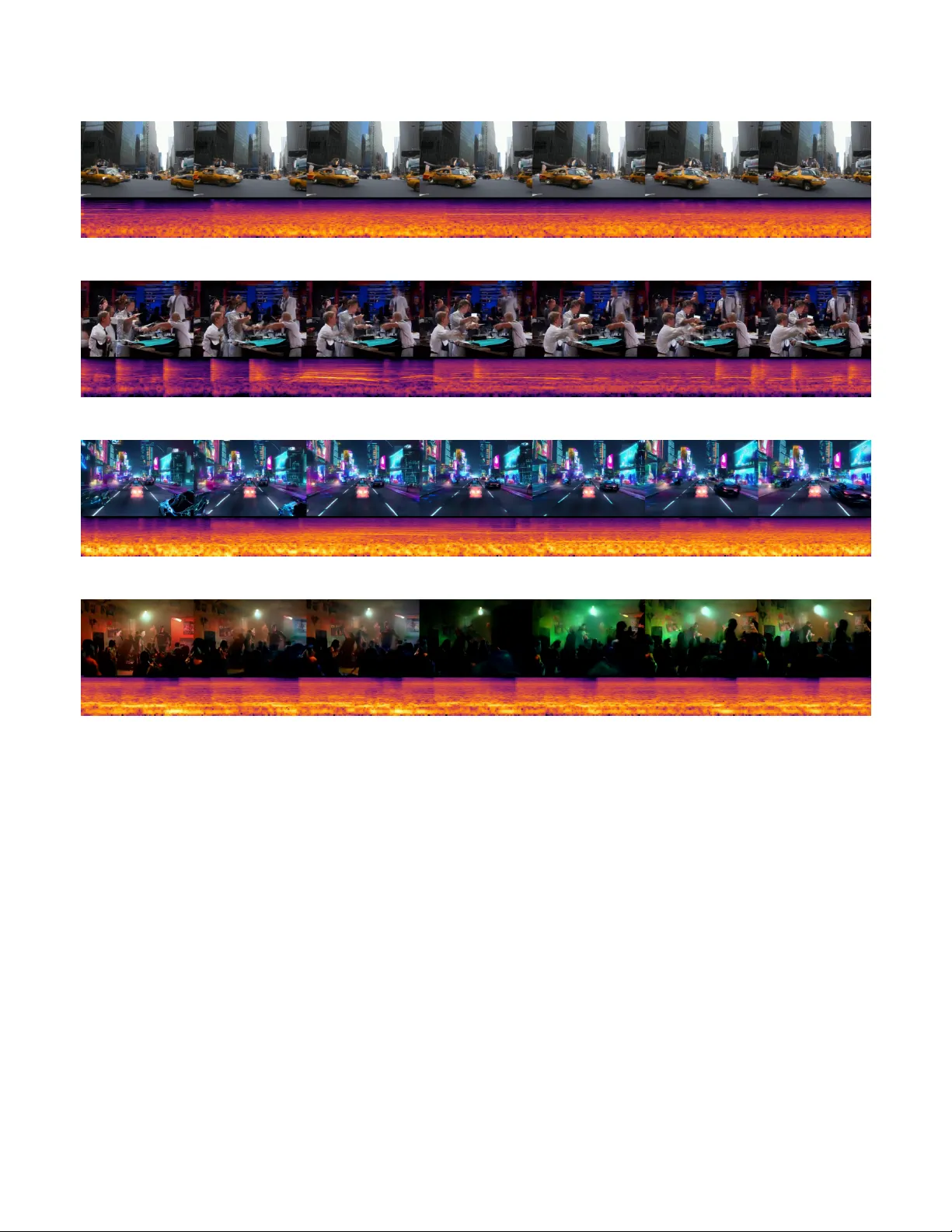

핵심 기여는 네 가지이다. 첫째, 두 개의 새로운 데이터셋을 공개한다. ‘GamePlay’ 데이터셋은 13 시간 분량의 34 초 클립으로 구성되며, 다양한 게임 장르와 빠른 액션을 포함한다. ‘Concert’ 데이터셋은 64 시간 분량의 콘서트 영상으로, 고품질 오디오와 조명·무대 변화를 풍부하게 담고 있다. 두 데이터셋 모두 텍스트 설명, 타임스탬프, 메타데이터를 제공해 연구 재현성을 높인다.

둘째, MM‑Diffusion을 새 데이터에 대해 처음부터 학습한다. 모델은 오디오와 비디오 각각에 1D·2D + 1D 컨볼루션과 자체‑어텐션을 결합한 U‑Net을 사용하고, MM‑Block을 통해 두 스트림을 교차‑어텐션으로 연결한다. 학습은 20 k 스텝(콘서트)와 15 k 스텝(게임)까지 진행했으며, 클래스‑프리 가이던스와 λ(t) 가중치를 적용해 텍스트‑조건부 성능을 강화했다. 정량 평가에서는 비디오 FID, 오디오 IS, 그리고 오디오‑비디오 정렬 점수(시간 차이 평균 0.12 s)를 사용했으며, 기존 MM‑Diffusion 대비 전반적인 품질이 크게 개선되었다.

셋째, 사전 학습된 인코더‑디코더를 활용한 공동 잠재 확산 실험을 수행한다. 비디오 인코더는 Stable Video Diffusion의 VAE, 오디오 인코더는 AudioLDM의 CLAP 기반 인코더를 사용한다. 두 인코더가 서로 다른 라티스 차원을 갖고 있어, 디코딩 단계에서 시간 정렬이 깨지는 현상이 관찰되었다. 특히, 오디오 디코더가 프레임당 1 kHz 샘플링을 사용함에 반해 비디오 라티스는 8 fps로 압축돼, 동기화 오프셋이 평균 0.25 s까지 증가했다. 이를 해결하기 위해 교차‑시간 정규화 손실과 동적 시간 왜곡(DTW) 기반 정렬을 시도했지만, 아직 완전한 해결에는 이르지 못했다.

넷째, 두 단계 순차 파이프라인을 제안한다. 첫 단계는 텍스트‑투‑비디오 모델(CogVideoX)을 이용해 8 fps, 16 초 길이의 영상을 생성한다. 여기서는 전문가‑어댑터(EA‑LN)를 통해 텍스트와 제어 토큰을 동적으로 반영한다. 두 번째 단계는 MMAudio 모델을 사용해 생성된 비디오와 동일 텍스트 프롬프트를 조건으로 오디오 라티스를 생성한다. 이때 비디오 프레임‑레벨 특징을 Synchformer로 추출해 오디오 디코더에 입력함으로써 시간 동기화를 강화한다. 실험 결과, 순차 파이프라인은 단일 통합 모델 대비 비디오 FID를 0.84 낮추고, 오디오‑비디오 정렬 점수를 15 % 향상시켰으며, 인간 평가에서는 78 % 이상의 응답자가 “음악과 움직임이 자연스럽게 맞는다”고 평가했다.

논문의 한계로는 (1) 현재 8 fps 이하의 저해상도 영상에 최적화돼 있어 실시간 고프레임 생성이 어려움, (2) 데이터셋이 게임·콘서트라는 특정 도메인에 편중돼 있어 일반 일상 영상에 대한 일반화 검증이 부족함을 들었다. 향후 연구 방향으로는 멀티스케일 라티스 설계, 고프레임 비디오 지원을 위한 효율적 시공간 디코더, 그리고 텍스트‑조건부 다중 모달 어텐션을 결합한 통합 모델을 제시한다. 또한, 공개된 데이터셋을 기반으로 베이스라인을 제공하고, 평가 프로토콜을 표준화함으로써 멀티모달 확산 연구 커뮤니티의 협업을 촉진하고자 한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기