효율적인 구현 계획을 위한 KV 캐시 중심 메모리 관리 시스템 KEEP

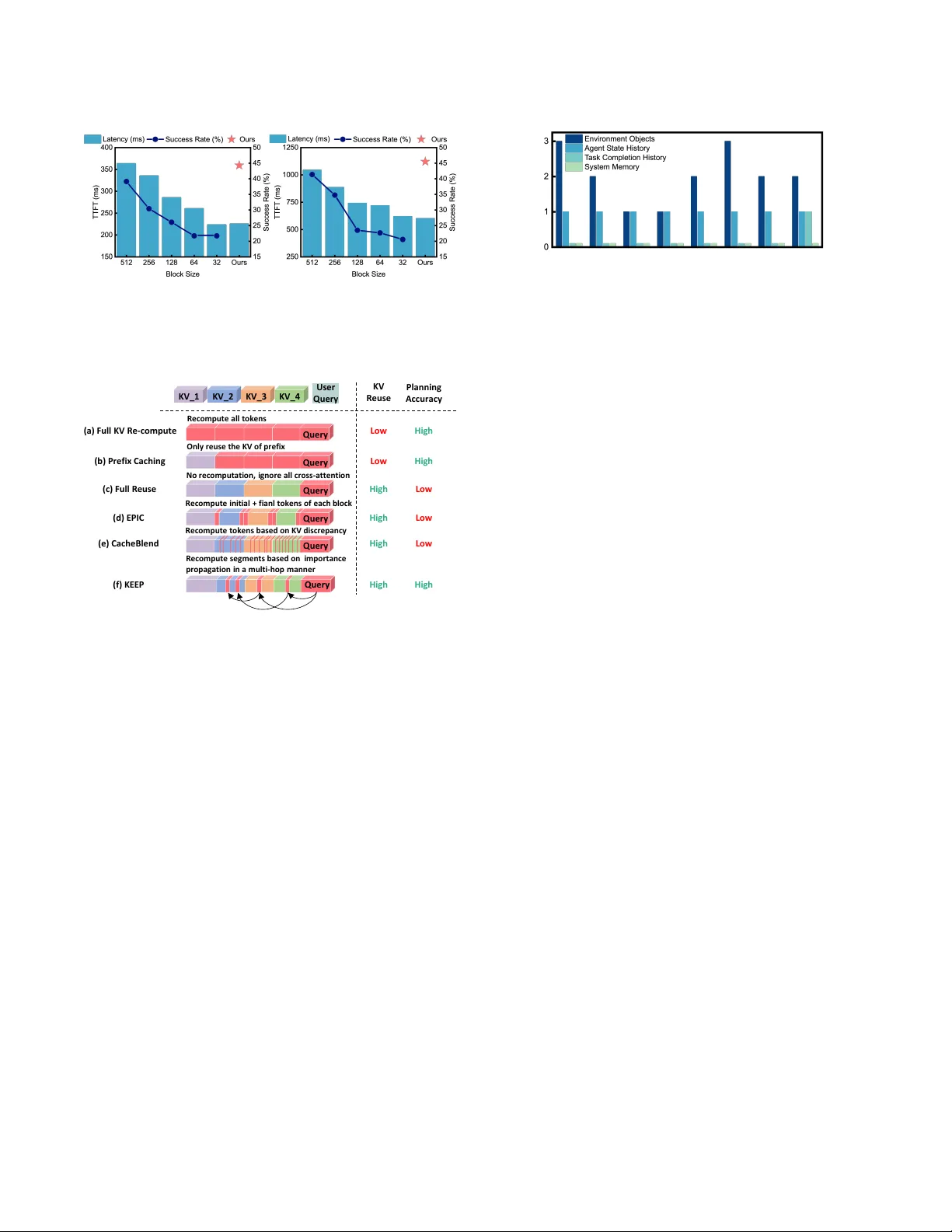

KEEP은 장면 상태와 행동 이력을 KV‑Cache 형태로 저장·재사용함으로써, 텍스트 기반 메모리 방식의 프리픽 지연을 크게 줄인다. 정적·동적 메모리 그룹을 혼합해 KV 재계산을 최소화하고, 다중 홉 재계산으로 중요한 교차‑어텐션을 동적으로 복원한다. 또한 레이어 균형 로딩 스케줄러로 GPU 메모리 로드 불균형을 해소한다. ALFRED 실험에서 텍스트 메모리 대비 2.68배 가속, CacheBlend 대비 성공률 4.13%·TTFT 1.90…

저자: Zebin Yang, Tong Xie, Baotong Lu

본 논문은 대규모 언어 모델(LLM)을 활용한 장기 임베디드 플래닝에서 메모리 관리가 초래하는 효율성 문제를 해결하고자 한다. 기존 방법은 메모리를 순수 텍스트 형태로 프롬프트에 삽입하거나, KV‑Cache를 재사용하려 하지만, 메모리 업데이트가 빈번해 캐시 무효화가 크게 발생한다. 이러한 배경에서 저자들은 KV‑Cache 중심 메모리 관리 시스템 ‘KEEP’를 제안한다.

1. **문제 정의 및 배경**

- 임베디드 플래닝은 로봇이 환경 상태와 과거 행동 이력을 지속적으로 추적해야 하며, 이는 수천 토큰에 달하는 복잡한 메모리를 요구한다.

- 텍스트 기반 메모리는 프리픽(pre‑fill) 단계에서 토큰 수가 급증해 지연이 크게 늘어나며, KV‑Cache 재사용은 메모리 변경 시 전체 캐시를 재계산해야 하는 한계가 있다.

2. **KEEP의 핵심 설계**

- **Static‑Dynamic Memory Construction**: 메모리 세그먼트를 업데이트 빈도에 따라 ‘정적’과 ‘동적’ 그룹으로 클러스터링한다. 정적 그룹은 전체 교차‑어텐션을 유지하면서 한 번에 KV를 계산하고, 동적 그룹은 세그먼트별로 개별 KV를 생성한다. 그룹 전환은 일정 단계(t=10) 동안 변화가 없을 때 자동으로 이루어진다.

- **Multi‑hop Memory Re‑computation**: 정적·동적 그룹 간 교차‑어텐션 손실을 보완하기 위해, 현재 쿼리와 컨텍스트를 기반으로 중요한 메모리 세그먼트를 다중 홉에 걸쳐 선택·재계산한다. 각 홉에서는 KV 차이와 어텐션 스코어를 이용해 재계산 토큰을 동적으로 선정하고, 이를 반복해 연쇄적인 논리 관계를 복원한다.

- **Layer‑balanced Memory Loading**: KV‑Cache는 GPU HBM에 비해 용량이 제한적이므로, CPU‑RAM에 저장하고 필요 시 GPU에 로드한다. 레이어별 KV 로드 비용을 분석해 파이프라인 스케줄러를 설계, 로드·연산·컴퓨팅을 레이어 수준에서 겹치게 함으로써 GPU 활용률을 최적화하고 로드 불균형에 따른 파이프라인 버블을 최소화한다.

3. **실험 및 결과**

- **데이터셋 및 모델**: ALFRED 벤치마크와 Qwen‑14B/32B 모델을 사용하였다.

- **성능 비교**: 텍스트 기반 메모리 대비 2.68배 속도 향상, 성공률 손실은 미미했다. CacheBlend 대비 성공률 4.13% 상승, TTFT(Time‑to‑First‑Token) 1.90배 감소를 기록했다.

- **Ablation Study**: 각 모듈을 제거했을 때 성능 저하를 정량화하였다. Static‑Dynamic 그룹 구성을 없앨 경우 KV 재계산 비용이 45% 증가했으며, Multi‑hop 재계산을 비활성화하면 성공률이 3.8% 감소했다. Layer‑balanced 로딩을 단순 순차 로딩으로 바꾸면 GPU 사용률이 30% 이하로 떨어졌다.

- **메모리 사용량**: KV‑Cache를 CPU‑RAM에 오프로드함으로써 GPU 메모리 사용량을 60% 절감했으며, 전체 시스템 메모리 footprint은 1.2 GB 수준으로 유지되었다.

4. **논의 및 한계**

- 동적 그룹의 크기와 재계산 홉 수가 성능‑효율 트레이드오프에 큰 영향을 미치며, 최적 파라미터는 작업 특성에 따라 달라진다.

- CPU‑RAM ↔ GPU KV 전송 과정에서 발생하는 I/O 지연이 전체 지연에 일정 비율을 차지한다. 향후 고속 인터커넥트(NVLink, PCIe 5.0) 활용이 필요하다.

- 메타데이터(그룹 라벨, 업데이트 타임스탬프) 관리 비용이 추가되지만, 이는 메모리 재계산 빈도 감소 효과에 비해 미미한 수준이다.

5. **결론**

KEEP은 KV‑Cache 재사용을 임베디드 플래닝에 맞게 최적화한 최초의 시스템으로, 메모리 업데이트에 따른 캐시 무효화를 최소화하고, 중요한 교차‑어텐션을 동적으로 복원함으로써 높은 효율성과 정확성을 동시에 달성한다. 앞으로는 더 큰 모델과 실시간 로봇 시스템에 적용해 실시간 제어 루프와의 통합을 탐색할 계획이다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기