데이터 기반 glmnet 설정 자동 튜닝으로 정확도·속도 균형 맞추기

본 논문은 glmnet의 기본 설정이 고상관 고차원 데이터에서 정확도를 크게 떨어뜨릴 수 있음을 지적하고, 대규모 시뮬레이션으로 만든 학습 데이터를 활용해 데이터 특성과 설정(수렴 임계값·λ 그리드 크기)으로부터 정확도와 실행 시간을 예측하는 신경망 모델을 구축한다. 새로운 데이터에 대해 이 모델을 이용해 파레토 전선을 생성하고, 사용자가 지정한 시간 제한 내에서 최적의 설정을 자동으로 선택한다. 구현은 R 패키지 glmnetconf에 제공된다…

저자: Shuhei Muroya, Kei Hirose

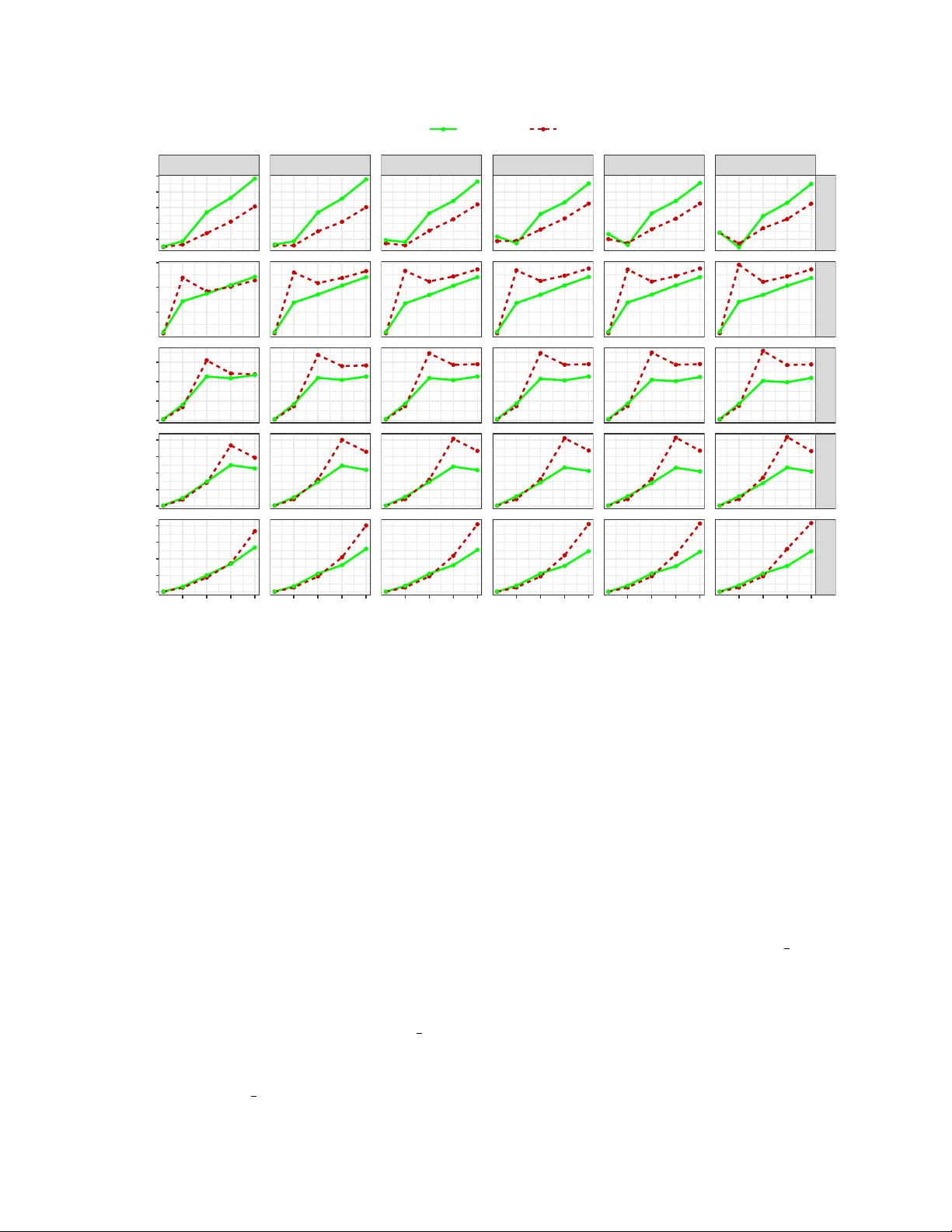

본 논문은 R 패키지 glmnet이 좌표 하강법을 이용해 라쏘(Lasso) 회귀의 해를 빠르게 근사하지만, 기본 설정이 모든 데이터에 최적화되어 있지 않다는 문제점을 지적한다. 특히, 관측 수 N보다 변수 수 p가 큰 고차원 상황이나 변수 간 상관관계가 높은 경우, 기본 수렴 임계값 τ = 10⁻⁷과 λ 시퀀스(λ_max → λ_def_min, n_λ = 100) 때문에 해가 실제 라쏘 해와 크게 달라질 수 있다. 저자들은 이를 시각적으로 보여주기 위해 동일 데이터에 대해 glmnet(기본), glmnet(수동 튜닝), 그리고 정확한 해를 제공하는 LARS 알고리즘을 비교한 그림을 제시한다. 결과는 기본 설정이 큰 오차를 보이며, 수동으로 τ와 λ 그리드 크기를 조정하면 LARS와 거의 일치한다는 점을 확인한다.

하지만 수동 튜닝은 알고리즘 내부를 이해하고 파라미터를 직접 조정해야 하므로 일반 사용자에게는 현실적이지 않다. 이를 해결하기 위해 저자들은 데이터‑드리븐 자동 튜닝 프레임워크를 제안한다. 프레임워크는 크게 두 단계로 구성된다.

1️⃣ **예측 모델 구축 단계**

- 다양한 시뮬레이션 파라미터(N, p, 상관 구조 γ, 신호‑대‑잡음 비 등)를 조합해 대규모 인공 데이터셋을 생성한다.

- 각 데이터셋에 대해 여러 τ와 n_λ 조합을 적용해 glmnet을 실행하고, 정확도 지표인 Solution Path Error(SPE)와 실행 시간(크로스‑밸리데이션 포함)을 측정한다.

- 측정값을 요약한 “summary dataset”을 만든 뒤, 데이터 특성(예: N, p, γ, sparsity)과 설정값(τ, n_λ)을 입력, SPE와 시간(두 개의 연속형 출력)을 예측하는 다층 퍼셉트론(MLP, 즉 glmnet‑MLP)을 학습한다.

2️⃣ **새 데이터에 대한 설정 최적화 단계**

- 사용자가 새로운 데이터셋을 제공하면, 먼저 데이터 특성을 자동 추출한다.

- 학습된 MLP에 데이터 특성과 후보 τ·n_λ 조합을 입력해 각각의 SPE와 예상 실행 시간을 예측한다.

- 예측된 두 목표를 이용해 파레토 전선(Pareto front)을 구성한다. 파레토 전선은 “시간 ≤ Tₕₒₚₑ”라는 사용자 지정 제한 하에서 최소 SPE를 제공하는 설정을 식별한다.

- 최종적으로 선택된 τ와 n_λ 값을 glmnet 함수에 전달해 라쏘 해를 계산한다.

이 과정에서 핵심은 **두 파라미터 τ와 n_λ**이다. τ는 수렴 기준을 조절해 정확도와 시간 사이의 직접적인 트레이드오프를 만들고, n_λ는 λ 그리드의 해상도를 조절한다. τ를 더 작게(엄격하게) 하면 반복 횟수가 늘어나지만 해의 정밀도가 향상되고, n_λ를 늘리면 λ 시퀀스가 더 촘촘해져 LARS와 동일한 변곡점(knot)을 포착할 확률이 높아진다.

실험에서는 (i) 시뮬레이션 기반 정확도 평가, (ii) 압축 센싱 응용, (iii) 실제 유전체 데이터 적용 등 세 가지 시나리오를 통해 제안 방법의 유효성을 검증한다. 모든 경우에서 glmnet‑conf가 LARS와 거의 동일한 SPE를 달성하면서도 실행 시간은 기본 glmnet보다 1.5~3배 정도 늘어나는 정도에 그쳤다(즉, 전체 튜닝 과정 포함 시에도 LARS보다 훨씬 빠름). 또한, 사용자가 지정한 시간 제한 이하에서 최적 설정을 자동으로 찾아주어 실무 적용성을 크게 높였다.

마지막으로, 구현된 R 패키지 glmnetconf는 GitHub(https://github.com/Shuhei-Muroya/glmnetconf.git)에서 공개되어, 사용자는 `glmnetconf::tune_glmnet(data, time_budget)`와 같은 간단한 인터페이스만으로 데이터 특성에 맞는 최적 설정을 얻을 수 있다. 이 패키지는 기존 glmnet과 완벽히 호환되며, 내부적으로 MLP 예측·파레토 최적화를 수행한다.

요약하면, 본 논문은 **데이터‑드리븐, 자동화된 설정 튜닝**이라는 새로운 패러다임을 제시함으로써, 고차원·고상관 데이터 환경에서도 라쏘 회귀의 정확성을 유지하면서 계산 효율성을 크게 향상시키는 실용적인 솔루션을 제공한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기