즉시 실행 모드 번들 조정 라이브러리

초록

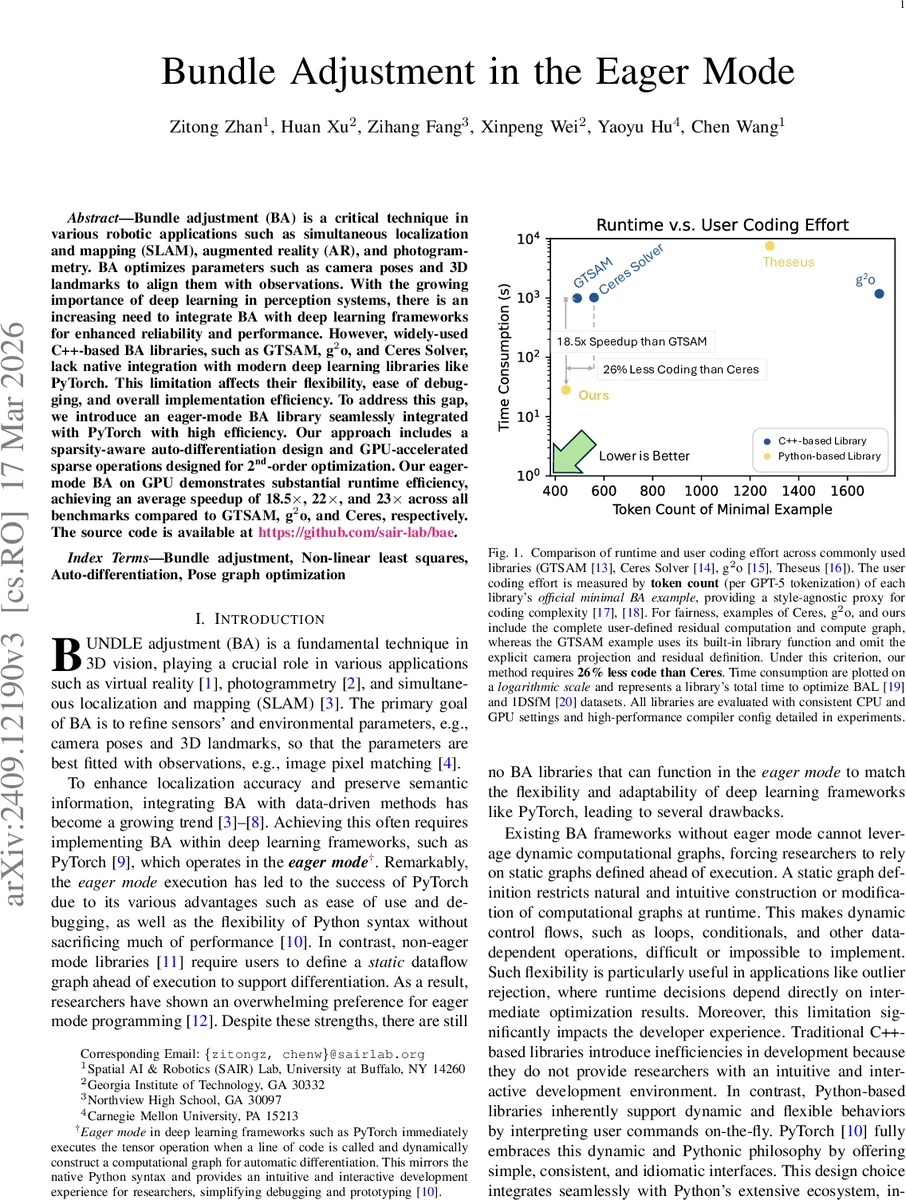

본 논문은 PyTorch와 완전하게 통합된 eager‑mode 번들 조정(BA) 라이브러리를 제안한다. sparsity‑aware 자동미분과 GPU 기반 희소 연산을 도입해 2차 최적화를 지원하며, 기존 C++‑기반 BA 도구(GTSAM, g2o, Ceres) 대비 평균 18×~23×의 속도 향상을 달성한다. 또한 코드량을 26 % 감소시켜 개발 효율성을 크게 높였다.

상세 분석

이 연구는 로봇 비전·SLAM·AR 분야에서 핵심적인 역할을 하는 번들 조정(Bundle Adjustment, BA)을 딥러닝 프레임워크와 자연스럽게 결합하는 방법론을 제시한다. 기존의 GTSAM, g2o, Ceres와 같은 C++ 기반 라이브러리는 정적 팩터 그래프와 CPU‑중심 설계에 의존해, 동적 제어 흐름이나 GPU 가속을 활용하기 어렵다. 저자들은 이러한 한계를 극복하기 위해 PyTorch의 eager‑mode 특성을 그대로 유지하면서도, 희소 행렬 연산을 효율적으로 처리할 수 있는 자동미분 파이프라인을 설계하였다. 핵심 아이디어는 연산 흐름을 DAG(Directed Acyclic Graph) 형태로 추적해 Jacobian의 희소 패턴을 런타임에 동적으로 식별하고, 이를 PyTorch의 native sparse tensor 형태로 저장·연산한다는 점이다. 이를 위해 LieTensor( PyPose )를 활용해 SE(3)와 같은 Lie 그룹 파라미터를 배치 형태로 자동미분 가능하게 만들었으며, Gauss‑Newton 및 Levenberg‑Marquardt와 같은 2차 최적화 알고리즘을 GPU‑가속 희소 선형 솔버와 결합하였다. 실험에서는 전통적인 BA 벤치마크(1DSfM, BAL)와 딥러닝 기반 SfM 파이프라인 모두에서 기존 도구 대비 18.5×~23×의 실행 시간 단축을 보였으며, 코드 토큰 수 기준으로 Ceres 대비 26 % 적은 라인을 작성해도 동일한 기능을 구현할 수 있음을 입증했다. 특히, 동적 제어 흐름(예: 런타임 아웃라이어 제거)과 같은 복잡한 로직을 Python 수준에서 직관적으로 구현할 수 있어 연구·개발 생산성이 크게 향상된다. 이와 같은 설계는 앞으로 BA를 포함한 다양한 비선형 최적화 문제(예: 포즈 그래프 최적화, 구조‑광학 흐름)에도 확장 가능성을 시사한다.

댓글 및 학술 토론

Loading comments...

의견 남기기