LLM 안정성은 믿음직하지만, 정답은 아니다: 데이터‑제한 과학 의사결정의 숨은 실패 모드

본 논문은 데이터가 제한된 과학 워크플로우에서 LLM을 의사결정 보조 도구로 사용할 때, “안정성(재현성)”만으로는 정답을 보장하지 못한다는 점을 실험적으로 입증한다. 유전자 우선순위 지정 작업을 기준으로, 세 모델(ChatGPT‑5.2, Gemini‑3, Claude‑Opus 4.5)을 네 가지 평가 차원(안정성, 정답성, 프롬프트 민감도, 출력 유효성)으로 분석하였다. 결과는 모델이 반복 실행 시 거의 완벽한 안정성을 보이면서도 통계적 기준…

저자: Nazia Riasat

본 논문은 데이터가 제한된 과학적 워크플로우, 특히 차등 발현 분석에서 도출된 유전자 우선순위 지정 작업을 사례로 삼아, 대형 언어 모델(LLM)의 안정성(재현성)과 실제 정답성 사이의 괴리를 체계적으로 탐구한다. 저자들은 먼저 LLM 평가에서 흔히 강조되는 “안정성”이 실제 통계적 근거와 일치한다는 가정을 비판하고, 이를 검증하기 위한 네 차원의 평가 프레임워크를 제안한다.

1. **안정성** – 동일 입력·프롬프트에 대해 여러 번 실행했을 때 출력이 얼마나 일관되는가를 Jaccard 지수와 겹침 계수로 측정한다.

2. **정답성** – DESeq2를 이용해 얻은 확정적인 차등 발현 결과를 “ground‑truth”로 삼아, 모델이 제시한 유전자 집합과의 겹침을 정량화한다.

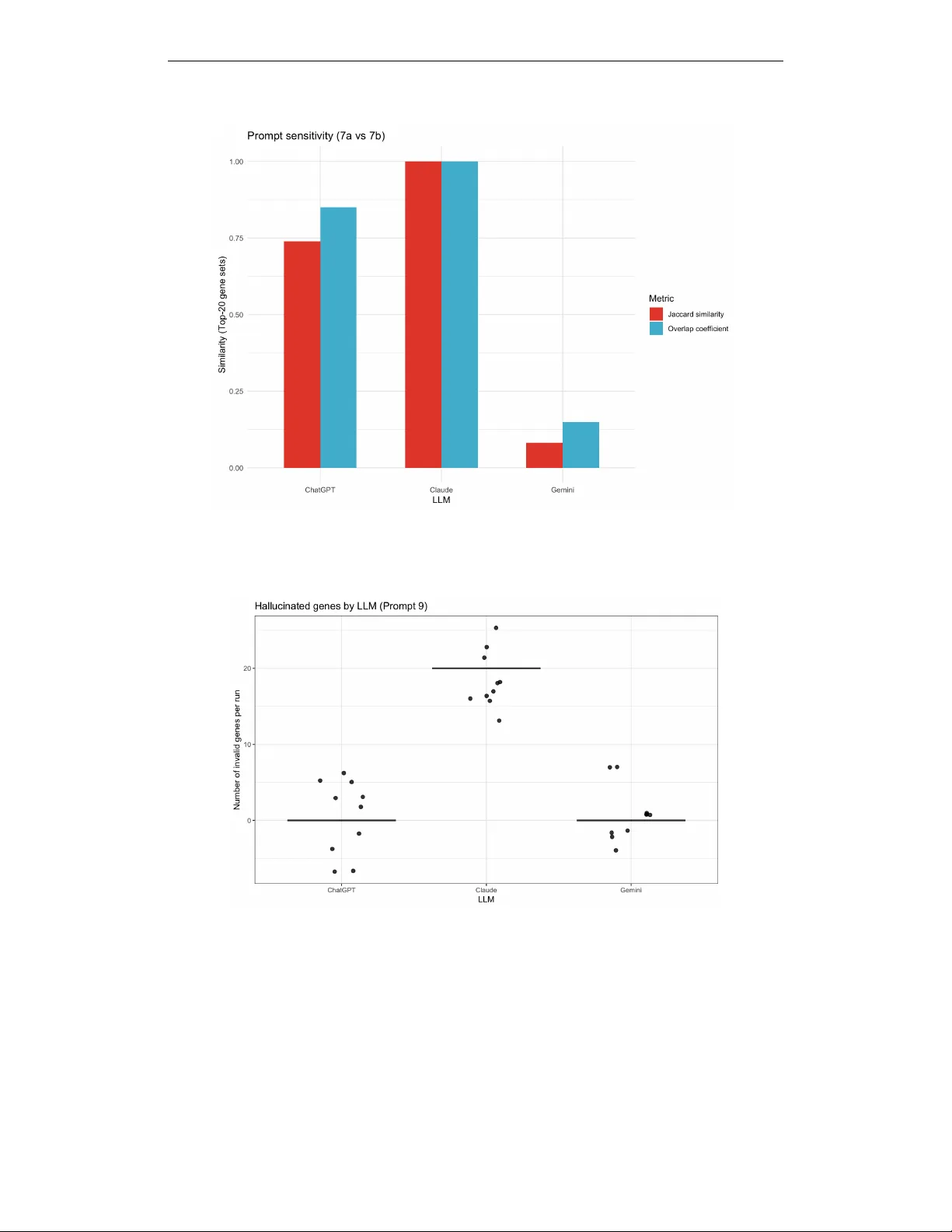

3. **프롬프트 민감도** – 의미는 동일하지만 어휘가 약간 다른 두 프롬프트(P7a vs P7b)를 사용해, 작은 문구 차이가 출력에 미치는 영향을 평가한다.

4. **출력 유효성** – 모델이 생성한 유전자 식별자가 입력 테이블에 실제 존재하는지 여부를 검사해, hallucination 현상을 탐지한다.

실험에 사용된 모델은 최신 버전의 ChatGPT(GPT‑5.2), Google Gemini 3, Anthropic Claude Opus 4.5이며, 각각 10회 반복 실행을 수행한다. 프롬프트는 네 가지 시나리오로 구성된다. (P1) 엄격한 FDR ≤ 0.05 기준, (P5) 완화된 0.05 < FDR ≤ 0.10 기준, (P6) Top‑20 경계 상황, (P7) 동일 입력에 대한 두 가지 문구 변형, 그리고 (P9) 출력 유효성 검사를 위한 별도 프롬프트이다.

**주요 결과**는 다음과 같다.

- **안정성**: 모든 모델이 거의 완벽한 내부 재현성을 보였다. Jaccard 평균이 0.99 ~ 1.00에 달했으며, 동일 프롬프트에 대해 출력이 거의 변하지 않았다.

- **정답성**: 안정성과는 별개로 정답과의 겹침은 크게 차이났다. ChatGPT는 P5(완화 기준)에서 Jaccard = 0.47을 기록했지만, Claude는 P1(엄격 기준)에서도 0.00을 보였다. Gemini는 P6(경계 Top‑20)에서는 완벽히 정답을 맞추었지만, 다른 조건에서는 낮은 일치를 보였다.

- **프롬프트 민감도**: 동일 의미의 P7a와 P7b에 대해 모델별 차이가 극명했다. ChatGPT는 0.74의 높은 일치를 유지했으나, Gemini는 0.08에 불과했다. Claude는 1.00으로, 프롬프트 변화에 거의 영향을 받지 않았지만 이는 다른 차원(출력 유효성)에서 큰 문제를 드러냈다.

- **출력 유효성**: Claude는 평균 20개의 존재하지 않는 유전자명을 매 실행마다 생성했으며, 이는 입력 테이블에 전혀 없는 토큰이었다. 반면 ChatGPT와 Gemini는 전혀 hallucination을 보이지 않았다.

이러한 결과는 “안정성”이 높은 모델이라 할지라도, 통계적 근거와 일치하지 않을 수 있음을 명확히 보여준다. 특히 과학적 의사결정에서는 작은 프롬프트 차이조차 결과를 크게 바꾸며, 모델이 입력 데이터의 제약을 무시하고 허구의 엔티티를 생성할 위험이 존재한다.

**논의와 결론**에서는 다음과 같은 시사점을 제시한다. 첫째, LLM을 과학적 파이프라인에 통합할 때는 단순 재현성 검증을 넘어, 실제 통계적 ground‑truth와의 정량적 비교가 필수적이다. 둘째, 프롬프트 설계 단계에서 문구의 미세한 차이가 결과에 미치는 영향을 사전에 평가하고, 가능한 한 명확하고 일관된 지시문을 사용해야 한다. 셋째, 출력이 입력 데이터에 기반하고 있는지 확인하는 유효성 검사를 자동화하여 hallucination을 조기에 탐지해야 한다. 마지막으로, 모델 선택 시에는 안정성뿐 아니라 정답성, 프롬프트 민감도, 출력 유효성 등 다차원적인 성능 프로파일을 고려해야 한다는 점을 강조한다.

본 연구는 데이터‑제한 상황에서 LLM의 한계를 체계적으로 드러내며, 향후 과학적 의사결정 지원 시스템 설계 시 반드시 고려해야 할 평가 기준을 제시한다. 이는 LLM이 “믿을 수 있는” 도구가 되기 위해서는 안정성 외에 정답성 및 도메인 제약 준수 여부를 검증하는 포괄적인 프레임워크가 필요함을 역설한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기