한 번의 노이즈로 로봇 정책을 업그레이드하는 골든 티켓

사전 학습된 확산·플로우 매칭 로봇 정책에 매번 무작위 가우시안 노이즈를 주는 대신, 고정된 초기 노이즈 벡터(골든 티켓)를 주입하면 하위 작업의 보상을 크게 향상시킬 수 있다. 저자는 Monte‑Carlo 정책 평가 기반의 단순 랜덤 서치를 통해 최적의 골든 티켓을 찾으며, 정책 파라미터를 전혀 수정하지 않는다. 실험은 43개 과제 중 38개에서 성공률을 평균 20% 이상, 최대 58%까지 끌어올렸으며, 실제 로봇에서도 50회 이하의 탐색으로…

저자: Omkar Patil, Ondrej Biza, Thomas Weng

본 논문은 사전 학습된 확산·플로우 매칭 기반 로봇 제어 정책에 대해, 매번 무작위 가우시안 초기 노이즈 z₁ 을 사용하는 전통적인 방식 대신, 고정된 초기 노이즈 벡터 w (‘골든 티켓’)를 주입함으로써 하위 작업의 보상을 크게 향상시킬 수 있음을 제시한다.

**배경 및 동기**

조건부 확산 및 플로우 매칭 모델은 고차원, 다중모드 행동 분포를 효과적으로 학습해 로봇 조작, VLA(비전‑언어‑행동) 등에서 널리 사용된다. 그러나 이러한 사전 학습된 정책을 특정 downstream task에 맞추어 개선하려면 (1) 모델 파라미터를 재학습하거나, (2) 별도의 노이즈 정책 네트워크를 훈련하거나, (3) 외부 critic을 활용하는 복잡한 절차가 필요했다. 이러한 접근법은 대규모 모델에서는 계산·설계 비용이 크게 증가한다.

**핵심 아이디어**

‘골든 티켓’ 가설은 초기 노이즈 하나만 바꾸어도 정책의 행동을 원하는 방향으로 조정할 수 있다는 점에 착안한다. 이는 이미지 생성 분야에서 “lottery ticket”이 특정 노이즈가 특정 이미지로 쉽게 변환된다는 발견과 유사하지만, 로봇 제어에서는 (i) 환경 상호작용, (ii) 비용 높은 샘플링, (iii) 비미분 가능한 보상 함수 등 추가 제약이 있다.

**검색 방법**

알고리즘 1은 매우 단순한 랜덤 서치를 사용한다.

1. 가우시안으로부터 n 개의 후보 초기 노이즈 wᵢ 를 샘플링한다.

2. 각 후보를 고정하고, 사전 정의된 탐색 환경 집합 E (다양한 초기 상태 혹은 다중 과제)에서 정책 π 을 실행한다.

3. 각 환경에서 에피소드 반환값 Rₑ 을 수집하고 평균 \bar Rᵢ 를 계산한다.

4. 평균 보상이 가장 높은 후보 w* 를 골든 티켓으로 선택한다.

탐색 단계에서 사용된 환경 E 와 최종 평가를 위한 별도 검증 환경 E_holdout 을 구분함으로써 과적합을 방지한다. 탐색 비용은 후보 수 n 과 환경 수 |E| 에 따라 선형적으로 증가한다.

**실험 설정**

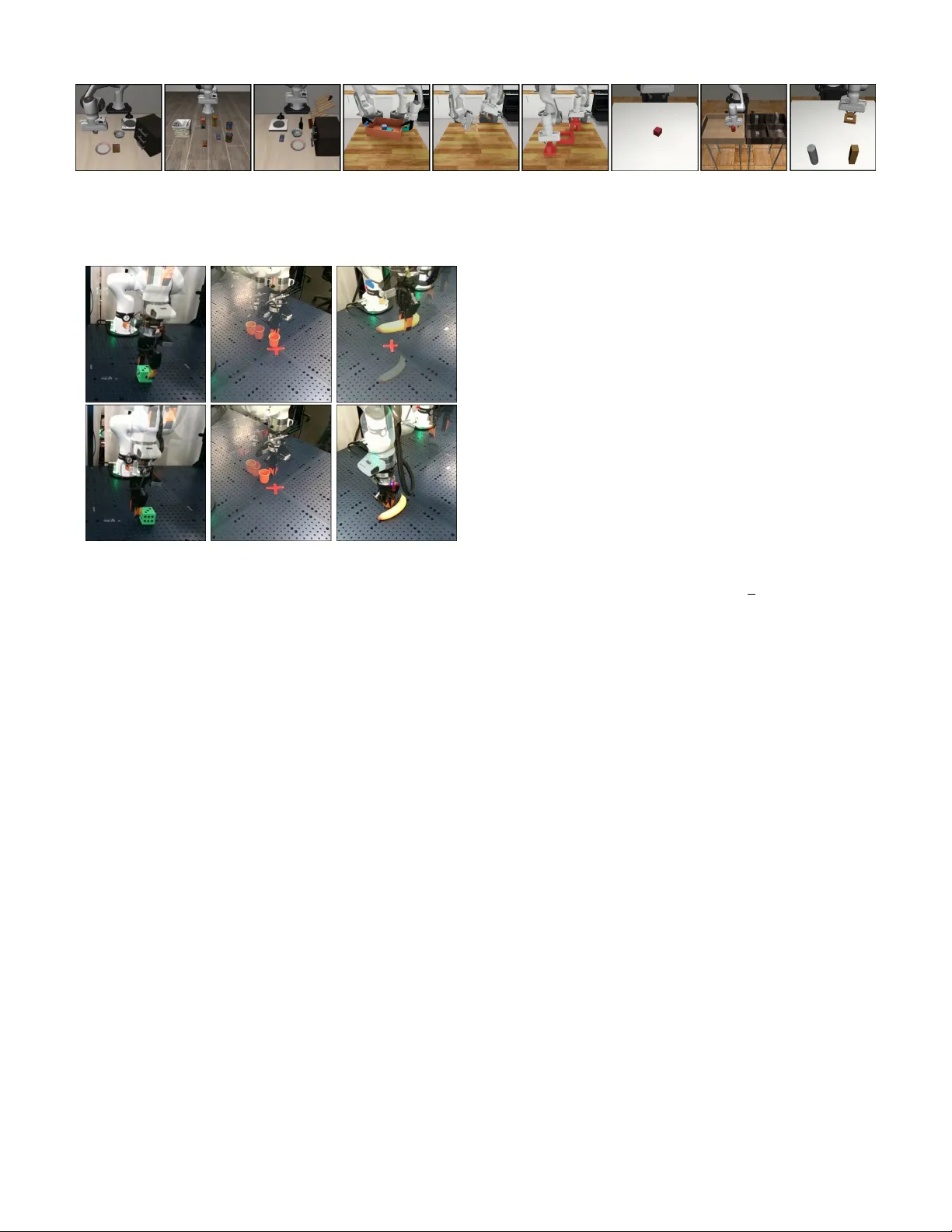

- **시뮬레이션**: 4개의 베치마크(Franka‑Sim, Multi‑Object, 등)에서 총 40개 과제. 모델 종류는 플로우 매칭, 확산, VLA(텍스트‑조건) 등 다양.

- **실제 로봇**: 프랑카 팔을 이용한 물체 집기·밀기 과제 3개. 각 과제당 50회 이하의 탐색 에피소드로 골든 티켓을 찾음.

**주요 결과**

- 43개 과제 중 38개에서 골든 티켓 적용 시 성공률이 평균 20% 이상 향상, 일부 시뮬레이션 과제에서는 58%까지 증가.

- 실제 로봇에서는 집기 과제 성공률이 18%, 밀기 과제는 60% 향상.

- 탐색 비용은 150 에피소드 이하(실제) 혹은 50 ~ 200 에피소드(시뮬레이션)로 매우 낮음.

- 다중 과제 설정에서 서로 다른 골든 티켓이 행동 다양성을 제공, 속도‑성공률 트레이드오프를 자연스럽게 조절 가능.

- VLA 모델에서는 하나의 골든 티켓이 연관된 여러 텍스트‑조건 과제에 동시에 성능 향상을 가져와 전이 학습 효과를 확인.

**비교 분석**

- DSRL 등 기존 latent steering 방법은 별도 노이즈 정책 네트워크를 RL로 학습해야 하며, 하이퍼파라미터 튜닝이 필요했다. 골든 티켓은 파라미터를 전혀 건드리지 않으며, 단순 랜덤 서치와 보상 평가만으로 동등하거나 더 나은 성능을 달성한다.

- 계산량 측면에서 골든 티켓은 정책을 한 번 실행하는 비용만 필요, RL 기반 방법은 수천 번의 정책·환경 상호작용을 요구한다.

**한계 및 향후 연구**

- 정책이 ‘steerable’하지 않을 경우(예: 완전 deterministic) 효과가 제한적.

- 탐색 환경과 실제 환경 간 분포 차이가 클 경우 과적합 위험. 이를 완화하기 위한 메타‑탐색, 베이즈 최적화 등 고급 서치 기법 도입이 제안된다.

- 현재는 초기 노이즈 하나만 고정하지만, 다중 단계 노이즈 시퀀스(시간‑조건 노이즈) 최적화도 가능성 있는 연구 방향이다.

**결론**

‘골든 티켓’은 사전 학습된 대규모 로봇 정책을 재학습 없이도 빠르게 현장 적용할 수 있게 하는 실용적이고 이론적으로도 흥미로운 방법이다. 초기 노이즈 하나를 최적화함으로써 정책의 행동 공간을 원하는 방향으로 편향시키고, 복잡한 RL 파이프라인 없이도 실시간 로봇 제어 성능을 크게 끌어올릴 수 있음을 입증한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기