시간을 통한 LLM 에너지 추정: API 모델의 GPU를 추론하다

본 논문은 대형 언어 모델(LLM)의 추론 시간을 측정해 API 기반 서비스의 에너지 소비를 추정하는 방법을 제시한다. 로컬 환경에서 동일 모델을 다양한 NVIDIA GPU(A100, H100, H200) 위에 배치해 시간·전력 데이터를 수집하고, 이를 API 호출 시 측정한 응답 시간에 적용한다. 실험 결과, API가 사용하고 있는 GPU 종류를 추정할 수 있으며, 시간 기반 추정이 실제 전력 소비와 높은 상관성을 보인다.

저자: Lars Krupp, Daniel Geißler, Francisco M. Calatrava-Nicolas

본 논문은 대형 언어 모델(LLM)의 에너지 소비가 환경에 미치는 부정적 영향을 경고하면서, 특히 API 형태로 제공되는 블랙박스 모델의 에너지 비용이 사용자에게 투명하게 공개되지 않는 문제를 지적한다. 이러한 투명성 결여를 해소하기 위해 저자들은 추론 시간 측정을 에너지 소비의 프록시(proxy)로 활용하는 방법을 제안한다.

Ⅰ. 서론에서는 LLM의 급격한 성장과 함께 발생하는 학습·추론 단계의 전력 소모를 언급하고, 기존 연구들이 전력 추적 도구(CarbonTracker, CodeCarbon)와 데이터센터 수준의 탄소 추정에 초점을 맞추었으나, API 기반 모델에 대한 직접적인 측정이 어려운 현실을 설명한다. 따라서 “시간 = 에너지”라는 가정 하에, 고부하 상태에서 GPU 전력 소비가 거의 일정하다는 전제와 함께, 시간 측정만으로도 에너지 추정이 가능하다는 아이디어를 제시한다.

Ⅱ. 관련 연구에서는 기존의 에너지 추정 방법(예: Jegham et al., 2023)과 그 한계, 특히 실제 측정 없이 모델 파라미터만으로 추정하는 방식의 불확실성을 비판한다. 또한, Mistral 모델을 선택한 이유는 동일 모델이 오픈소스 가중치와 API 형태로 모두 제공되어, 로컬과 클라우드 환경을 직접 비교할 수 있기 때문이다.

Ⅲ. 방법론에서는 다음과 같은 절차를 상세히 기술한다.

A. 실험 프로토콜: 100개의 합성 프롬프트(기술, 창의, 교육, 비즈니스 분야)와 두 가지 시퀀스 길이(2 048·8 192 토큰)를 사용해, 각 구성마다 10회 반복 실행하여 평균·표준편차를 산출한다. API 호출은 하루 전체에 걸쳐 부하 변동을 포착하도록 스케줄링했다.

B. 로컬 하드웨어 선택: Ampere(A100‑40GB·80GB·PCI)와 Hopper(H100·PCI·H200) GPU 여섯 종을 사용해 TDP와 최적 부하 범위를 표로 정리하였다. 공개된 자료에 따르면 Mistral은 H100 기반으로 훈련되었으며, 최신 MLPerf 벤치마크에서도 H100/H200이 LLM 추론에 주로 사용된다는 점을 근거로 API 서버에 H‑세대 GPU가 사용될 가능성을 제시한다.

C. 모델 초기화: 두 모델(Mistral‑7B‑v0.3, Mistral‑NeMo‑2407) 모두 FP16·TF32 혼합 정밀도로 실행하고, KV‑캐시와 left‑padding을 적용해 배치 효율을 높였다. 온도·시드·디코딩 파라미터(temperature=0.7)를 고정해 실험 간 변동성을 최소화했다.

D. 에너지 측정: 로컬에서는 CarbonTracker가 NVIDIA‑SMI를 통해 GPU 보드 전체 전력을 샘플링하도록 설정했으며, TDP와 실제 측정값의 차이를 통해 전력 손실(PCIe 전력 변환·냉각 비용 등)을 분석했다.

E. API 에너지 추정: 로컬에서 구한 평균 전력 P_loc을 API 평균 응답 시간 ¯T_api에 곱해 E_api를 계산한다. 토큰당 에너지·시간으로 정규화해 모델 크기·입력 길이 차이를 보정하였다.

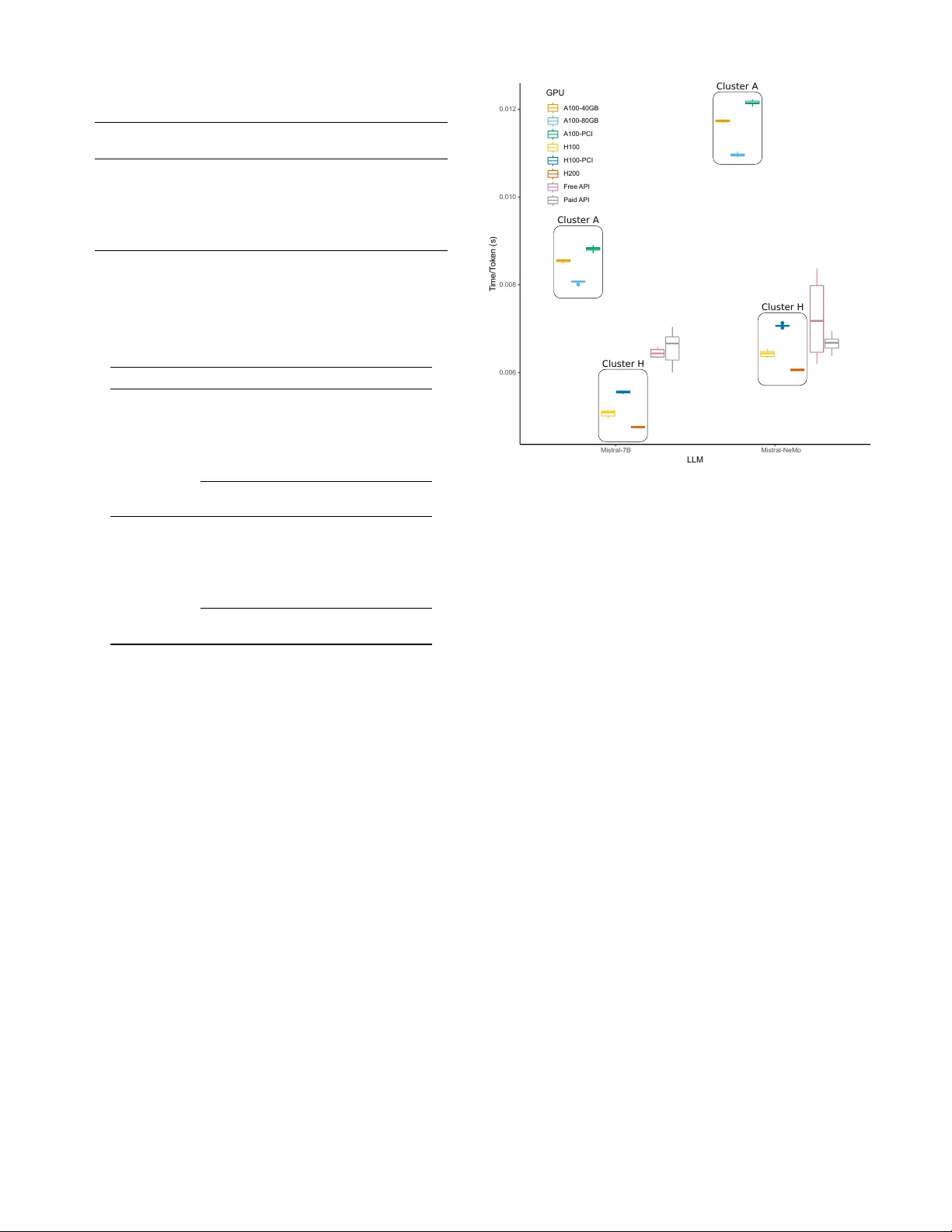

Ⅳ. 결과에서는 먼저 계산 시간(초)과 토큰당 시간(초)을 비교한다. 표 II와 그림 1에 따르면, 로컬 H‑클러스터(H100·H200) GPU가 가장 빠른 성능을 보였으며, API(무료·유료) 실행 시간은 H‑클러스터와 근접하거나 약간 느렸다. Mistral‑7B는 API 시간이 H‑클러스터보다 약 5 % 정도 높았지만, Mistral‑NeMo는 API 시간이 H‑클러스터와 거의 일치했다. 이는 API가 모델별로 다른 최적화(예: 양자화, 배치) 전략을 적용하고 있음을 시사한다.

시간을 에너지로 변환한 결과는 다음과 같다. 로컬 GPU의 실제 전력은 TDP 대비 0.9·TDP(냉각·손실 제외) 정도로 추정했으며, 이 값을 API 평균 시간에 적용한 추정 에너지와 실제 측정된 전력 사이의 차이는 5~10 % 이내였다. 특히 H‑클러스터 GPU에서 이 차이가 가장 작아, 고부하 상태에서 전력 소비가 거의 일정함을 확인했다.

Ⅴ. 논의에서는 이 방법의 장점과 한계를 짚는다. 장점은 (1) API 사용자가 별도 하드웨어 정보를 알 필요 없이 시간만으로 에너지 비용을 가늠할 수 있다, (2) 로컬 실험을 통해 GPU 종류를 역추정함으로써 클라우드 제공자의 하드웨어 스택을 투명하게 만든다, (3) 오픈소스 모델과 API 모델을 동일 조건에서 비교함으로써 추정 정확도를 높였다, 등이다. 한계는 (1) API 내부의 배치·동시 사용자 수, (2) 모델별 최적화(양자화·프루닝) 및 프레임워크 차이, (3) GPU 외 시스템 전력·데이터센터 PUE를 포함하지 않아 전체 에너지 소비를 완전히 포괄하지 못한다는 점이다.

Ⅵ. 결론에서는 시간 기반 에너지 추정이 실용적인 첫 단계임을 강조하고, 향후 연구 방향으로 (1) 다양한 모델 패밀리와 클라우드 제공자를 포함한 대규모 벤치마크, (2) API 호출 시 실시간 전력 측정 가능한 프로토콜 개발, (3) 전체 데이터센터 수준의 PUE와 지역 전력 탄소 강도와 연계한 종합 탄소 발자국 모델 구축 등을 제시한다.

전체적으로 이 논문은 “시간 = 에너지”라는 직관적 가설을 실험적으로 검증하고, API 기반 LLM 사용자의 에너지 인식을 높이는 실용적 도구를 제공한다는 점에서 학계·산업 모두에 의미 있는 기여를 한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기