xplainfi: 머신러닝 모델 해석을 위한 종합 피처 중요도 패키지

xplainfi는 R의 mlr3 생태계 위에 구축된 패키지로, 전역 손실 기반 피처 중요도(PFI, CFI, LOCO, RFI, SAGE 등)와 그에 대한 통계적 추론(신뢰구간, 가설검정)을 일관된 인터페이스로 제공한다. 조건부 샘플링을 위해 Gaussian, ARF, 조건부 추론 트리, knockoff 등 다양한 방법을 모듈화했으며, 연속형·혼합형 데이터 모두에 적용 가능하도록 설계되었다. 실험 결과 기존 구현과 동일한 중요도 점수를 보이며,…

저자: Lukas Burk, Fiona Katharina Ewald, Giuseppe Casalicchio

이 논문은 머신러닝 모델의 해석 가능성을 높이기 위해 전역 손실 기반 피처 중요도(Global, loss‑based Feature Importance) 방법들을 포괄적으로 제공하는 R 패키지 **xplainfi**를 소개한다. 기존 R 생태계에는 순열 피처 중요도(PFI), 조건부 피처 중요도(CFI), LOCO, RFI, SAGE 등 다양한 방법이 흩어져 있었지만, 조건부 중요도와 그에 대한 통계적 추론 절차가 부족했다. xplainfi는 이러한 격차를 메우기 위해 mlr3 프레임워크 위에 구축되어, 학습자, 태스크, 측정, 리샘플링 등 기존 인프라를 재사용하면서 새로운 FI 메서드와 추론 기능을 일관된 인터페이스로 제공한다.

**주요 기능**

1. **다양한 FI 메서드 구현**

- 순열 피처 중요도(PFI)

- 조건부 순열 피처 중요도(CFI)

- 상대적 피처 중요도(RFI) – 조건 집합 G를 자유롭게 지정

- Leave‑One‑Covariate‑Out(LOCO) 및 WVIM(Williamson’s Variable Importance Measure) – 모델 재학습 기반

- 마진·조건부 SAGE(Shapley Additive Global Importance) – Shapley 값을 이용한 전역 중요도

2. **조건부 샘플링 모듈**

- 다변량 정규(Gaussian) – 연속형 변수 전용, 빠름

- 조건부 추론 트리(Conditional Inference Trees) – 비모수, 혼합형 변수 지원

- 적대적 랜덤 포레스트(ARF) – 복잡한 혼합형 데이터에 대한 밀도 추정·샘플링

- Knockoff 샘플러 – CPI 프레임워크와 연계, 가설 검정에 특화

3. **통계적 추론**

- Nadeau‑Bengio 분산 보정 t‑검정 → 학습자‑레벨 신뢰구간

- 관측 수준 LOCO 추론 → 개별 데이터 포인트에 대한 중요도 검정

- Conditional Predictive Impact(CPI) 프레임워크 → knockoff 기반 가설 검정, ARF 버전 제공

- 다중 검정 보정(FWER: Bonferroni‑Holm, FDR: Benjamini‑Hochberg, Benjamini‑Yekutieli)

4. **추정량(Estimand) 구분**

- **모델 수준**: 고정된 학습된 모델에 대한 FI

- **학습자 수준**: 동일 학습자를 다양한 데이터 샘플에 적용해 평균적인 FI 측정

- **DGP 수준**: 데이터 생성 과정 자체의 변수‑목표 관계를 추정, 강력한 학습자를 AutoML 방식으로 근사

**방법론적 상세**

FI는 “정보 제거” 전략에 따라 세 가지 범주로 나뉜다. (1) **특성 교란** – PFI, CFI, RFI, SAGE 등; (2) **모델 재학습** – LOCO, WVIM; (3) **Shapley 값** – SAGE. 교란 기반 방법은 한 번 모델을 학습하고 여러 번 예측만 수행하므로 계산 비용이 낮지만, 교란 방식에 따라 의존 구조가 파괴될 위험이 있다. 이를 보완하기 위해 xplainfi는 조건부 분포를 추정·샘플링하는 다양한 엔진을 제공한다. 특히 ARF와 조건부 트리는 혼합형 변수에서도 정확한 조건부 샘플링을 가능하게 하며, knockoff은 CPI 검정에 필수적인 교란을 제공한다.

통계적 불확실성 추정은 FI 추정이 무작위(데이터 리샘플링, 교란, stochastic learner) 요소에 의존한다는 점을 인식하고, 반복 평가를 통해 손실 차이의 분산을 추정한다. Nadeau‑Bengio 방식은 재샘플링 반복 간 상관을 보정해 보다 보수적인 신뢰구간을 제공한다. CPI는 null 가설 하에 교란된 특성의 중요도가 0임을 검정하며, knockoff을 이용해 정확한 p‑값을 산출한다.

**실험 및 평가**

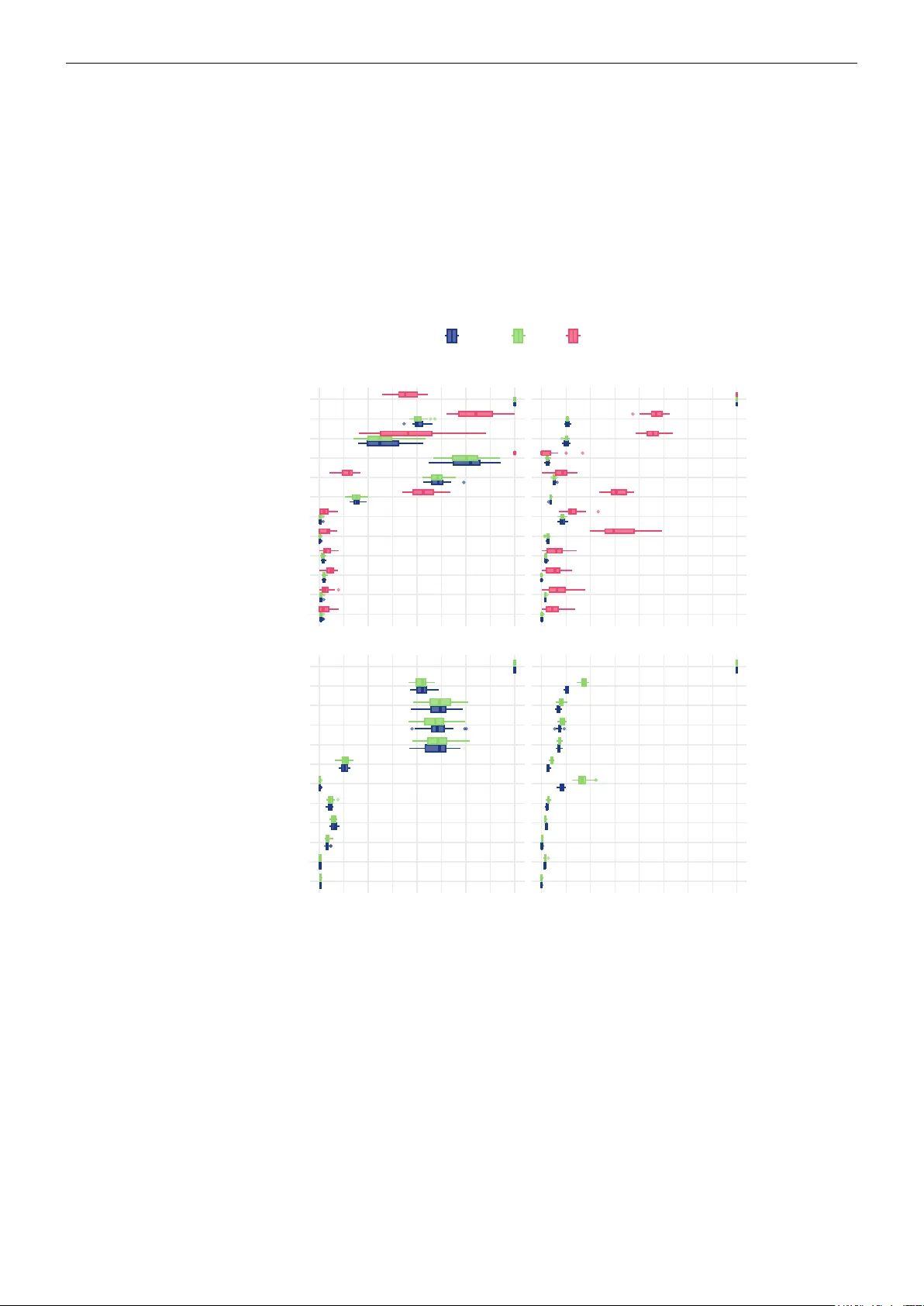

저자들은 연속형, 범주형, 혼합형 데이터와 다양한 상관 구조를 포함한 시뮬레이션을 설계하고, 랜덤 포레스트, XGBoost, SVM 등 여러 학습자를 적용했다. 기존 R 패키지(vip, iml, mlr 등)와 비교했을 때, xplainfi는 동일한 중요도 순위와 값(특히 CFI·RFI) 을 재현하면서도 실행 시간이 경쟁력을 보였다. Gaussian 샘플링은 가장 빠르고, ARF와 knockoff은 비용이 크지만 복잡한 의존 구조를 정확히 보존한다는 장점이 확인되었다.

**의의와 한계**

xplainfi는 FI와 통계 추론을 하나의 프레임워크에 통합함으로써, 연구자와 실무자가 변수 선택, 모델 해석, 인과 추론 등 다양한 목적에 맞는 분석을 손쉽게 수행하도록 돕는다. 다만, 조건부 샘플링은 고차원·강한 상관 구조에서 정확도가 떨어질 수 있으며, knockoff 기반 검정은 현재 연속형 변수에 최적화돼 있어 혼합형 데이터에 대한 구현이 아직 제한적이다. 향후 고차원 조건부 밀도 추정 및 효율적인 knockoff 생성 방법이 추가된다면 패키지의 적용 범위가 더욱 확대될 것이다.

**결론**

xplainfi는 mlr3와의 깊은 통합, 풍부한 FI 메서드, 다중 조건부 샘플링 옵션, 그리고 체계적인 통계 추론 도구를 제공함으로써 R 사용자에게 전역 피처 중요도 분석을 위한 가장 포괄적인 툴킷을 제공한다. 이는 모델 해석의 신뢰성을 높이고, 변수 선택 및 과학적 인사이트 도출에 필요한 정량적 근거를 제공한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기