계층형 그래디언트 트래킹으로 서브넷 드리프트 완화

초록

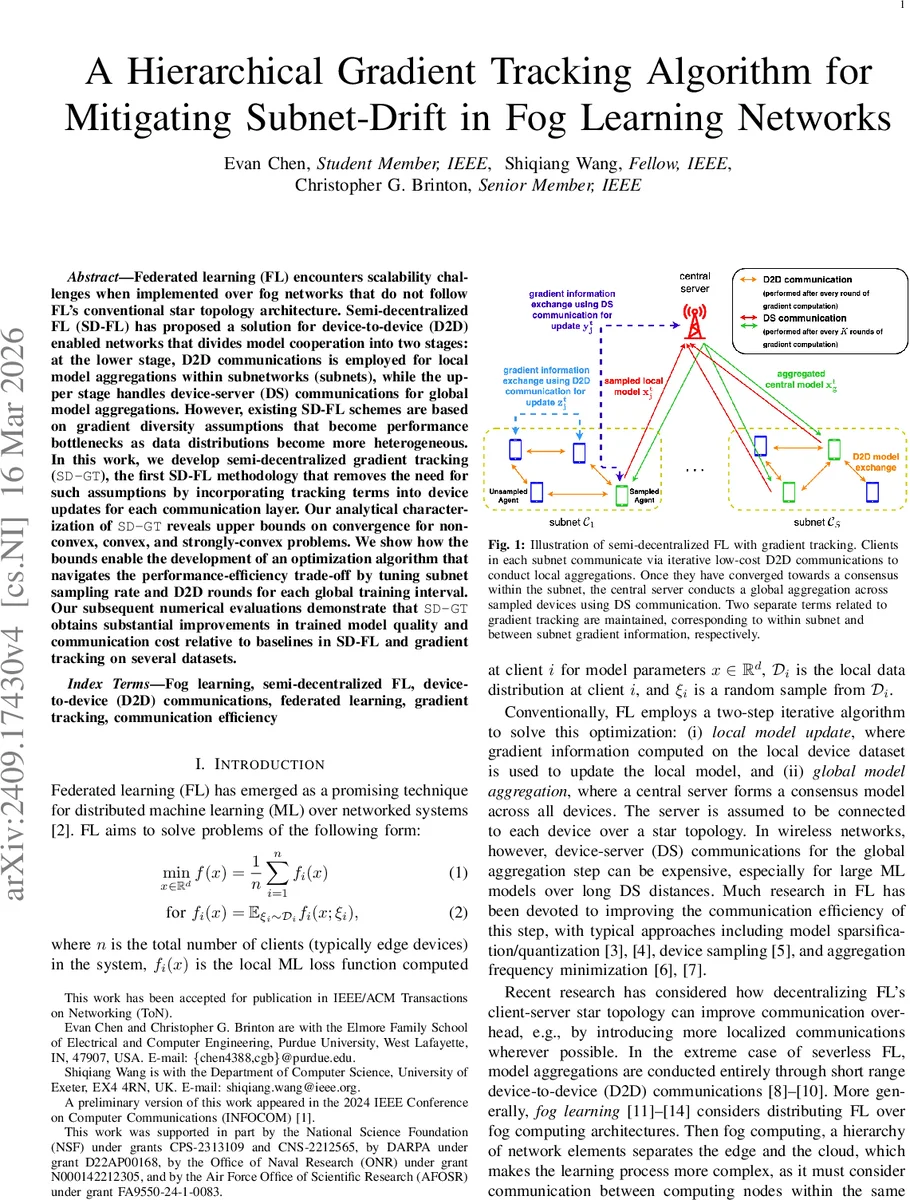

본 논문은 Fog 환경에서 반(半)분산형 연합학습(SD‑FL)의 핵심 문제인 서브넷 간 데이터 이질성으로 인한 “서브넷 드리프트”를 해결하기 위해 두 단계의 그래디언트 트래킹 변수를 도입한 SD‑GT 알고리즘을 제안한다. 이론적으로 비볼록·볼록·강볼록 문제에 대한 수렴 상한을 도출하고, 수렴 속도와 통신 비용을 동시에 최적화하는 공동 최적화 프레임워크를 설계하였다. 실험 결과, 기존 SD‑FL 및 기존 그래디언트 트래킹 기법 대비 모델 정확도와 통신 효율 모두 크게 향상됨을 보였다.

상세 분석

본 연구는 Fog 학습 네트워크에서 기존의 별형 토폴로지를 탈피한 반분산형 연합학습(SD‑FL) 구조가 갖는 두 가지 근본적인 한계를 정확히 짚어낸다. 첫 번째는 D2D(디바이스‑투‑디바이스)와 DS(디바이스‑투‑서버) 통신이 서로 다른 시간·스케일을 가지고 있어, 동일한 그래디언트 트래킹 변수를 사용하면 정보 혼합 속도 차이로 인한 편향이 발생한다는 점이다. 두 번째는 기존 SD‑FL 이론이 데이터 이질성(gradient diversity) 상수를 필요로 하여, 실제 비동질 데이터 환경에서 수렴 보장이 약화된다는 점이다.

이를 해결하기 위해 저자들은 각 서브넷 내부와 서브넷 간에 별도의 트래킹 변수 (y^{\text{in}}_i)와 (y^{\text{out}}_i)를 유지한다. D2D 라운드에서는 인접 디바이스로부터 받은 모델 파라미터와 로컬 그래디언트를 이용해 (y^{\text{in}}_i)를 업데이트하고, 서브넷 내 합의를 통해 근사된 평균 그래디언트를 공유한다. 반면 DS 라운드에서는 서버가 샘플링한 디바이스들의 모델을 집계하면서 (y^{\text{out}}_i)를 갱신한다. 이렇게 두 트래킹 변수를 병렬로 운영함으로써, 서브넷 내부의 빠른 정보 교환과 서브넷 간의 느린 교환을 각각 최적화하고, 서로 다른 통계적 특성을 보정한다.

이론적 분석은 Lyapunov 함수 기반으로 전개된다. 비볼록 문제에서는 기대 손실이 (\mathcal{O}(1/\sqrt{T})) 수렴함을, 약볼록(weakly convex) 문제에서는 (\mathcal{O}(1/T^{1/4})) 수준의 수렴률을 보이며, 강볼록 문제에서는 결정적 그래디언트 가정 하에 선형 수렴을 증명한다. 특히, 기존 SD‑FL이 요구하던 데이터 이질성 상수 (\zeta)가 수렴 경계에 등장하지 않음이 핵심적인 기여이다.

또한, 수렴 상한을 활용해 D2D 라운드 수 (K)와 서브넷 샘플링 비율 (p)를 공동 최적화하는 기하 프로그래밍 기반 제어 알고리즘을 제시한다. 이 제어는 통신 비용(DS와 D2D 비용 비율)와 목표 수렴 속도 사이의 트레이드오프를 자동으로 조정한다. 실험에서는 다양한 데이터 분포(Dirichlet (\alpha) 파라미터 변동)와 네트워크 토폴로지(완전 그래프, 랜덤 그래프, 시간 변동 서브넷)에서 SD‑GT가 기존 SD‑FL(예: FedAvg‑SD, FedProx‑SD) 및 전통적인 그래디언트 트래킹(예: GT‑D2D) 대비 1025% 높은 정확도와 3045% 낮은 통신량을 달성함을 확인했다.

요약하면, 두 단계의 그래디언트 트래킹을 도입함으로써 서브넷 드리프트를 근본적으로 억제하고, 데이터 이질성에 대한 강건성을 확보했으며, 실용적인 통신‑성능 공동 최적화 프레임워크까지 제공한다는 점에서 Fog 기반 연합학습 분야에 중요한 진전을 이룬다.

댓글 및 학술 토론

Loading comments...

의견 남기기