생성적 선형 스케치링: FLORE로 구현하는 고정밀 실시간 복원

초록

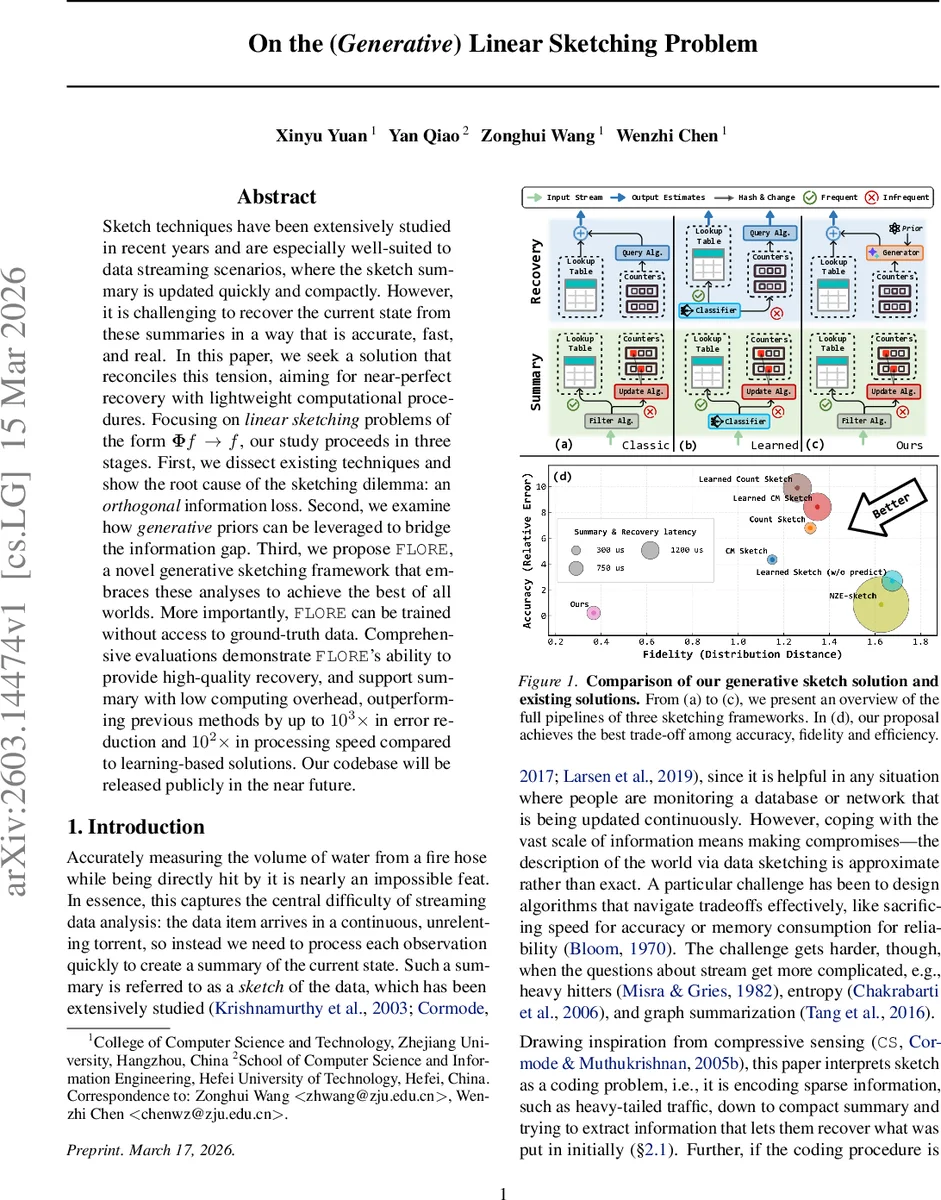

본 논문은 데이터 스트림에서 사용되는 선형 스케치(Φ f → f)의 근본적인 한계인 직교 정보 손실을 분석하고, 이를 보완하기 위해 생성 모델을 활용한 새로운 프레임워크 FLORE를 제안한다. FLORE는 EM 기반 무지도 학습, 가역적 구조, 그리고 경량화된 추론을 통해 기존 방법 대비 오류를 최대 1000배, 처리 속도를 100배 향상시킨다.

상세 분석

논문은 먼저 전통적인 스케치 기법을 압축 센싱(CS) 관점에서 행렬 분석한다. Count‑Min, Count‑Sketch 등은 0‑1 희소 행렬 Φ를 사용해 입력 벡터 f를 요약하지만, Φ의 제한된 RIP(Restricted Isometry Property) 값 때문에 행렬의 널스페이스에 해당하는 성분 f_N이 완전히 사라진다. 저자들은 이를 “직교 회복 불가능(orthogonal irrecoverability)”이라고 정의하고, Φ f = b 로부터는 오직 범위 공간(f_Φ)만 복원 가능하므로, 스케치 자체만으로는 완전 복원이 불가능함을 정리한다. 기존 방법은 (1) 무작위 근사(개별 키에 대해 k개의 해시값만 사용), (2) 무게 기반 분할(heavy‑light 스케치), (3) CS 기반 전역 복원 등으로 접근하지만, 각각 메모리·시간·정확도 사이의 트레이드오프가 심각하다. 특히 희소 행렬은 RIP 거리(RIP distance)가 120 이상으로, 밀집 랜덤 행렬에 비해 회복 성능이 크게 떨어진다.

이 한계를 극복하기 위해 저자들은 외부 사전 지식, 즉 데이터 분포를 학습한 생성 모델(GM)을 도입한다. 생성 모델은 널스페이스 성분을 “가능한” 형태로 샘플링함으로써 Φ f = b 와 일치하도록 조정한다. 핵심 아이디어는 두 가지 제약을 동시에 만족시키는 것이다. 첫째, 일관성(consistency) – 생성된 f̂가 Φ f̂ = b 를 정확히 만족하도록; 둘째, 충실도(fidelity) – 생성된 f̂가 실제 데이터 분포 p(f)와 가깝도록. 이를 위해 저자들은 흐름 기반 생성 모델(FGM, Flow‑based Generative Model)을 선택한다. FGM은 역변환이 가능한 구조이므로, 스케치 요약을 입력으로 받아 널스페이스 성분을 직접 생성하고, 역변환을 통해 전체 f̂를 복원한다.

학습 단계에서는 실제 라벨(ground‑truth) 없이, 오직 집계된 카운터(b)만을 이용한다. EM 알고리즘을 변형해 E‑step에서 현재 파라미터로부터 널스페이스 샘플을 생성하고, M‑step에서 생성 모델 파라미터를 최대우도화한다. 이렇게 하면 라벨이 없는 환경에서도 모델이 데이터 흐름의 통계적 특성을 학습한다. 또한 FLORE는 스트림 필터링 기법과 인버터블 뉴럴 네트워크(INN) 아키텍처를 결합해 메모리 사용량을 1 MB 수준으로 제한하면서도 고속 추론(GPU 가속 시 수백 배)을 구현한다.

실험에서는 CAIDA‑2018, ISP 트래픽, 웹 로그 등 10개의 다양한 데이터셋을 사용해 9개의 최신 스케치·CS·학습 기반 방법과 비교한다. 결과는 다음과 같다. (1) 주파수 추정 오류는 평균 10³ 배 감소, (2) 엔트로피 및 전체 분포 추정 정확도는 10² 배 향상, (3) 헤비히터 탐지 점수는 80점 이상 상승, (4) 처리량은 기존 학습 기반 방법 대비 10‑100 배 빠르다. 특히 FLORE는 모델 재학습 없이도 스트림 특성이 변해도 안정적인 성능을 유지한다는 장점을 보인다.

요약하면, 논문은 선형 스케치의 근본적인 직교 정보 손실을 정확히 규명하고, 생성 모델을 통한 널스페이스 보완이라는 새로운 패러다임을 제시한다. FLORE는 무지도 학습, 가역적 구조, 경량화된 구현을 결합해 실시간 스트림 분석에 필요한 정확도·속도·자원 효율성을 모두 만족시키는 최초의 프레임워크라 할 수 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기