수학 문제 해결에서 구두점 잡음에 대한 LLM 내성 평가 ArithmAttack

초록

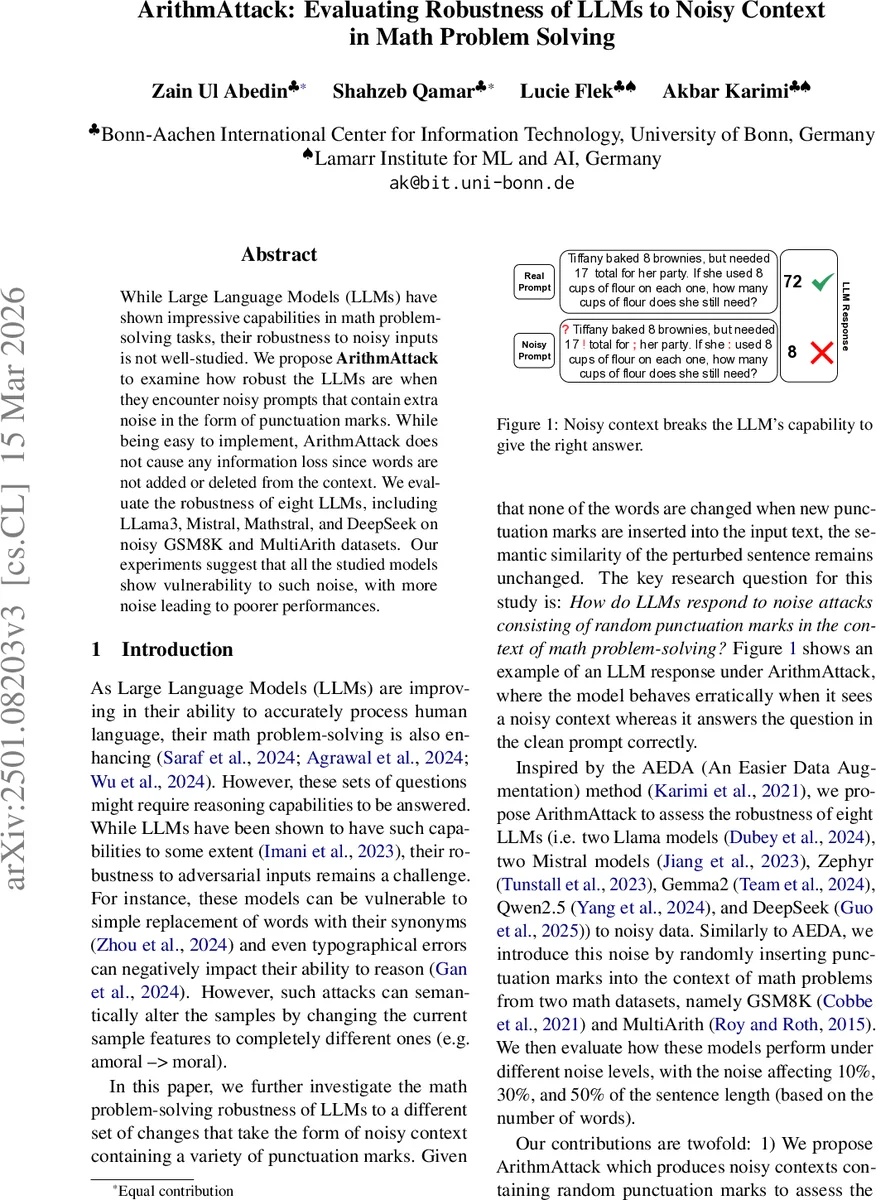

본 논문은 수학 문제 풀이 시 입력에 무작위 구두점을 삽입하는 간단한 공격인 ArithmAttack을 제안하고, GSM8K와 MultiArith 데이터셋에 대해 8개의 최신 LLM(Llama‑3, Mistral, Mathstral, DeepSeek 등)의 정확도와 공격 성공률(ASR)을 측정한다. 실험 결과 모든 모델이 구두점 잡음에 취약하며, 잡음 비율이 높을수록 성능이 급격히 저하됨을 확인한다. 특히 Llama‑3.1이 가장 높은 정확도와 낮은 ASR을 보이며 상대적으로 강인함을 나타낸다.

상세 분석

ArithmAttack은 기존의 문자 교체·동의어 치환 등 의미를 변형시키는 공격과 달리, 원문 단어를 그대로 유지하면서 무작위 위치에 “.,!?:;” 등 6가지 구두점을 삽입한다. 삽입 비율을 10 %, 30 %, 50 %로 설정해 문장 길이에 대한 비례적 잡음 수준을 조절한다. 구두점만 추가하므로 의미적 유사도는 Universal Sentence Encoder로 100 %를 기록, 즉 의미 손실이 없음을 보장한다. 평가에는 Zero‑Shot Chain‑of‑Thought 프롬프트를 사용해 모델이 단계별 추론을 수행하도록 유도했으며, 정확도와 Attack Success Rate(ASR)를 주요 지표로 삼았다. GSM8K(1,320개 테스트)와 MultiArith(180개 테스트) 두 데이터셋에 대해 각각 실험했으며, 모델은 1.5 B~8 B 파라미터 규모의 다양한 아키텍처를 포함한다. 결과는 전반적으로 잡음 비율이 증가할수록 정확도가 감소하고 ASR이 상승함을 보여준다. 특히 Zephyr‑7B는 가장 낮은 클린 정확도와 높은 ASR을 기록해 잡음에 가장 취약했으며, 반면 Llama‑3.1은 10 % 잡음에서도 99.44 %의 클린 정확도를 유지하고, 50 % 잡음에서도 83.88 %를 유지해 상대적 강인함을 입증했다. Mathstral이 Mistral보다 높은 정확도와 낮은 ASR을 보인 점은 수학 전용 사전학습이 잡음 내성에 긍정적 영향을 미칠 수 있음을 시사한다. 또한 GSM8K가 MultiArith보다 난이도가 높아 잡음에 더 큰 성능 저하를 보였으며, 이는 데이터 복잡도가 모델의 잡음 내성에 영향을 준다는 점을 강조한다. 한계점으로는 구두점 외의 철자·문법 오류 등 다른 잡음 유형을 다루지 않았으며, 실험에 사용된 모델과 데이터셋이 제한적이라는 점을 들 수 있다. 향후 연구는 다양한 잡음 형태와 더 넓은 데이터셋을 포함해 LLM의 추론 흐름을 분석하고, 왜 구두점 삽입이 논리적 사고를 방해하는지 메커니즘을 규명하는 것이 필요하다.

댓글 및 학술 토론

Loading comments...

의견 남기기