DepthLab 부분 깊이에서 완전 깊이까지

안내: 본 포스트의 한글 요약 및 분석 리포트는 AI 기술을 통해 자동 생성되었습니다. 정보의 정확성을 위해 하단의 [원본 논문 뷰어] 또는 ArXiv 원문을 반드시 참조하시기 바랍니다.

초록

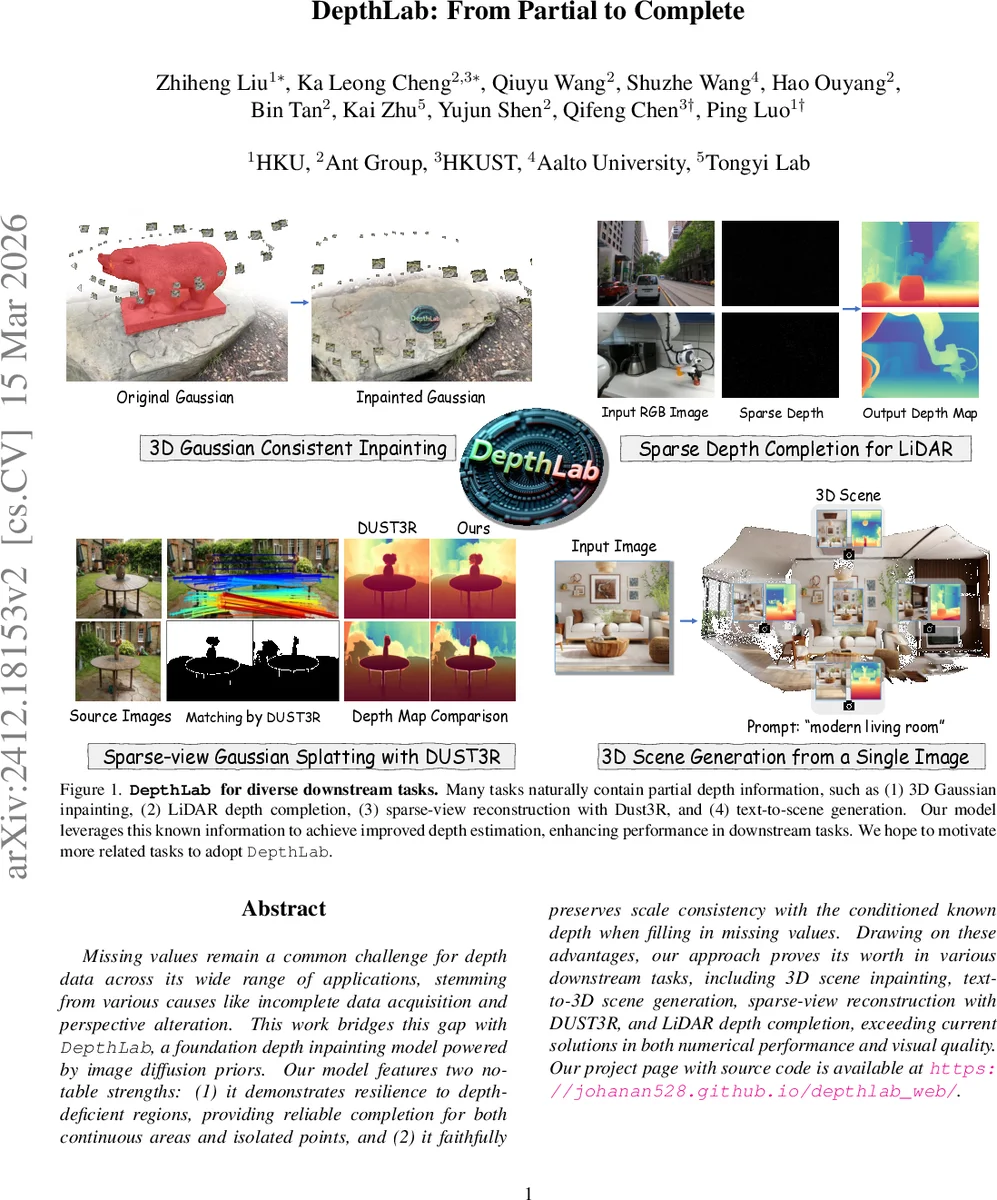

DepthLab은 이미지 확산 사전학습 모델을 활용한 깊이 인페인팅 기반 모델이다. 알려진 깊이 영역을 조건으로 사용해 손실된 깊이 영역을 복구하면서 스케일 일관성을 유지한다. 합성 RGB‑D 데이터만으로 학습되며, 3D 씬 인페인팅, 텍스트‑투‑3D 생성, Sparse‑View 재구성, LiDAR 깊이 보완 등 다양한 다운스트림 작업에서 기존 방법을 능가한다.

상세 분석

본 논문은 깊이 인페인팅을 위한 새로운 foundation model인 DepthLab을 제안한다. 핵심 아이디어는 RGB 이미지와 부분 깊이 정보를 동시에 활용하는 이중‑branch diffusion 프레임워크이다. 첫 번째 브랜치인 Reference U‑Net은 Stable Diffusion V2 기반의 Marigold 모델을 그대로 사용해 RGB 이미지에서 풍부한 시맨틱 특징을 추출한다. 두 번째 브랜치인 Estimation U‑Net은 VAE 인코더를 통해 얻은 깊이 라티스와 마스크 라티스를 입력으로 받아, 노이즈가 추가된 깊이 라티스와 결합한다. 두 네트워크는 레이어‑별 cross‑attention 방식을 통해 특징을 융합함으로써, RGB 기반의 전역적인 구조 정보와 알려진 깊이의 지역적인 스케일 정보를 동시에 반영한다. 특히 마스크는 VAE 인코더를 거쳐 4채널 라티스로 변환되어, 기존 이미지 인페인팅에서 흔히 발생하는 마스크 다운샘플링 손실을 최소화한다.

학습 단계에서는 알려진 깊이 영역의 최소·최대값을 이용해

댓글 및 학술 토론

Loading comments...

의견 남기기