디코드: 확산 압축 딥 토큰을 활용한 자동회귀 비디오 생성

초록

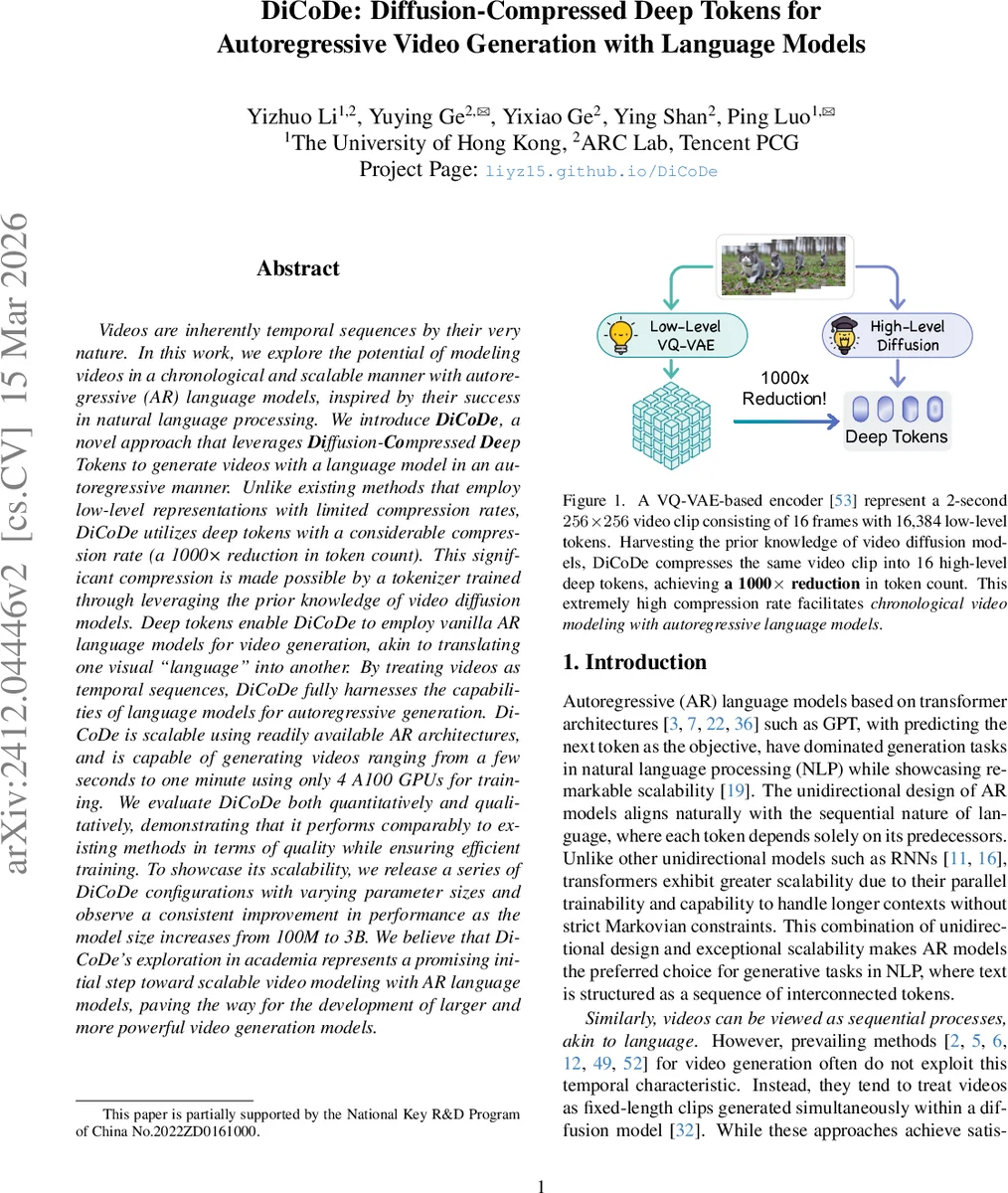

DiCoDe는 비디오를 고압축 연속 토큰(딥 토큰)으로 변환하고, 이를 기존의 자동회귀 언어 모델에 입력해 순차적으로 영상을 생성한다. 영상 확산 모델의 사전 지식을 활용해 2초 길이 영상을 16개의 토큰으로 압축해 1000배 토큰 수를 감소시켰으며, GMM 기반의 연속 토큰 확률 모델을 도입해 학습 안정성을 확보한다. 4대 A100 GPU만으로 100M~3B 파라미터 규모의 모델을 훈련시켜 1분 길이 영상까지 생성 가능함을 보였다.

상세 분석

DiCoDe는 “비디오 = 연속 토큰 시퀀스”라는 가설을 바탕으로, 기존 VQ‑VAE 기반 저압축 토큰이 초당 수천 개에 달해 자동회귀 트랜스포머에 적용하기 어려운 문제를 해결한다. 핵심은 두 단계 토크나이저이다. 첫 번째 단계는 이미지 인코더(E)와 쿼리 트랜스포머(Q)를 이용해 각 프레임을 N개의 고차원 피처로 변환하고, Q가 학습된 고정 쿼리 집합과 결합해 Nq개의 연속 토큰(딥 토큰)으로 압축한다. 두 번째 단계는 사전 학습된 비디오 확산 모델을 토크나이저의 디코더로 활용한다. 확산 모델은 딥 토큰을 조건으로 받아 짧은 클립(예: 2초)을 복원하도록 학습되며, 이는 “앞·뒤 프레임만으로 중간 프레임을 재구성할 수 있다”는 가정을 전제로 한다. 이 가정은 대규모 비디오 데이터에서의 높은 시간적 중복성을 이용한 것으로, 실험을 통해 충분히 만족함을 확인한다.

압축된 딥 토큰은 연속값이므로 전통적인 교차 엔트로피 손실이 적용되지 않는다. DiCoDe는 이를 해결하기 위해 토큰별로 가우시안 또는 가우시안 혼합 모델(GMM)을 예측하도록 설계하였다. 모델은 각 토큰에 대해 평균 μ와 분산 σ(또는 혼합 비중·각 컴포넌트의 μ, σ)를 출력하고, NLL 손실을 최소화한다. 이 접근법은 토큰 간 불확실성을 명시적으로 모델링함으로써 L2 손실이 초래하는 과도한 평균화 문제를 방지한다.

AR 언어 모델은 기존 GPT‑style 트랜스포머를 그대로 사용한다. 텍스트 프롬프트를 토큰 시퀀스 앞에 배치하고,

댓글 및 학술 토론

Loading comments...

의견 남기기