언어 모델로 연결하는 얼굴 움직임 이해와 애니메이션

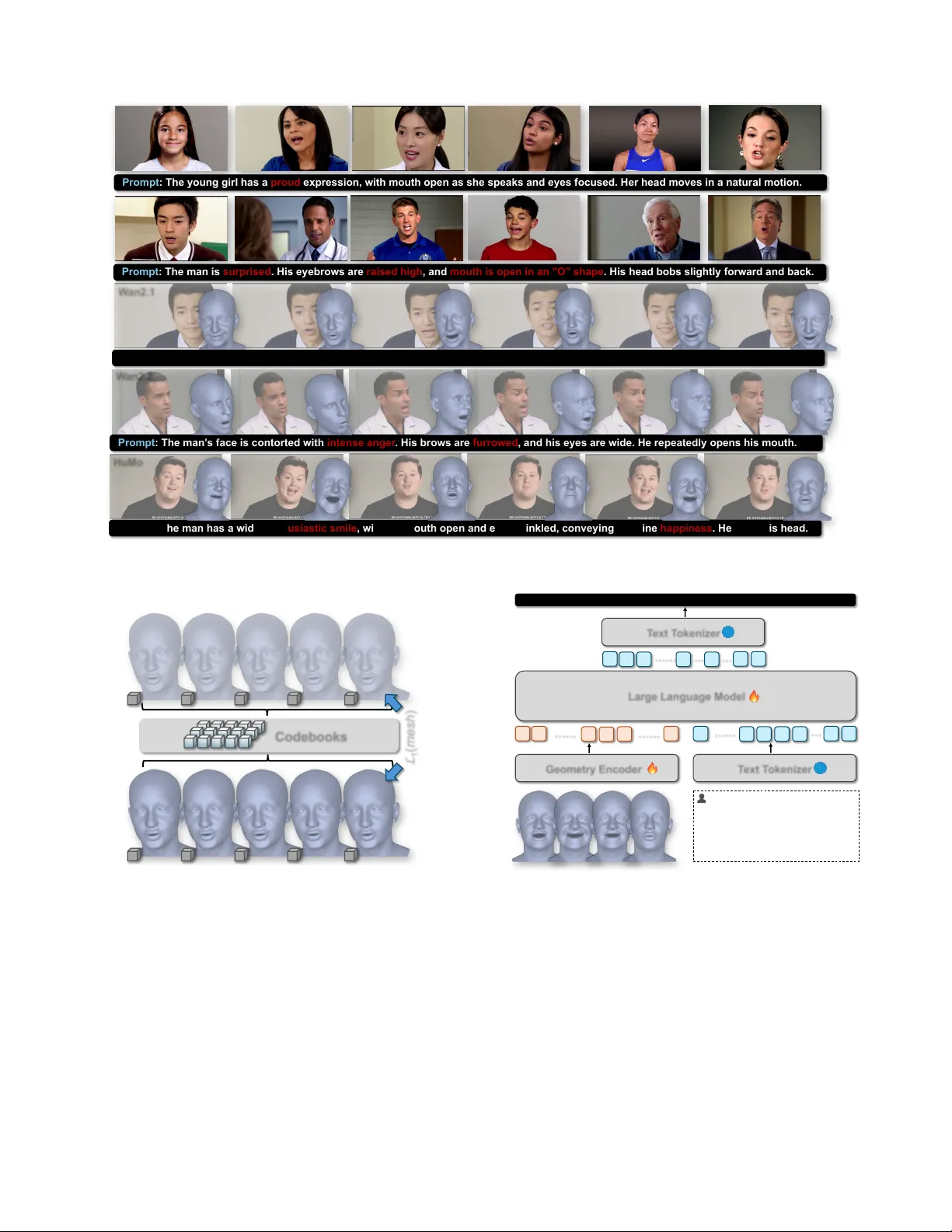

본 논문은 대규모 합성 얼굴 비디오와 3DMM 파라미터를 이용해 텍스트와 얼굴 움직임을 짝지은 Open3DFaceVid 데이터를 구축하고, 이를 기반으로 언어 모델을 확장해 (1) 얼굴 움직임 → 자연어 설명(Motion2Language)과 (2) 텍스트 → 얼굴 움직임 생성(Language2Motion) 양방향 능력을 입증한다. 기하학 토큰화와 VQ‑VAE를 활용해 이미지 토큰을 대체함으로써 토큰 효율성을 크게 높였으며, 실험을 통해 높은 정…

저자: Luchuan Song, Pinxin Liu, Haiyang Liu

**1. 서론**

텍스트‑기반 인간 몸 동작 생성 기술은 급격히 발전했지만, 얼굴 애니메이션은 텍스트와 짝지어진 고품질 데이터가 부족해 뒤처져 있다. 기존 얼굴 데이터셋은 스튜디오 캡처에 의존하고 감정 라벨이 제한적이며, 이미지‑기반 비디오‑LLM은 프레임당 수천 개의 이미지 토큰을 필요로 해 미세 표정 표현에 부적합하다. 저자들은 “얼굴 움직임을 저차원 기하학 신호(3DMM)로 표현하고, 이를 언어 모델과 직접 연결하면 텍스트‑조건 얼굴 이해·생성이 가능할까?”라는 질문을 제기한다.

**2. 관련 연구**

텍스트‑투‑모션, 텍스트‑투‑비디오, 멀티모달 LLM 등 최신 연구를 정리하고, 특히 얼굴 분야에서 데이터 부족과 토큰 효율성 문제가 핵심 장애물임을 강조한다.

**3. Open3DFaceVid 데이터셋 구축**

- **프롬프트 설계**: 감정·표정·미세동작을 포함한 약 200개의 어휘를 기반으로, 주체(성별·연령·인종)와 동작(머리 움직임·카메라 고정) 템플릿을 결합한다.

- **다중 T2V 모델 활용**: Wan‑2.1/2.2, Open‑Sora, HuMo, VEOS 등 네 가지 최신 텍스트‑투‑비디오 모델을 병렬로 사용해 60 K개의 합성 클립(4‑6 초)과 10 K개의 실제 영상(와일드)까지 확보한다.

- **3DMM 피팅**: FLAME 모델을 이용해 각 프레임에서 얼굴 정체성, 표정, 머리 자세 파라미터를 추출한다. 결과적으로 80 시간 분량의 (텍스트, 3DMM 시퀀스) 쌍이 생성된다.

**4. 기하학 토큰화 (Geometry VQ‑VAE)**

연속적인 3DMM 파라미터를 직접 양자화하면 동일 표정이 서로 다른 코드에 매핑되는 문제점이 있다. 이를 해결하기 위해 메쉬 좌표를 입력으로 하는 VQ‑VAE를 학습, 4096 차원의 코드북을 구축한다. 재구성 손실(L1)과 코드북 정규화를 동시에 적용해 시각적으로 유사한 표정이 동일 토큰으로 압축되도록 한다.

**5. 언어‑동작 정렬 프레임워크**

- **Motion2Language**: 기하학 토큰 시퀀스를 LLM에 입력하고, 사전 정의된 “감정·강도·미세표정·머리 움직임” 템플릿에 따라 자연어 설명을 생성한다. 파라프레이즈를 추가해 데이터 다양성을 높였으며, GPT‑4와 인간 평가자를 통해 정량적 정확도(1‑5점)와 주관적 일관성을 측정했다.

- **Language2Motion**: 텍스트 프롬프트를 단어‑레벨 토큰화하고, 해당 임베딩을 자동회귀 트랜스포머 디코더에 조건화한다. 디코더는 기하학 토큰을 순차적으로 예측해 3DMM 시퀀스를 재구성한다. 토큰‑레벨 조건화는 단어 하나가 특정 근육 움직임을 직접 제어하도록 설계돼, 미세 표정 제어가 가능하다.

**6. 실험 및 평가**

- **Motion2Language**: 제안 모델은 HumanOmni와 Gemini‑2.5 VLM 대비 감정 정확도(Cor E), 움직임 일치(Cor M), 강도 표현(Cor I) 모두에서 평균 0.5~1.0점 상승했다.

- **Language2Motion**: 정량적 지표(프레임‑레벨 L2 손실, 표정 유사도)와 정성적 평가(전문가 시각)에서 기존 텍스트‑투‑모션 파이프라인보다 우수했으며, 특히 “웃음”, “놀람” 등 고강도 감정과 머리 회전 제어에서 높은 재현성을 보였다.

- **토큰 효율성**: 이미지‑기반 비디오‑LLM이 초당 2 000~3 000 토큰을 요구하는 반면, 기하학 토큰은 초당 20~30 토큰으로 감소, 연산 비용 및 메모리 사용량이 크게 절감되었다.

**7. 논의 및 한계**

합성 데이터가 실제 촬영 영상과 완전히 일치하지 않아 도메인 갭이 존재한다. 현재 FLAME 모델은 얼굴 형태와 근육 디테일에 제한이 있어, 고해상도 미세표정 재현에 한계가 있다. 또한, 텍스트 프롬프트가 복합적인 감정·동작을 동시에 기술할 경우 토큰‑레벨 매핑이 복잡해질 수 있다.

**8. 결론 및 향후 연구**

TDMM‑LM은 “얼굴 파라미터 ↔ 텍스트” 양방향 정렬을 최초로 구현해, 텍스트 기반 얼굴 이해와 애니메이션을 하나의 통합 프레임워크로 제시한다. 향후 실제 촬영 데이터와의 혼합 학습, 보다 정교한 얼굴 근육 모델, 음성·텍스트·영상 멀티모달 감정 인식과의 통합이 연구 방향으로 제시된다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기