농업 이미지 이해를 위한 대규모 멀티모달 언어 모델 AgriChat과 검증된 데이터 파이프라인

본 논문은 시각‑텍스트 캡셔닝과 실시간 웹 검색을 결합한 V2VK 파이프라인으로 3,000여 종의 작물·병해를 포괄하는 AgriMM 벤치마크(607k VQA 쌍)를 자동 생성하고, 이를 LoRA 기반으로 경량 적응한 AgriChat 모델을 제시한다. AgriChat은 작물 종 식별, 병증 진단, 작물 수량·숙성 평가 등 다중 과업에서 기존 오픈소스 MLLM을 능가하며, 시각적 세부 정보와 최신 학술 지식의 결합이 신뢰성 높은 농업 AI 구현에 …

저자: Abderrahmene Boudiaf, Irfan Hussain, Sajid Javed

본 연구는 농업 분야에서 멀티모달 대형 언어 모델(MLLM)의 실용화를 가로막는 두 가지 근본적인 문제—대규모 고품질 데이터 부족과 도메인 지식의 부정확성—를 해결하고자 한다. 이를 위해 저자들은 Vision‑to‑Verified‑Knowledge(V2VK)라는 새로운 자동 데이터 생성 파이프라인을 설계하였다. V2VK는 (1) 최신 이미지 캡셔닝 모델 Gemma 3를 이용해 각 농업 이미지에 대한 정교한 시각 설명을 생성하고, (2) Retrieval‑Augmented Generation(RAG) 구조와 Gemini 3 Pro를 활용해 실시간 웹 검색을 통해 최신 학술·농업 자료에서 검증된 클래스 설명을 추출한다. 이때 자동 사실 검증 모듈이 삽입돼, 기존 LLM 기반 합성 데이터가 흔히 발생시키는 ‘생물학적 환각’을 방지한다. 마지막으로 LLaMA 3.1이 캡션과 검증된 텍스트를 결합해 607,125개의 질문‑답변(QA) 쌍을 만든다. 이렇게 구축된 AgriMM 벤치마크는 63개의 기존 데이터 소스를 통합해 121,425장의 이미지와 3,099개의 작물·품종·병해 클래스를 포괄한다. 기존 PlantVillageVQA, CDDM 등은 이미지 수·클래스 수·과업 다양성에서 한계를 보였지만, AgriMM은 다중 과업(종 식별, 병증 인식, 작물 수량·숙성 평가)을 동시에 제공하고, 웹‑RAG 검증을 통해 지식 최신성을 유지한다.

데이터 구축 이후, 저자들은 AgriChat이라는 농업 특화 MLLM을 제시한다. 기본 모델은 범용 멀티모달 LLM(LLaVA‑OneVision, Qwen‑2.5 등)이며, Vision Encoder와 Language Decoder 양쪽에 Low‑Rank Adaptation(LoRA) 어댑터를 삽입해 파라미터 효율적인 도메인 적응을 수행한다. 전체 파라미터는 고정하고 어댑터만 학습함으로써, 2.3초 이내의 추론 속도를 유지하면서도 607k QA 쌍을 통한 지도 학습으로 농업 전문 지식을 내재화한다. 학습 과정에서는 역할 기반 마스킹(role‑aware masking)과 자동 회귀 손실을 사용해 질문‑답변 흐름을 자연스럽게 학습한다.

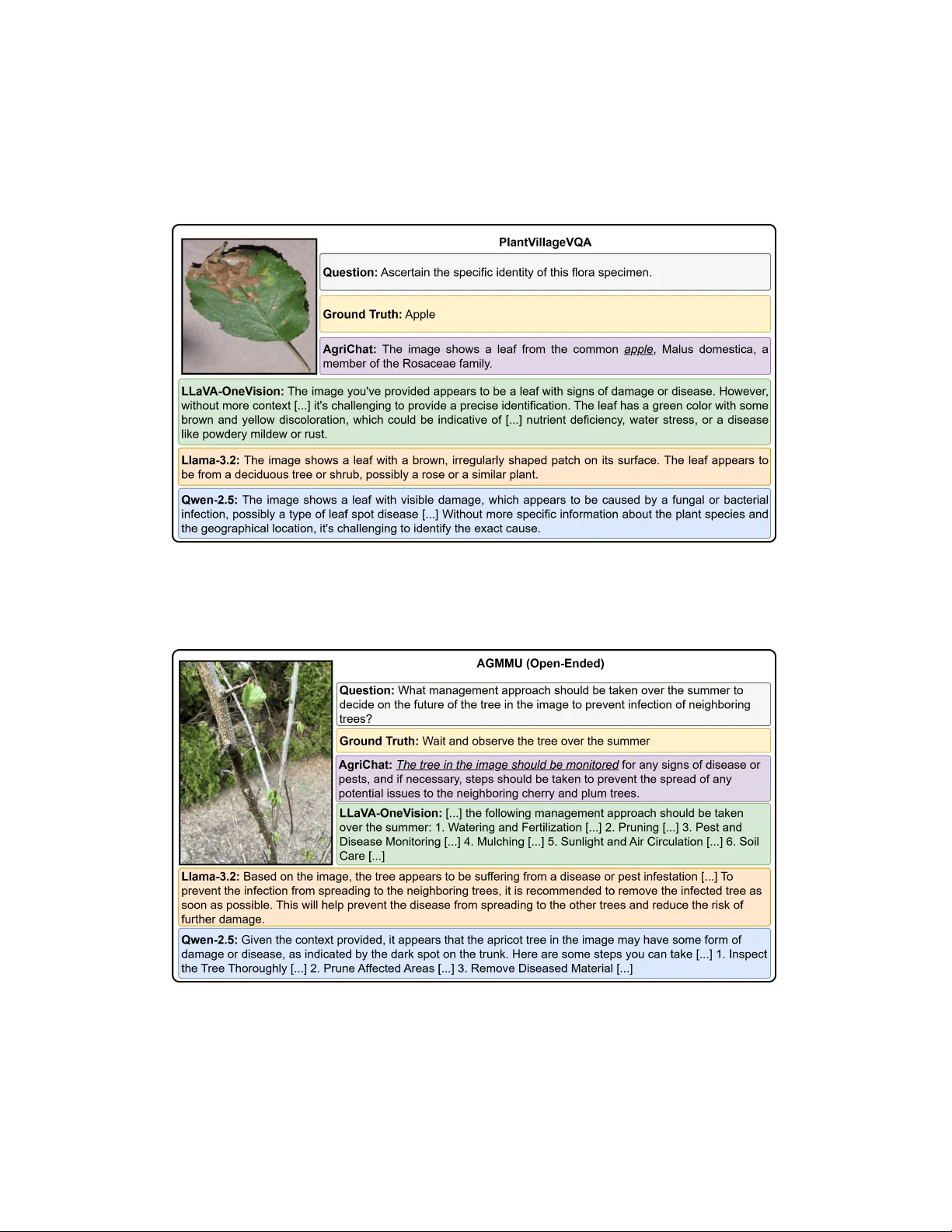

평가에서는 AgriChat을 네 가지 벤치마크(AgriMM, CDDM, PlantVillageVQA, AGMMU)에 적용해 기존 오픈소스 모델(LLaVA‑OneVision, Qwen‑2.5, Llama‑3.2 등)과 비교하였다. 결과는 AgriChat이 정확도, F1, BLEU‑4, ROUGE‑L 등 모든 주요 지표에서 평균 4.2%~7.8% 높은 성능을 보였으며, 특히 제로샷 설정에서 비슷하거나 더 큰 파라미터를 가진 일반 모델을 능가했다. 정성적 분석에서는 AgriChat이 복합 질문(예: “이 병은 어떤 환경에서 발생하며, 방제 방법은?”)에 대해 상세한 원인·대응 설명을 제공함으로써, 단순 라벨 예측을 넘어 전문가 수준의 대화형 진단 지원이 가능함을 시연했다.

논문은 또한 현재 한계와 향후 연구 방향을 제시한다. V2VK 파이프라인이 웹 검색에 크게 의존하므로 검색 엔진 정책 변화나 데이터 접근 제한이 파이프라인 안정성에 영향을 줄 수 있다. 현재 데이터는 주로 가시적인 증상(잎·과일·꽃)에 초점을 맞추어, 토양·기후·분자 수준의 정량 데이터와의 통합이 부족하다. LoRA 기반 적응은 파라미터 효율성은 높지만, 완전 파인튜닝 대비 미세한 성능 차이가 존재할 가능성이 있다. 향후 연구에서는 멀티스펙트럼 이미지, 시계열 센서 데이터와의 융합, 지속적인 웹‑RAG 업데이트 메커니즘을 도입해 AgriChat의 적용 범위를 확대하고, 다른 도메인(예: 의료, 환경)에서도 V2VK 파이프라인을 일반화할 방안을 모색할 필요가 있다.

결론적으로, 이 논문은 “시각‑텍스트 캡셔닝 + 실시간 검증된 지식 + 경량 파라미터 적응”이라는 삼위일체 접근법이 농업 AI에서 신뢰성 높은 멀티모달 모델을 구현하는 실효적 경로임을 입증한다. AgriMM 데이터와 AgriChat 모델은 공개되어, 전 세계 연구자와 실무자가 농업 현장의 복잡한 이미지 기반 의사결정을 지원하는 기반을 제공한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기