고해상도 세부 정보를 위한 효율적 이미지 크롭 프레임워크

AwaRes는 저해상도 전체 이미지를 먼저 보고, 질문에 따라 필요한 부분만 고해상도로 재요청하는 도구 호출 기반 멀티턴 구조를 제안한다. 자동 라벨링 파이프라인으로 “크롭 필요 여부”와 “증거 위치”를 생성하고, 차가운 시작 SFT와 다중턴 GRPO 학습으로 정확도와 연산 비용을 동시에 최적화한다. 실험 결과, 36 % 토큰만 사용해 80 % 수준의 고해상도 성능을 유지한다.

저자: Nimrod Shabtay, Moshe Kimhi, Artem Spector

본 논문은 고해상도 이미지가 요구되는 세부 시각 질문에 대해, 전체 이미지를 고해상도로 처리하는 기존 VLM의 비효율성을 극복하고자 하는 목표에서 시작한다. 고해상도 입력은 토큰 수와 연산량이 이미지 해상도에 제곱 비례해 급격히 증가하므로, 특히 대규모 멀티모달 모델에서 실시간 응답이나 비용 제한이 있는 서비스에 부적합하다. 저해상도 이미지만으로도 질문의 전반적인 맥락을 파악할 수 있다는 점에 착안해, 저해상도 전역 시각 정보를 먼저 활용하고, 필요 시에만 고해상도 영역을 선택적으로 조회하는 “Spatial‑on‑Demand” 프레임워크인 AwaRes를 제안한다.

AwaRes의 전체 파이프라인은 크게 세 단계로 구성된다. (1) **초기 저해상도 인퍼런스**: 입력 이미지 I를 다운샘플링해 I_low을 만든 뒤, 질문 q와 결합해 기본 VLM T가 초기 답변 후보 â_low와 “크롭 필요 여부”를 판단한다. (2) **크롭 결정 및 도구 호출**: 정책 π_θ는 저해상도 입력과 질문을 기반으로 사전 정의된 크롭 후보 집합 C 중에서 증거가 포함될 가능성이 높은 서브셋 C*를 선택한다. 선택된 크롭 c에 대해 고해상도 이미지 I_high c를 도구 호출을 통해 획득한다. (3) **다중턴 응답 생성**: 고해상도 크롭을 추가 입력으로 사용해 VLM이 최종 답변 â를 생성한다. 이때 저해상도 입력에 대한 KV‑Cache를 재활용해 연산 효율성을 유지한다.

핵심은 **자동 라벨링 파이프라인**이다. 동일 이미지‑질문 쌍에 대해 저·고해상도 VLM을 각각 실행해 두 답변을 얻고, LLaMA‑3.3‑70B 기반 라지 언어 모델(LaaJ)을 이용해 어느 답변이 정답에 더 가까운지 비교한다. 저해상도 답변이 충분히 정확하면 “No‑Crop” 라벨을, 고해상도 답변이 더 정확하면 “Crop‑Needed” 라벨을 부여한다. 이어서 오라클 그라운딩 모델이 고해상도 정답에 대한 시각적 증거 영역을 로컬라이즈하고, IoU 임계값 τ를 적용해 최종 크롭 후보 C*를 도출한다. 이렇게 생성된 (q, I_low, 라벨, C*) 튜플이 학습 데이터가 된다.

학습은 **Cold‑Start SFT**와 **Multi‑Turn GRPO** 두 단계로 진행된다. Cold‑Start SFT에서는 라벨링된 단일턴 데이터를 사용해 정책 π_θ와 초기 답변 생성기 T를 지도학습한다. 손실은 KL‑다이버전스와 정답 일치 손실을 결합한다. 이후 Multi‑Turn GRPO에서는 실제 도구 호출을 포함한 에피소드를 시뮬레이션해 강화학습을 수행한다. 보상 함수는 (i) 답변 정확도(정답 일치 여부)와 (ii) 사용된 고해상도 토큰 비율(또는 크롭 수) 사이의 가중합으로 정의돼, 정확도를 유지하면서 연산 비용을 최소화하도록 정책을 최적화한다.

구현상의 중요한 최적화는 **KV‑Cache 재사용**이다. 저해상도 입력에 대한 키‑값을 캐시해 두고, 이후 턴에서 고해상도 크롭을 추가 입력으로 넣을 때 기존 캐시를 그대로 활용한다. 따라서 추가 연산 비용은 실제 고해상도 토큰 수에 비례한다. 또한, 크롭 후보 집합 C는 중심 크롭, 좌·우·상·하 절반, 2×2 격자, 전체 이미지 등 9가지 형태와 전체 이미지를 포함해 설계돼, 정책이 간단한 다중 클래스 분류 문제로 학습될 수 있다.

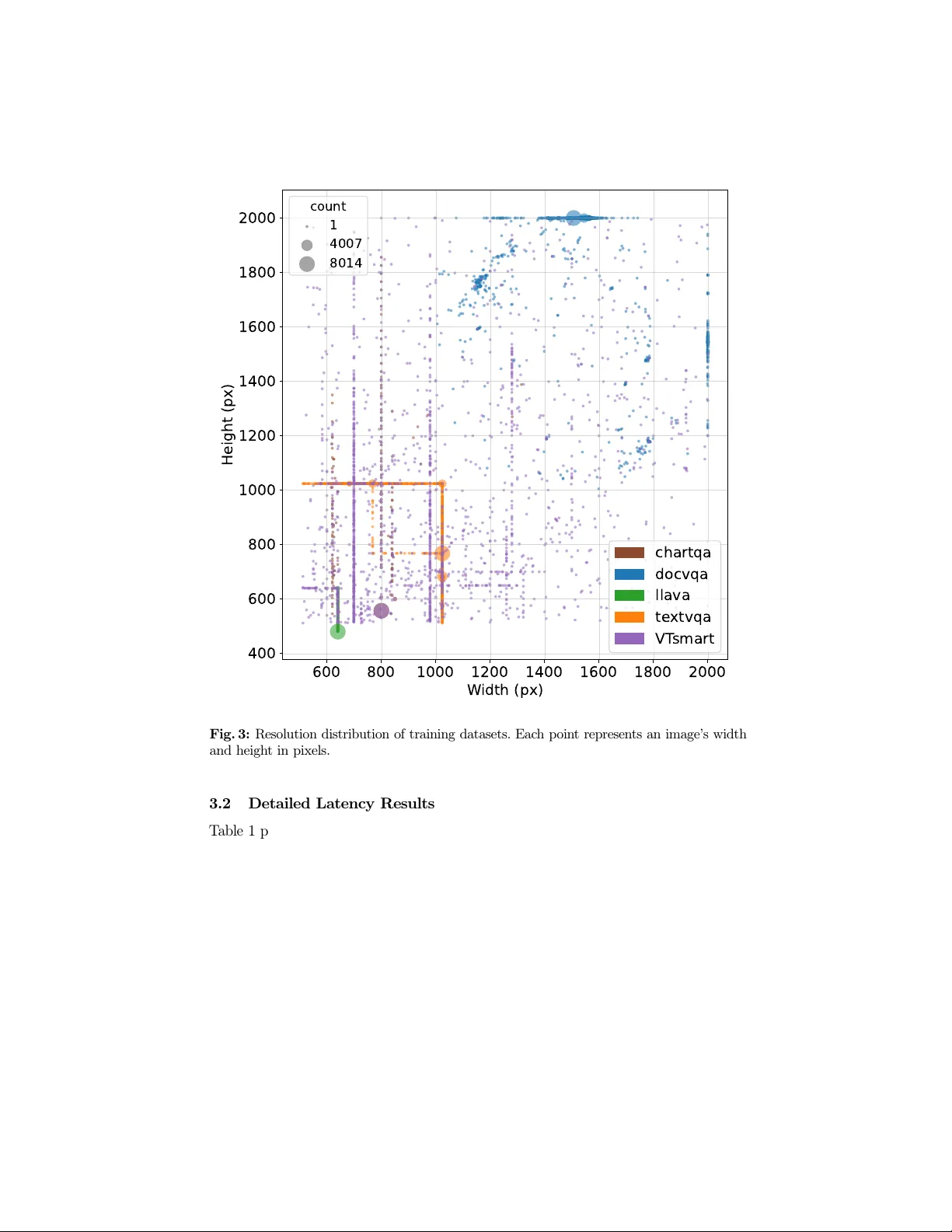

**실험**에서는 6가지 벤치마크(문서 QA, 차트 이해, OCR, DocVQA, ChartQA, OCR‑Bench)에서 AwaRes가 전체 고해상도 VLM 대비 평균 0.3 % 이하의 정확도 차이만 보이며, 사용 토큰은 36 % 수준으로 크게 감소한다. 특히 작은 텍스트나 표와 같이 고해상도 세부가 필수적인 경우에도 정책이 적절히 크롭을 선택해 정확도를 유지한다. Ablation 연구에서는 (i) 자동 라벨링 없이 수동 라벨링만 사용했을 때 정확도‑효율성 트레이드오프가 크게 악화되고, (ii) 크롭 비용 페널티를 제거하면 모델이 과도하게 많은 크롭을 요청해 토큰 사용량이 급증함을 확인했다.

**한계점 및 향후 연구**로는 (1) 사전 정의된 크롭 형태에 제한돼 복잡한 증거를 포착하기 어려울 수 있다는 점, (2) 오라클 그라운딩 모델의 품질에 라벨링 정확도가 크게 좌우된다는 점, (3) 현재는 단일 이미지‑질문 쌍에만 적용돼 멀티‑이미지(예: 비디오) 상황에 대한 확장이 필요하다는 점을 들었다. 향후 연구에서는 동적 크롭 후보 생성, 다중 이미지 연쇄 도구 호출, 라벨링 없는 RL‑HF(Reward‑Conditioned Fine‑Tuning) 접근 등을 탐색할 예정이다.

결론적으로 AwaRes는 “어디를 언제 보아야 하는가”라는 질문‑조건부 시각 탐색을 도구 호출과 강화학습으로 구현함으로써, 고해상도 세부 정보를 필요로 하는 복잡한 비전‑언어 작업에서도 연산 효율성을 크게 개선한다는 점에서 VLM 연구에 새로운 패러다임을 제시한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기