구조를 지키는 인스턴스 삭제 스테이크 기반 머신 언러닝

초록

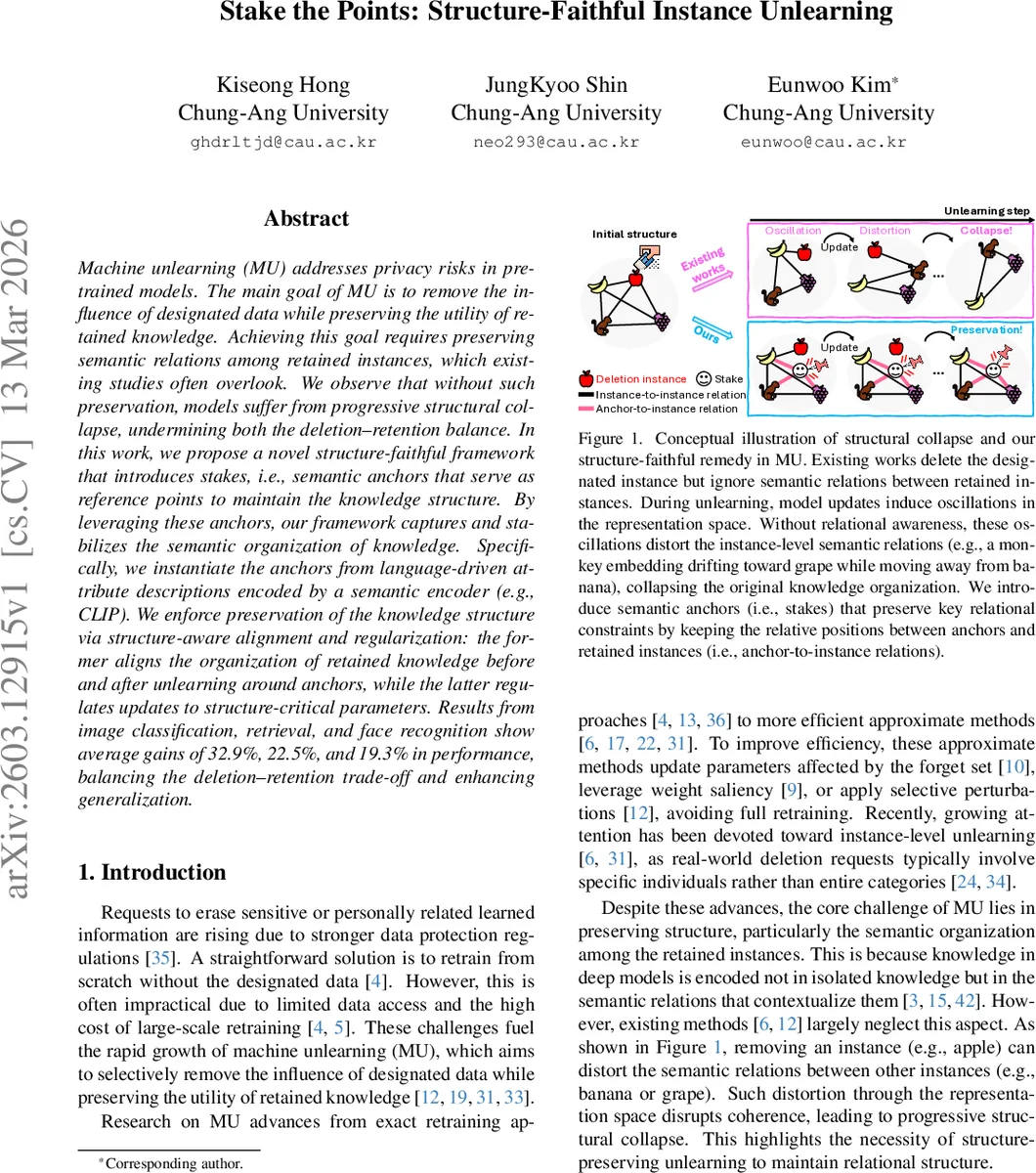

본 논문은 머신 언러닝 과정에서 삭제 대상 데이터를 제거하면서도 남은 데이터 간의 의미적 관계, 즉 구조를 보존하는 새로운 프레임워크를 제안한다. 텍스트 속성으로 만든 “스테이크”(semantic anchors)를 기준으로 인스턴스와 앵커 사이의 친화도를 정렬하고, 구조에 중요한 파라미터 업데이트를 억제하는 정규화를 적용한다. 이미지 분류·검색·얼굴 인식 실험에서 기존 방법 대비 평균 20‑30% 이상의 성능 향상을 입증한다.

상세 분석

이 논문은 머신 언러닝(MU)에서 가장 간과되기 쉬운 “구조 보존” 문제를 명확히 정의하고, 이를 해결하기 위한 두 단계의 메커니즘을 제시한다. 첫 번째는 semantic anchors(스테이크) 를 활용하는 것이다. 저자들은 각 클래스에 대해 대규모 언어 모델(Large Language Model)로부터 속성 설명을 생성하고, 이를 고정된 CLIP 기반 인코더에 입력해 고차원 앵커 벡터를 만든다. 이러한 앵커는 데이터 접근이 불가능한 상황에서도 일정한 의미적 기준을 제공한다는 점에서 매우 실용적이다.

두 번째는 구조‑인식 정렬(Structure‑aware Alignment) 과 구조‑인식 정규화(Structure‑aware Regularization) 라는 두 가지 손실 함수를 도입한다. 정렬 손실은 원본 모델의 인스턴스‑앵커 친화도 행렬 S_ori와 언러닝 후 행렬 S_unl 사이의 코사인 유사도를 최대화함으로써, 인스턴스가 앵커와 유지해야 할 상대적 위치를 보존한다. 이는 KL·Wasserstein 등 전통적인 분포 차이 측정보다 안정적인 정렬을 제공한다는 실험적 근거를 제시한다.

정규화 손실은 파라미터 업데이트가 구조에 미치는 영향을 정량화한다. 구체적으로, 각 파라미터에 대해 정렬 손실에 대한 기울기를 계산하고, 이 기울기의 크기를 가중치 I_i 로 사용해 파라미터 변화량을 억제한다. 즉, 구조에 민감한 파라미터는 크게 변하지 않도록 제한함으로써, 전체 모델이 앵커‑인스턴스 관계를 유지하도록 만든다.

또한, Retention Set이 접근 불가능한 상황을 가정하고, 삭제 대상 데이터로부터 생성한 적대적 변형(adversarial variants)들을 surrogate probe set D_s 로 활용한다. 이는 실제 retention 데이터 없이도 구조를 추정하고 정렬·정규화 손실을 계산할 수 있게 해준다.

실험에서는 CIFAR‑100, ImageNet‑subset, 얼굴 인식 데이터셋 등 세 가지 도메인에서 기존 MU 방법(Neg, Adv, L2UL 등)과 비교하였다. 구조 붕괴를 정량화한 “affinity shift” 지표에서 제안 방법이 현저히 낮은 값을 보였으며, 삭제‑보존 정확도 차이(Deletion‑Retention Gap) 역시 크게 감소했다. 특히, 삭제 인스턴스 수가 증가할수록 성능 격차가 확대되는 기존 방법과 달리, 제안 방법은 구조 보존 덕분에 안정적인 성능을 유지한다.

이러한 접근은 (1) 구조 보존이 삭제‑보존 트레이드오프에 결정적 역할을 함, (2) 언어‑시각 멀티모달 앵커가 데이터‑프리 상황에서도 강력한 기준이 될 수 있음, (3) 파라미터‑레벨 정규화가 구조‑민감 파라미터를 보호한다는 세 가지 핵심 인사이트를 제공한다. 향후 MU 연구는 구조‑지향적 손실 설계와 멀티모달 앵커 확장에 초점을 맞추면 더욱 실용적인 시스템을 구축할 수 있을 것으로 기대된다.

댓글 및 학술 토론

Loading comments...

의견 남기기