뇌 텍스트 통합 디코딩: 말하기와 듣기 모두를 아우르는 중국어 문장 복원

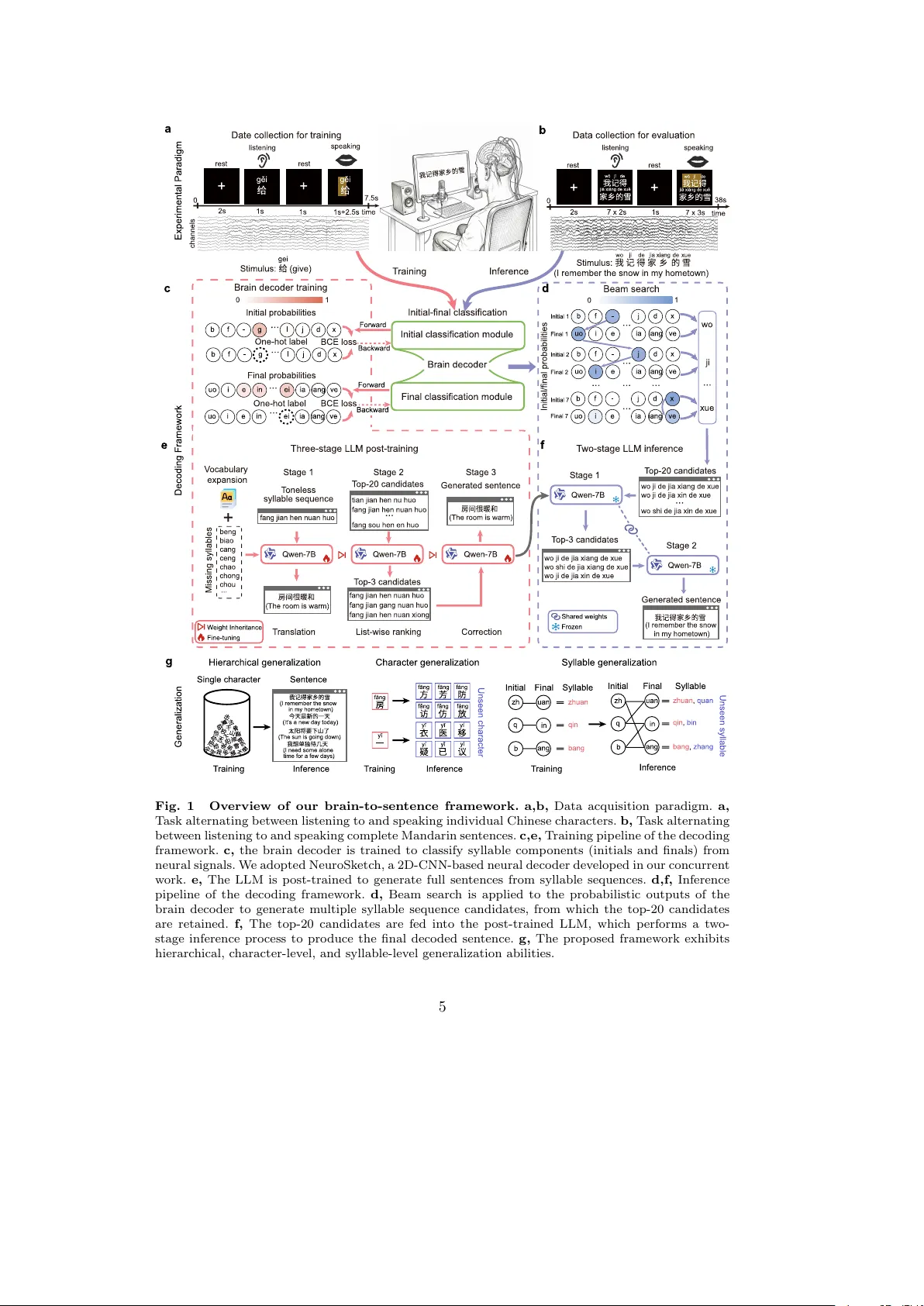

본 연구는 심부뇌전극(sEEG) 데이터를 활용해 말하기와 듣기 두 모달리티에서 동시에 작동하는 통합 뇌‑텍스트 디코딩 프레임워크를 제시한다. 초기·중성(초성·중성) 분류 후 톤 없는 핀인(Pinyin) 음절 시퀀스를 생성하고, 7 억 파라미터 규모의 대형 언어 모델(LLM)을 3단계 사후학습 및 2단계 추론 절차로 정교화해 문장을 복원한다. 훈련은 단일 문자 데이터만 사용했음에도 불구하고 전체 문장 수준에서 14.7%·21.8%의 문자 오류율(…

저자: Zhizhang Yuan, Yang Yang, Gaorui Zhang

본 논문은 인간의 일상 커뮤니케이션을 구성하는 말하기와 듣기 두 모달리티를 동시에 지원하는 통합 뇌‑텍스트 디코딩 프레임워크를 제안한다. 기존 연구는 주로 알파벳 기반 언어(영어, 네덜란드어 등)에서 단일 모달리티에 초점을 맞추었으며, 로고음절 언어인 중국어에 대한 연구는 제한적이었다. 저자들은 이러한 격차를 메우기 위해, 심부뇌전극(sEEG)으로 수집한 고해상도 뇌 신호를 활용해, 초성·중성(초성·중성) 분류 → 빔 서치 기반 음절 후보 생성 → 대형 언어 모델(LLM) 기반 문장 복원이라는 3단계 파이프라인을 구축하였다.

데이터 수집은 12명의 약물 저항성 간질 환자(7남 5여, 연령 13–56세)에게 7–17개의 깊이 전극을 이식해 수행되었다. 각 피험자는 두 차례의 실험을 진행했는데, 첫 번째는 단일 문자 듣기·말하기 과제로 초·중성 분류 모델 학습에 필요한 균형 잡힌 데이터셋을 확보하고, 두 번째는 전체 문장 듣기·말하기 과제로 모델의 최종 성능을 평가하였다. 청취와 말하기 과제는 시간적 정렬을 위해 교차 배치했으며, 이는 두 모달리티 간 신경 반응을 직접 비교할 수 있는 기반을 제공한다.

뇌 디코더는 2개의 동일한 2‑D CNN 모듈로 구성돼 각각 초성과 중성을 분류한다. NeuroSketch라는 자체 개발 CNN을 사용해, 전극 채널별 시간‑주파수 스펙트럼을 입력으로 초성 11종, 중성 15종을 다중 클래스 분류한다. 결과적으로 말하기 조건에서 초성 정확도 평균 59.5%, 중성 50.2%를, 청취 조건에서는 초성 58.9%, 중성 48.0%를 달성했다. 이는 무작위 수준(초성 9%·중성 6.7%)에 비해 현저히 높은 성능이며, 다중 피질 영역에서의 신호를 효과적으로 활용했음을 보여준다.

분류된 초·중성 확률은 빔 서치 알고리즘에 투입돼 각 문자에 대한 가능한 음절 시퀀스 후보를 생성한다. 빔 폭은 20으로 설정해 상위 20개의 후보를 유지한다. 여기서의 핵심 난제는 톤 없는 음절이 한자와 1:다 매핑 관계에 있어 매우 모호하다는 점이다. 이를 해결하기 위해 저자들은 7 억 파라미터 규모의 오픈소스 LLM(Qwen‑7B)을 선택하고, 세 단계의 사후학습을 진행했다.

1) 번역 단계: 톤 없는 음절 시퀀스를 직접 한문 문장으로 번역하도록 지도학습한다.

2) 리스트‑와이즈 랭킹 단계: 빔 서치로 생성된 20개 후보 중 정답에 가장 근접한 3개를 선택하도록 모델을 훈련한다.

3) 교정 단계: 선택된 3개 후보를 입력으로 최종 문장을 생성한다.

추론 시에는 두 단계(후보 선택 → 교정)만 수행한다. 이 과정에서 LLM은 후보 간 문맥적 일관성을 평가하고, 가장 자연스러운 문장을 출력한다.

성능 평가 결과, 말하기와 청취 모두에서 평균 문자 오류율(CER)이 각각 31.5%와 37.3%였으며, 최고 피험자에서는 14.7%와 21.8%까지 낮추었다. 특히, 훈련에 사용된 단일 문자 데이터만으로 전체 문장을 복원할 수 있었으며, 훈련에 포함되지 않은 문자·음절도 성공적으로 디코딩했다. 이는 ‘계층적 일반화(문장 수준)’, ‘문자 일반화(훈련에 없는 문자)’, ‘음절 일반화(훈련에 없는 음절)’라는 세 가지 일반화 능력을 동시에 만족한다는 의미다.

신경생리학적 분석에서는 세 가지 주요 관찰이 이루어졌다. 첫째, 말하기 시 활성화된 피질 영역이 청취보다 넓으며, 전두엽·두정엽·측두엽·전전두엽을 포함한 광범위한 네트워크가 동원된다. 둘째, 양 모달리티에서 반응이 높은 채널은 시간적 패턴이 유사하지만, 청취 반응은 말하기 반응에 비해 약 200 ms 정도 지연되는 것을 확인했다. 이는 청각 피드백이 말하기보다 뒤처진다는 기존 이론과 일치한다. 셋째, 좌·우 반구 간 디코딩 성능 차이가 미미해, 양측 피질이 언어 처리에 동등하게 기여함을 시사한다.

결론적으로, 이 연구는 (1) 로그음절 언어에서도 초·중성 수준의 뇌‑텍스트 매핑이 가능함을, (2) 제한된 파라미터 LLM이라도 적절한 사후학습과 후보 선택 전략을 통해 고차원 언어 복원에 충분히 활용될 수 있음을, (3) 말하기와 청취 사이의 신경역학적 차이를 정량화함으로써 다중 모달리티 뇌‑컴퓨팅 시스템 설계에 중요한 기초 데이터를 제공한다는 점에서 학문적·실용적 의의를 가진다. 향후 연구는 실시간 디코딩, 더 많은 피험자 확대, 그리고 다른 로고음절 언어(예: 일본어, 한국어) 적용을 통해 뇌‑텍스트 인터페이스의 범용성을 검증할 수 있을 것이다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기