아름다움만으로는 부족하다 최신 텍스트투이미지 모델이 학습 데이터 생성에 실패하는 이유

초록

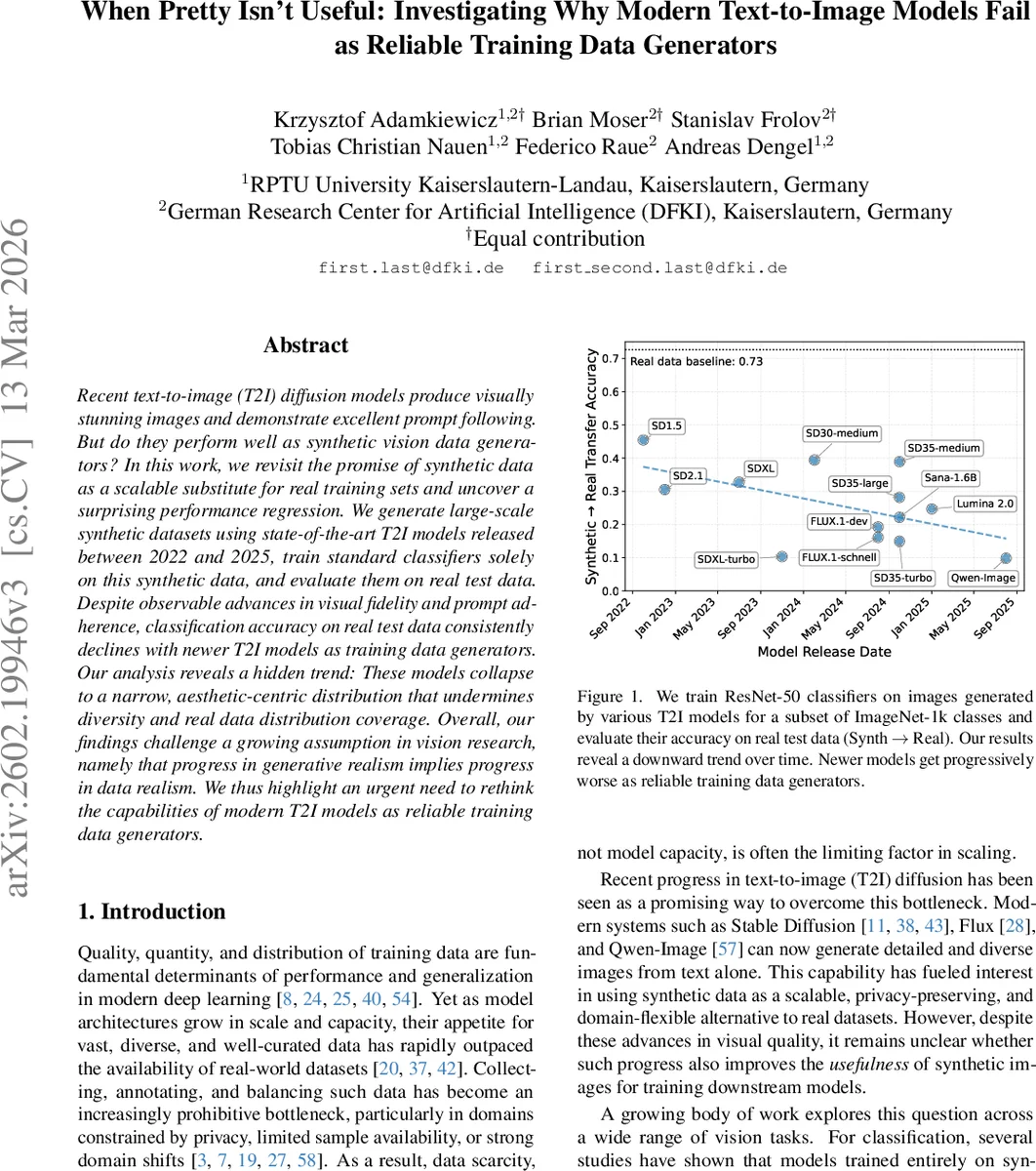

본 논문은 2022‑2025년 사이에 발표된 13개의 최신 텍스트‑투‑이미지 확산 모델을 이용해 대규모 합성 이미지 데이터를 생성하고, 이를 전적으로 학습 데이터로 사용한 이미지 분류기의 실제 테스트 성능을 평가한다. 시각적 품질과 프롬프트 충실도는 향상되었음에도 불구하고, 최신 모델일수록 실제 테스트 정확도가 감소한다. 저자는 텍스처·고주파 왜곡, 구조 보존, 그리고 분포적 드리프트와 다양성 붕괴를 정량·정성 분석하여, 최신 모델이 미학 중심의 좁은 데이터 분포에 수렴함을 밝혀낸다.

상세 분석

이 연구는 합성 데이터의 “샘플 현실성”(시각적 사실성)과 “분포 현실성”(실제 데이터와의 통계적 일치) 사이의 차이를 정밀히 구분한다. 먼저, 각 모델별로 ImageNet‑1K의 일부 클래스를 대상으로 10만 장 이상의 이미지를 생성하고, ResNet‑50을 학습시킨 뒤 실제 ImageNet‑validation에 평가하였다. 결과는 모델이 최신일수록 Synth→Real 정확도가 0.73(실제 데이터 기준)에서 0.42 이하로 급격히 떨어지는 패턴을 보였다.

텍스처와 구조의 영향을 분리하기 위해 두 가지 특수 분류기를 도입했다. 깊이 맵을 이용한 구조 전용 ResNet‑50은 텍스처 정보를 제거하고 형태만 학습하도록 설계되었으며, 반면 9×9 패치 기반 BagNet은 텍스처에만 의존한다. 실험 결과, 최신 모델은 구조 정보는 비교적 유지하지만 텍스처와 고주파 성분이 크게 손상되어 BagNet 성능이 현저히 낮았다. 이는 고해상도 디테일이 부족함을 의미한다.

고주파 왜곡을 정량화하기 위해 이미지에 저·고역통과 필터를 적용하였다. 저역통과된 이미지에서는 합성‑실제 간 성능 격차가 크게 감소했으며, 반대로 고역통과된 이미지에서는 격차가 확대되었다. 이는 최신 모델이 고주파 스펙트럼을 자연 이미지의 파워‑법칙과 일치시키지 못한다는 것을 시사한다.

분포적 드리프트와 다양성 붕괴는 CLIP‑ViT‑L 특징 공간에서 밀도(density)와 커버리지(coverage) 지표로 측정되었다. 최신 모델은 높은 밀도와 낮은 커버리지를 보였으며, 이는 생성 샘플이 실제 데이터의 일부 영역에 과도하게 집중(모드 붕괴)하고 전체 데이터 다양성을 충분히 포괄하지 못함을 의미한다. 또한 Real→Synth 전이 성능이 Synth→Real보다 현저히 높아, 실제 데이터로 학습된 모델은 합성 데이터의 클러스터를 쉽게 구분하지만, 합성 데이터로 학습된 모델은 실제 데이터의 복잡한 경계면을 재현하지 못한다는 역설적 현상이 관찰되었다.

프롬프트 상세화가 일부 성능 회복에 기여했지만, 이는 오히려 생성 매니폴드의 압축을 가속화시켜 다양성 손실을 심화시켰다. 결국, 시각적 미학이 향상된 최신 T2I 모델은 “학습용 데이터”라는 목적에 부합하지 않는, 제한된 미학‑중심 분포로 수렴한다는 결론에 도달한다.

댓글 및 학술 토론

Loading comments...

의견 남기기