단계 적응형 신뢰도 모델링으로 연속 감정 추정 성능 향상

초록

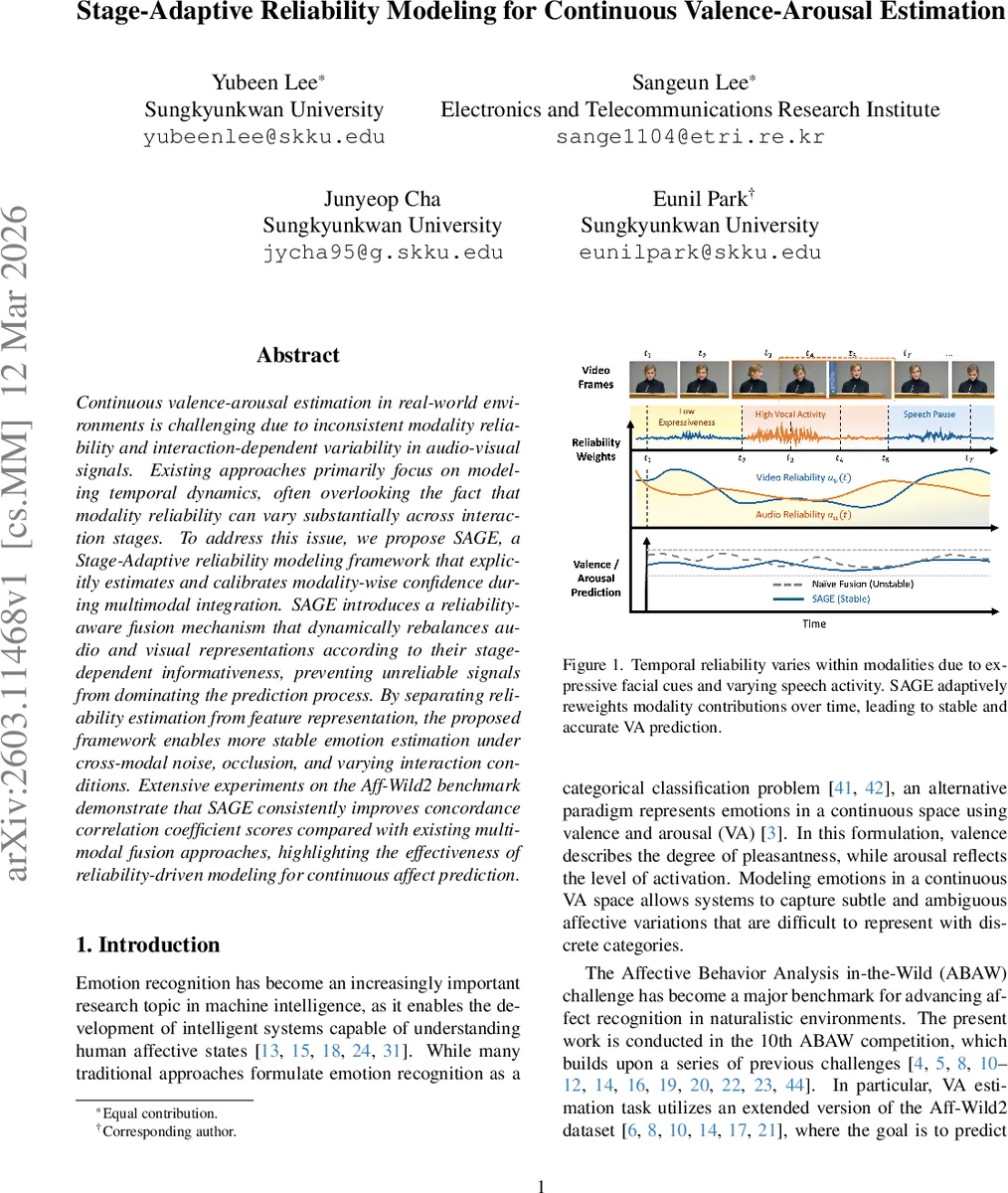

본 논문은 실시간 영상·음성 환경에서 감정의 연속적인 Valence‑Arousal(VA) 값을 추정할 때, 모달리티별 신뢰도가 시간에 따라 크게 변한다는 점에 주목한다. 이를 해결하기 위해 제안된 SAGE 프레임워크는 각 시간 단계에서 오디오와 비주얼 특징의 신뢰도를 별도로 추정하고, 신뢰도 가중치를 적용해 동적으로 융합한다. 신뢰도‑가이드 융합(RGF) 후에는 Transformer 기반의 시간 정제 모듈을 통해 장기 의존성을 보강한다. Aff‑Wild2 벤치마크에서 기존 멀티모달 융합 기법 대비 CCC 점수가 향상되어, 신뢰도 기반 적응형 융합이 연속 감정 예측에 효과적임을 입증한다.

상세 분석

SAGE는 ‘Stage‑Adaptive Reliability Modeling’이라는 이름에서 알 수 있듯이, 감정 추정 과정에서 모달리티 신뢰도의 시계열 변동성을 명시적으로 모델링한다는 점이 가장 큰 혁신이다. 기존 연구들은 주로 Cross‑Attention이나 Gating 메커니즘을 통해 모달리티 간 상호작용을 강화했지만, 신뢰도 자체를 추정·보정하는 단계는 거의 다루지 않았다. SAGE는 두 단계로 구성된다. 첫 번째 단계인 Reliability‑Guided Fusion(RGF)에서는 전체 멀티모달 특징 Xₜ에 선형 변환 Wᵣ를 적용해 스칼라 로그it gₜ를 얻고, Softmax를 통해 시간 축 전체에 걸친 정규화 가중치 αₜ를 계산한다. 이 αₜ는 해당 프레임에서 오디오와 비주얼이 얼마나 신뢰할 수 있는지를 나타내며, Zₜ = αₜ Xₜ 식으로 특징을 재스케일링한다. 이렇게 하면 잡음이 심하거나 얼굴이 가려진 구간에서 시각 특징의 영향력이 자동으로 감소하고, 음성 신호가 강하게 작용하는 구간에서는 반대로 가중치가 상승한다. 두 번째 단계인 Temporal Refinement Transformer는 재가중된 Z 에 대해 다중 헤드 셀프‑어텐션을 적용해 장기 의존성을 포착한다. 여기서 Transformer는 이미 신뢰도 보정된 입력을 다루므로, 모달리티 불균형이 남아 있더라도 효과적인 정보 교환이 가능하다. 실험에서는 ResNet‑50 기반 비주얼 인코더와 WavLM‑base 기반 음성 인코더를 사용하고, TCN으로 단기 시계열을 전처리한다. CCC 기반 손실 함수를 직접 최적화함으로써 평가 지표와 학습 목표를 일치시켰다. 결과적으로 Valence에서 0.509, Arousal에서 0.674의 CCC를 달성했으며, 평균 0.591로 기존 베이스라인보다 안정적인 성능을 보였다. 다만, SAGE는 신뢰도 추정을 위한 단순 선형 레이어만 사용해 복잡한 환경(예: 다중 화자, 배경음악)에서는 한계가 있을 수 있다. 향후 비선형 혹은 베이지안 방식의 신뢰도 추정, 그리고 텍스트 모달리티 통합을 고려한다면 더욱 견고한 감정 추정 시스템이 될 전망이다.

댓글 및 학술 토론

Loading comments...

의견 남기기