소형 언어 모델을 활용한 리더‑팔로워 역할 분류: 제로‑샷·원‑샷 적응 평가

초록

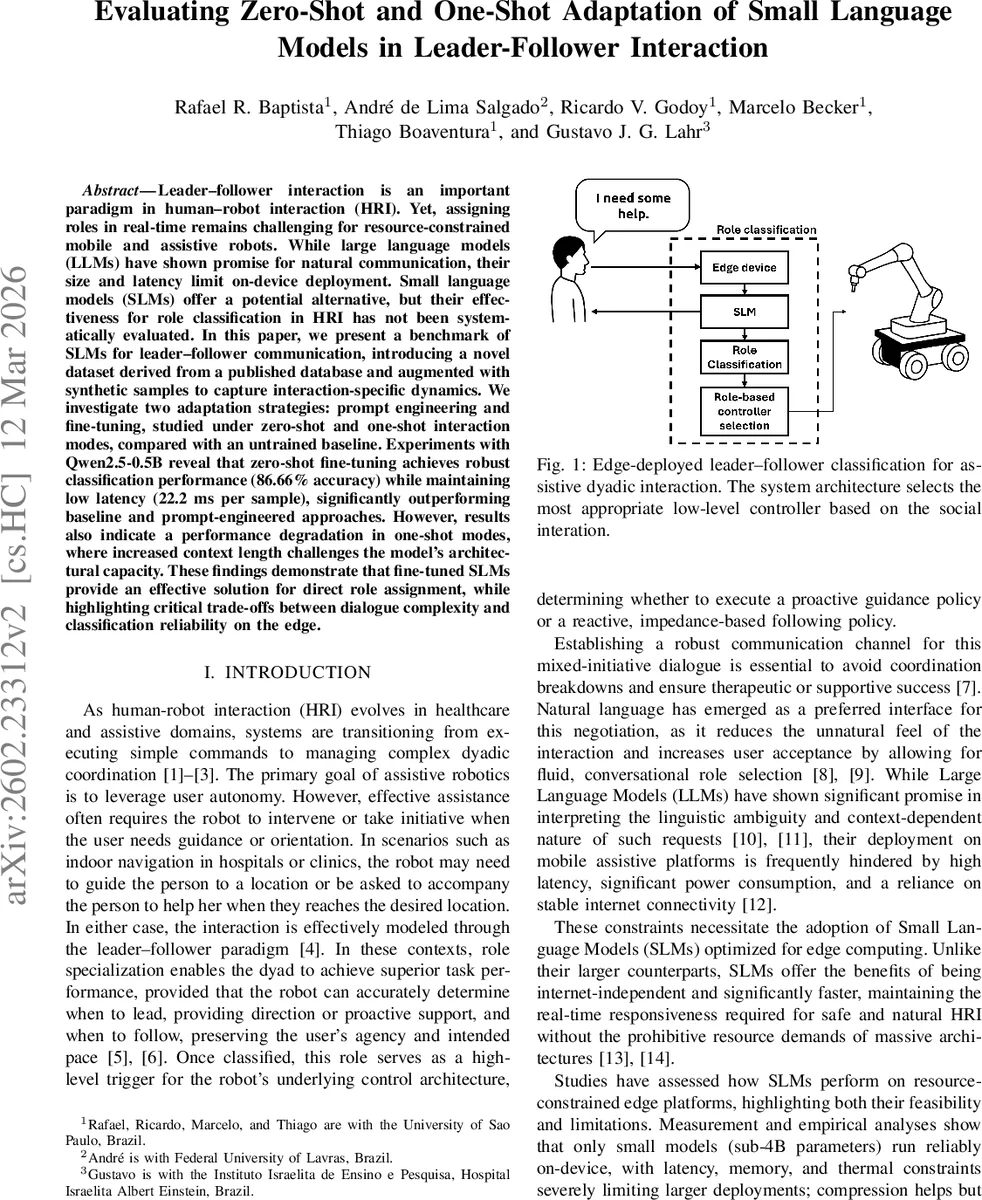

본 논문은 리더‑팔로워 역할을 실시간으로 판단해야 하는 인간‑로봇 상호작용(HRI) 환경에서, 파라미터 0.5 B인 Qwen2.5 모델을 기준으로 제로‑샷·원‑샷 설정에서 프롬프트 엔지니어링과 파인튜닝 두 가지 적응 방식을 비교한다. 5,400개의 합성·실제 질문을 포함한 새 데이터셋을 구축하고, 30회 Monte‑Carlo 교차검증을 수행했다. 파인튜닝된 제로‑샷 모델이 86.66 % 정확도와 22 ms의 저지연을 기록해 가장 우수했으며, 원‑샷에서는 컨텍스트 길이 증가로 성능이 약 35 %p 감소한다는 한계를 보였다.

상세 분석

이 연구는 소형 언어 모델(SLM)이 제한된 로봇 플랫폼에서 실시간 역할 분류를 수행할 수 있는지를 체계적으로 검증한다는 점에서 의미가 크다. 먼저, 기존 DailyDialog 데이터에서 리더‑팔로워 상황에 해당하는 415개의 질문을 추출하고, DeepSeek, Gemini, GPT‑4를 이용해 각각 6가지씩 패러프레이즈를 생성해 총 5,400개의 합성 샘플을 만든다. 합성 데이터의 의미 일관성은 Sentence‑BERT 기반 코사인 유사도로 평가했으며, GPT‑4가 0.83 ~ 0.85 정도의 높은 평균 유사도를 보이며 가장 품질이 높았다.

모델 선택은 Qwen2.5‑0.5B를 기반으로 했는데, 이는 파라미터 수가 0.5 B에 불과하면서도 최신 압축·지시 수행 능력이 뛰어나, 엣지 디바이스(NVIDIA Jetson 등)에서 20 ms 수준의 추론 지연을 달성한다는 기존 보고와 일치한다. 실험은 두 가지 인터랙션 모드로 설계되었다. 제로‑샷에서는 사용자의 최초 발화만으로 역할을 판단하고, 원‑샷에서는 모델이 하나의 명확화 질문을 생성한 뒤 사용자의 응답을 결합해 최종 판단을 내린다.

프롬프트 엔지니어링은 시스템 프롬프트 하나(제로‑샷) 혹은 두 개(원‑샷)로 구성했으며, 작은 모델의 한계를 보완하기 위해 명령을 세분화했다. 그러나 실험 결과, 프롬프트만으로는 정확도가 53 % 수준에 머물렀고, 토큰 처리량과 지연도 각각 86 tokens/s, 111 ms로 비효율적이었다. 반면 파인튜닝은 Autotrain 프레임워크를 이용해 10 epoch, 배치 16, FP16 혼합 정밀도로 진행했으며, 제로‑샷에서는 단일 파인튜닝 모델만으로 충분했지만 원‑샷에서는 명확화 질문 생성 전용 모델과 최종 분류 전용 모델을 별도로 학습시켰다.

성능 측면에서 제로‑샷 파인튜닝 모델은 86.66 % ± 6.77의 정확도와 22.2 ms ± 4.2의 지연을 기록, 토큰당 432 tokens/s의 처리량을 보이며 가장 우수했다. 원‑샷 파인튜닝은 정확도가 51.65 % ± 13.40으로 크게 떨어졌으며, 이는 입력 길이가 늘어나면서 0.5 B 모델의 컨텍스트 윈도우(보통 2 k 토큰 이하)를 초과해 메모리·주의 메커니즘이 붕괴된 것으로 해석된다. 또한 원‑샷 파인튜닝 모델은 토큰 수가 1,851 ± 380으로 급증했음에도 지연은 22 ms 수준을 유지했는데, 이는 GPU 가속과 배치 처리 최적화 덕분이지만 실제 로봇 시스템에서는 메모리 사용량과 전력 소모가 중요한 제약이 될 수 있다.

결론적으로, 작은 모델이라도 파인튜닝을 통해 제로‑샷 상황에서는 대형 모델에 필적하는 정확도와 실시간성을 확보할 수 있다. 그러나 원‑샷처럼 추가적인 대화 맥락을 요구하는 경우, 모델의 구조적 용량 한계가 성능 저하를 초래한다는 점을 명확히 보여준다. 이는 향후 연구에서 컨텍스트 압축, 라이트‑어텐션, 혹은 멀티‑모달 보조 정보를 활용해 작은 모델의 대화 이해 범위를 확장해야 함을 시사한다.

댓글 및 학술 토론

Loading comments...

의견 남기기