OpenVision 3: 이해와 생성 모두를 위한 통합 비전 인코더

초록

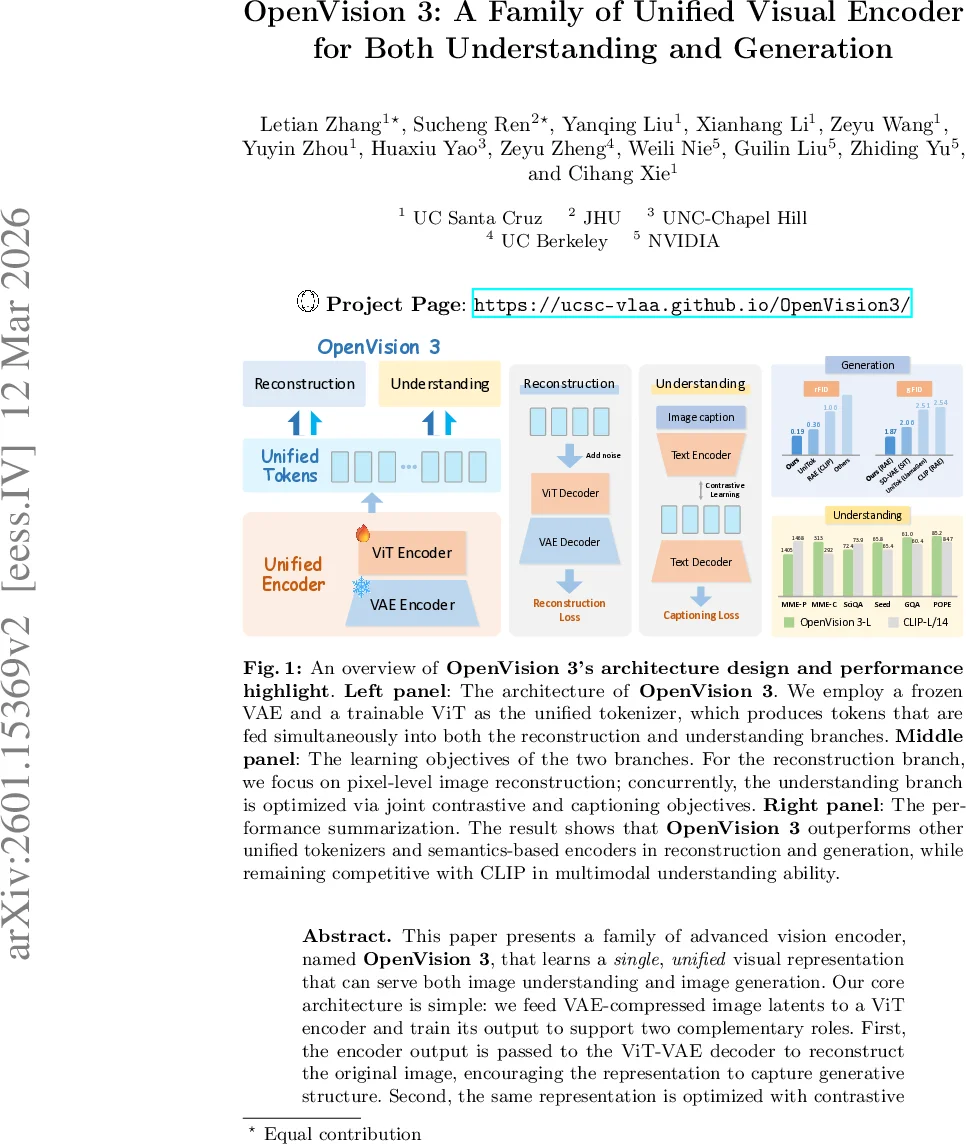

OpenVision 3은 VAE 압축 이미지 잠재공간에 ViT 인코더를 결합해 하나의 연속형 토크나이저를 학습한다. 재구성 손실을 통해 생성 구조를, 대비·캡션 손실을 통해 의미 정보를 동시에 학습함으로써, 고정된 인코더만으로 이미지 재구성·생성·멀티모달 이해 모두에서 CLIP 대비 경쟁력 있는 성능을 달성한다.

상세 분석

OpenVision 3은 기존 통합 토크나이저가 직면한 두 가지 주요 한계를 해결한다. 첫째, 이산화 과정에서 발생하는 양자화 오류를 피하기 위해 연속형 VAE 잠재공간을 그대로 활용한다. FLUX‑1 VAE를 사전학습된 상태로 고정하고, 이미지 → VAE 인코더 → 잠재벡터 z_vae 로 변환한 뒤, 2×2 패치 크기의 ViT 인코더(E_vit)로 고해상도(16×) 토큰 z_u 를 추출한다. 이 설계는 압축 비율 16배를 유지하면서도 공간 해상도를 충분히 보존한다는 점에서 효율적이다.

둘째, 재구성 브랜치와 이해 브랜치를 완전히 분리하면서도 동일 토큰 z_u 를 공유한다는 점이다. 재구성 브랜치는 토큰에 가우시안 노이즈 σ·ε 를 가한 뒤(ViT 디코더 → 1×1 패치 → 선형 레이어) VAE 디코더에 입력해 이미지 x̂ 를 복원한다. 손실 L_rec 은 픽셀 L1, 잠재 L1, 그리고 LPIPS 기반 퍼셉추얼 손실을 가중합한 형태이며, 이는 저수준 디테일 보존을 강제한다.

이해 브랜치는 대비 학습과 이미지 캡션 생성 두 축으로 구성된다. 텍스트 인코더가 추출한 캡션 임베딩 z_txt 와 시각 토큰 z_u 사이에 대비 손실 L_contrastive 를 적용해 양쪽을 정렬하고, 텍스트 디코더를 통해 자동회귀식 캡션 ĉ 를 생성해 캡션 손실 L_caption 를 계산한다. 전체 목표 L_overall = ω_rec·L_rec + ω_und·L_und 로, ω_und 를 ω_rec 보다 두 배 크게 설정해 의미 정보에 더 큰 비중을 둔다.

학습은 두 단계로 진행된다. 128×128 저해상도에서 4000 epoch(≈1.3M 샘플/epoch) 동안 대규모 배치(8192)와 학습률 8e‑6 로 사전학습하고, 이후 224/256 고해상도로 400 epoch(배치 4096, 학습률 4e‑7)에서 파인튜닝한다. 이때 LPIPS 손실은 저해상도 단계에서 비활성화해 해상도 차이에 따른 손실 충돌을 방지한다.

실험 결과는 세 가지 축에서 일관된 우수성을 보여준다. 재구성 측면에서는 ImageNet·COCO에서 rFID 0.187, PSNR 30.9 dB 등 기존 통합 토크나이저(예: UniToken, OmniTokenizer) 대비 크게 앞선다. 생성 측면에서는 RAE 프레임워크 하에 gFID 1.87을 기록해 CLIP 기반 인코더(2.54)보다 30% 이상 개선한다. 이해 측면에서는 LLaVA‑1.5·NeXT에 토크나이저를 그대로 삽입했을 때 SeedBench 63.3, GQA 59.2 등 CLIP(61.2, 58.1)과 근소 차이로 경쟁력을 유지한다.

특히 흥미로운 발견은 두 브랜치가 서로를 촉진한다는 점이다. 대비·캡션 손실만으로도 재구성 품질이 향상되고, 반대로 재구성 손실만으로도 의미 정렬이 개선된다. 이는 의미‑구조 상호보완성이 토큰 공간에 자연스럽게 녹아들어, 별도 두 인코더를 유지할 필요 없이 단일 토큰으로 양쪽 작업을 수행할 수 있음을 시사한다. 또한 VAE 잠재공간을 그대로 이용함으로써 고해상도 이미지 생성 시 디코더가 복잡한 픽셀‑레벨 디테일을 복원할 수 있게 된다.

전반적으로 OpenVision 3은 “연속형 통합 토크나이저”라는 새로운 패러다임을 제시하며, 복잡한 두‑스트림 구조를 단순화하면서도 성능 저하 없이 멀티모달 이해·생성 모두를 지원한다는 점에서 향후 UMM(통합 멀티모달 모델) 연구에 중요한 베이스라인이 될 것으로 기대된다.

댓글 및 학술 토론

Loading comments...

의견 남기기