제로스텝 최적화, 연속학습 망각 완화와 메모리 절감

안내: 본 포스트의 한글 요약 및 분석 리포트는 AI 기술을 통해 자동 생성되었습니다. 정보의 정확성을 위해 하단의 [원본 논문 뷰어] 또는 ArXiv 원문을 반드시 참조하시기 바랍니다.

초록

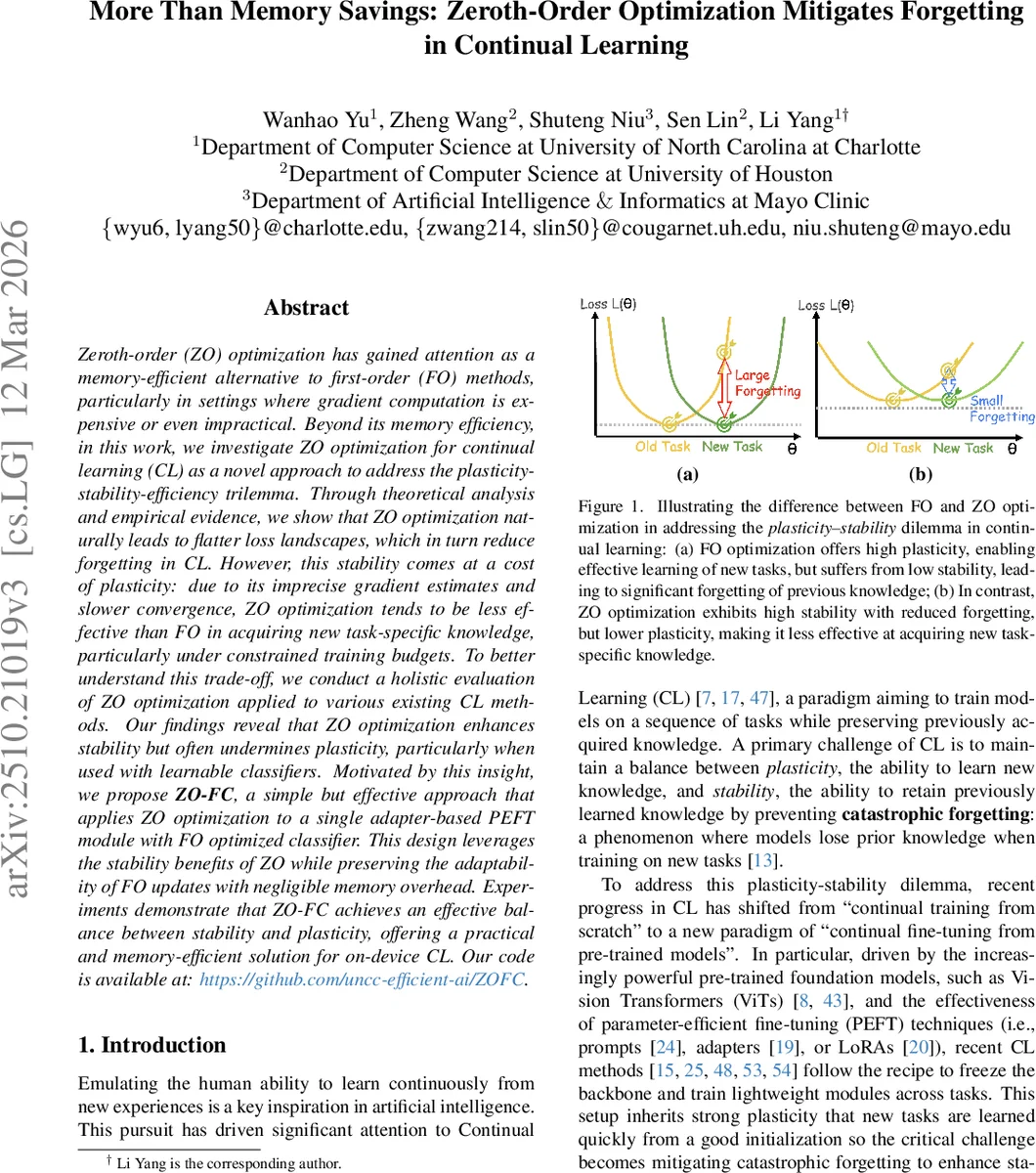

본 논문은 제로스텝(Zero‑Order, ZO) 최적화가 연속학습(Continual Learning, CL)에서 손실 평탄성을 자연스럽게 유도해 망각을 감소시키는 동시에 메모리 사용량을 크게 줄일 수 있음을 보인다. 그러나 ZO는 부정확한 그래디언트 추정과 느린 수렴으로 플라스티시티가 저하되는 단점을 갖는다. 이를 보완하기 위해 저자들은 어댑터 기반 PEFT 모듈에만 ZO를 적용하고, 분류기에는 기존 1차 최적화를 사용하는 ZO‑FC 방식을 제안한다. 실험 결과 ZO‑FC는 기존 최첨단 FO 기반 방법들과 비슷한 정확도를 유지하면서 훈련 메모리를 6배 절감한다.

상세 분석

이 논문은 연속학습에서 플라스티시티‑스테이빌리티‑효율성이라는 삼중고를 해결하기 위한 새로운 관점을 제시한다. 기존 PEFT 기반 CL 방법들은 사전학습된 대형 백본을 고정하고 가벼운 어댑터나 프롬프트를 학습함으로써 새로운 작업에 빠르게 적응하는 높은 플라스티시티를 보인다. 하지만 1차(FO) 최적화는 손실 곡면의 날카로운 최소점에 빠르게 수렴하는 특성 때문에 파라미터가 작은 변화에도 손실이 크게 증가하는 높은 라플라시안(λ_max) 값을 갖는 영역에 머무르게 된다. 이는 기존 작업의 손실이 급격히 상승해 망각이 발생한다는 기존 이론과 일치한다.

ZO 최적화는 파라미터를 직접 미분하지 않고 무작위 방향으로 작은 변동을 주어 함수값 차이를 통해 근사 그래디언트를 계산한다. 논문은 ZO 업데이트가 실제 손실 L(θ) 대신 L_ε(θ)=E_Δ

댓글 및 학술 토론

Loading comments...

의견 남기기