계층형 진행형 2D 가우시안 스플래팅을 이용한 확장 가능한 이미지·비디오 코덱

초록

본 논문은 2D 가우시안 스플래트를 기반으로 이미지와 비디오를 동시에 다룰 수 있는 계층형 진행형 압축 프레임워크 P‑GSVC를 제안한다. 베이스 레이어와 다수의 향상 레이어로 구성된 구조를 통해 해상도·품질 양쪽에서 점진적인 재구성이 가능하도록 설계했으며, 레이어 간 최적화 충돌을 방지하기 위해 모든 레이어를 동시에 업데이트하는 공동 학습 전략을 도입하였다. 실험 결과, 기존 순차적 레이어 학습 방식에 비해 영상 PSNR에서 최대 1.9 dB, 이미지 PSNR에서 최대 2.6 dB의 향상을 달성하였다.

상세 분석

P‑GSVC는 2D Gaussian Splatting(2DGS)을 명시적 프리미티브로 활용함으로써 기존의 암묵적 신경망 기반 스케일러블 코덱이 갖는 고비용 학습·디코딩 문제를 크게 완화한다. 핵심 아이디어는 가우시안 스플랫을 베이스 레이어(L₀)와 여러 향상 레이어(ΔL₁, ΔL₂, …)로 구분하고, 각 레이어가 추가될 때마다 이미지·비디오 품질이 점진적으로 개선되도록 하는 것이다. 여기서 가장 큰 기술적 난관은 레이어 간 상호 의존성이 강한 가우시안 파라미터가 독립적으로 최적화될 경우, 서로 충돌하는 그래디언트가 발생해 수렴이 불안정해지고 중간 품질이 크게 저하된다는 점이다. 이를 해결하기 위해 저자는 “공동 학습(joint training)” 방식을 제안한다. 학습 루프마다 현재 목표 레이어 i를 순환하면서, (i) 전체 레이어까지 사용한 고품질 재구성 손실과 (ii) i 레이어까지만 사용한 저품질 재구성 손실을 동시에 최소화한다. 이렇게 하면 각 레이어의 파라미터가 동일한 최적화 궤적을 공유하게 되어, 레이어 전환 시 그래디언트 급등 현상이 완화되고, 중간 단계에서도 안정적인 PSNR을 유지한다.

또한, P‑GSVC는 기존 3DGS 기반의 “프로그레시브 라피스(LapisGS)”와 달리 시간적 동적성을 고려한다. 비디오에서는 프레임 간 움직임, 조명 변화, 가려짐 등이 가우시안 스플랫의 옵시티와 위치 파라미터에 복합적인 영향을 미치므로, 레이어별 독립 학습은 특히 불안정해진다. 공동 학습은 이러한 시간적 상관관계를 자연스럽게 포착하도록 설계돼, P‑프레임 예측과 동적 키프레임 선택(DKS) 등 기존 GSVC의 메커니즘과도 원활히 결합된다.

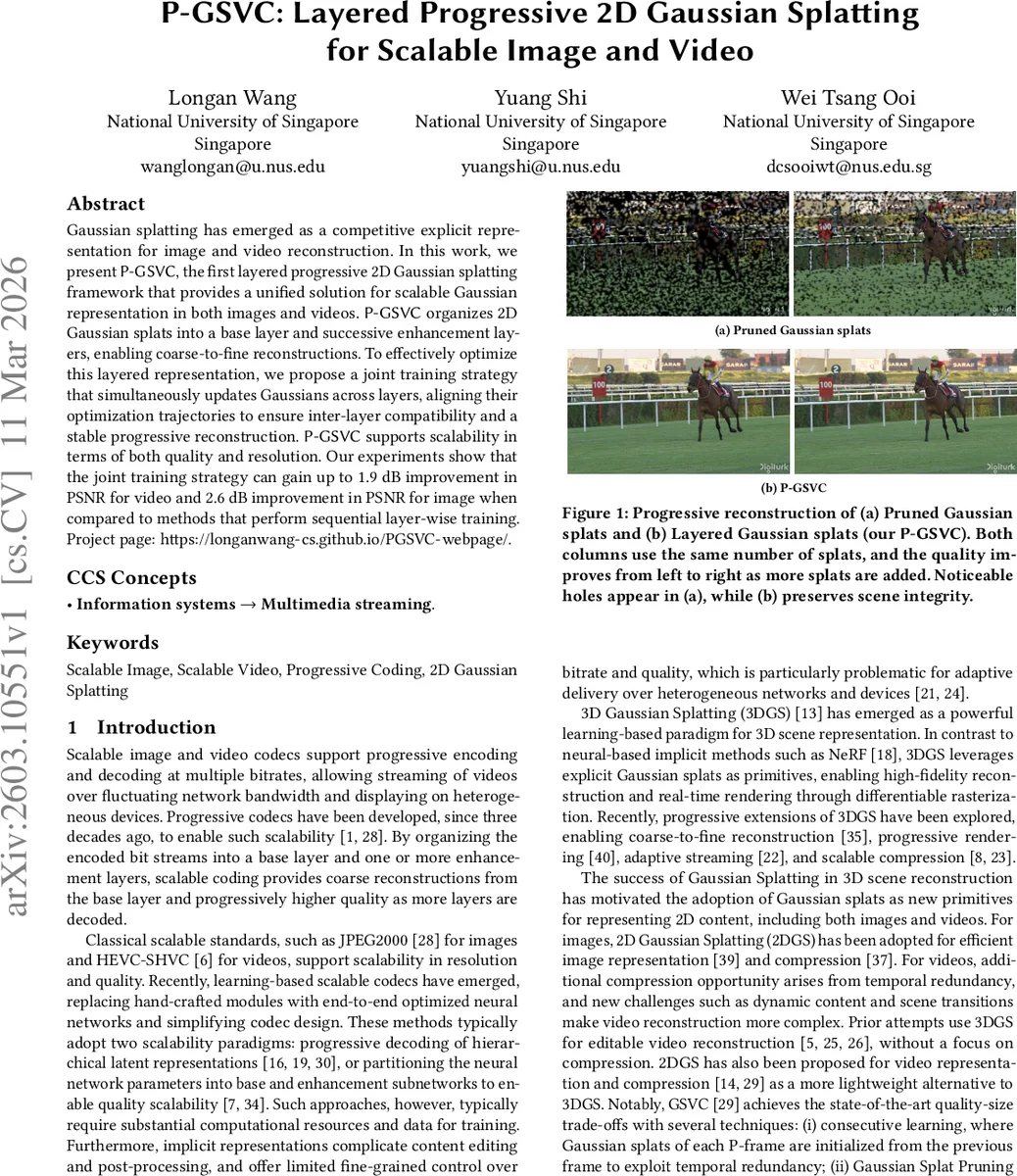

실험에서는 UVG 비디오 데이터셋과 DIV2K‑HR 이미지 데이터셋을 사용해, 순차적 레이어 학습 대비 PSNR 향상을 정량적으로 입증하였다. 특히, 동일한 스플랫 수(예: 50k)에서 베이스 레이어만 사용했을 때는 눈에 띄는 구멍이나 왜곡이 발생하지만, 레이어를 계층적으로 쌓은 P‑GSVC는 장면 일관성을 유지한다는 시각적 예시(Figure 1)를 제공한다. 또한, 학습 과정에서 손실과 그래디언트 변화를 비교한 Figure 2는 단일 레이어 학습이 더 낮은 최종 손실을 달성함을 보여주며, 이는 공동 학습이 안정적인 수렴을 보장함을 시사한다.

요약하면, P‑GSVC는 (1) 명시적 2D 가우시안 스플랫을 활용한 경량 프리미티브, (2) 베이스·향상 레이어 구조를 통한 품질·해상도 스케일러빌리티, (3) 레이어 간 최적화 충돌을 완화하는 공동 학습 전략이라는 세 가지 핵심 기여를 통해, 기존 암묵적 또는 3D 기반 스케일러블 코덱 대비 높은 압축 효율과 빠른 디코딩을 동시에 달성한다.

댓글 및 학술 토론

Loading comments...

의견 남기기