목소리 속 감정을 읽어 VR 대화 에이전트를 인간처럼

안내: 본 포스트의 한글 요약 및 분석 리포트는 AI 기술을 통해 자동 생성되었습니다. 정보의 정확성을 위해 하단의 [원본 논문 뷰어] 또는 ArXiv 원문을 반드시 참조하시기 바랍니다.

초록

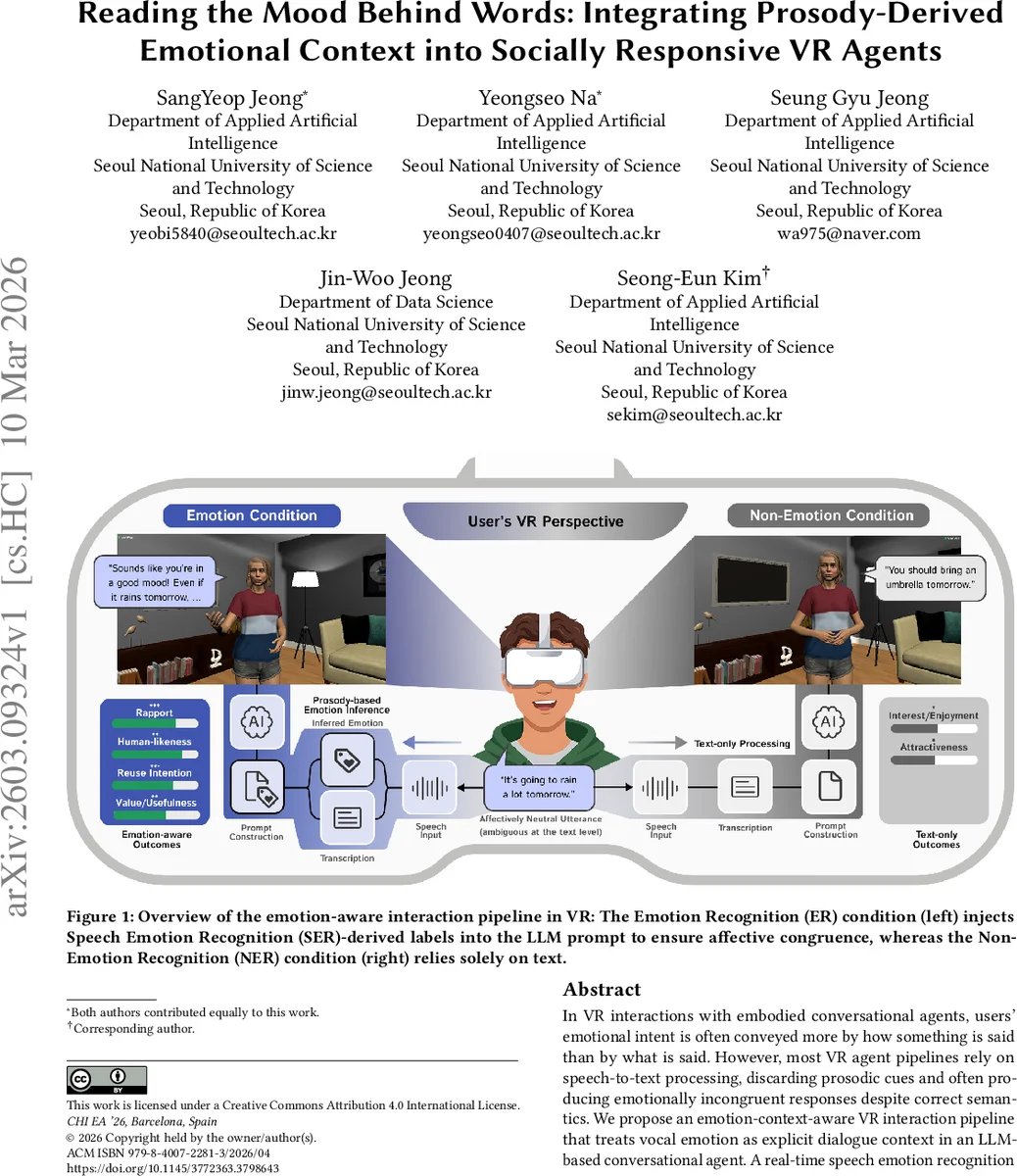

본 논문은 실시간 음성 감정 인식(SER)으로 추출한 감정 라벨을 대형 언어 모델(LLM)의 프롬프트에 삽입해, 감정‑컨텍스트를 대화 맥락으로 활용하는 VR 대화 에이전트 파이프라인을 제안한다. 30명의 참가자를 대상으로 한 within‑subjects 실험에서, 감정‑인식 에이전트는 텍스트‑전용 에이전트에 비해 사회적 존재감, 대화 품질, 몰입감 등에서 유의미하게 높은 점수를 받았으며 93.3%가 선호하였다.

상세 분석

이 연구는 기존 VR 대화 시스템이 텍스트 전처리 단계에서 음성의 프로소디 정보를 완전히 소실한다는 근본적인 한계를 지적하고, 감정을 ‘보조 메타데이터’가 아니라 ‘대화 컨텍스트’로 재정의한다는 점에서 혁신적이다. 음성 감정 인식은 HuBERT‑base 모델을 기반으로 하며, IEMOCAP 벤치마크에서 67.62% 정확도를 보였고 실험 참가자 음성에서는 72.0%의 전체 정확도를 달성했다. 특히 Happy(92.2%)와 Sad(95.4%)는 높은 인식률을 보였으나 Angry는 19.3%에 머물렀는데, 이는 모델이 영어 데이터에 사전학습된 점과 한국어 화자의 분노 표현이 음향적으로 차이가 크기 때문으로 해석된다.

감정 라벨은 “

댓글 및 학술 토론

Loading comments...

의견 남기기