포인트 클라우드를 외국어로 활용한 다중모달 대형 언어 모델

초록

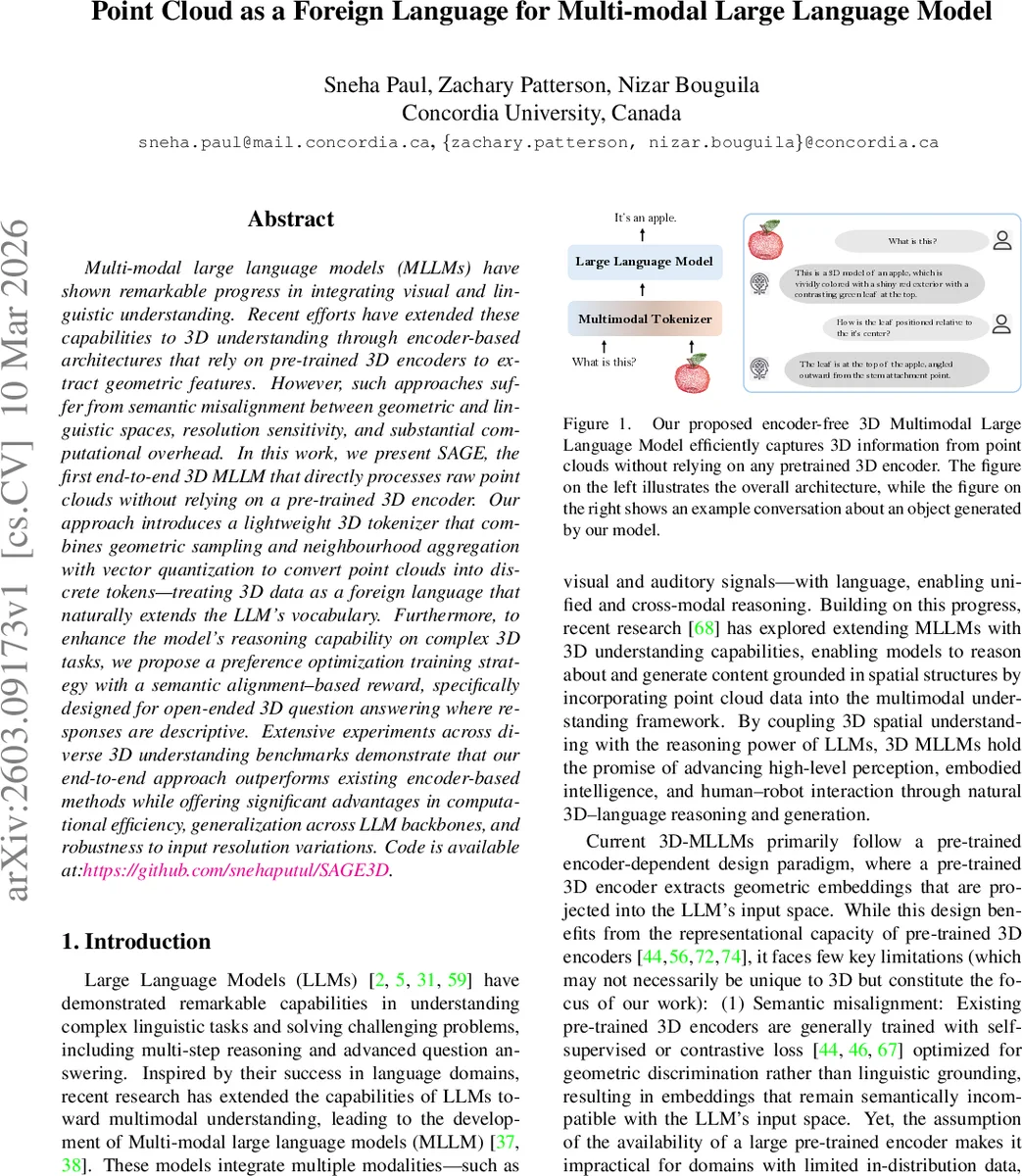

본 논문은 사전 학습된 3D 인코더 없이 원시 포인트 클라우드를 직접 처리하는 최초의 엔드‑투‑엔드 3D MLLM인 SAGE를 제안한다. 경량 3D 토크나이저가 FPS 기반 샘플링, KNN 군집화, 벡터 양자화를 결합해 점들을 LLM 어휘에 맞는 이산 토큰으로 변환한다. 또한, 서술형 3D 질문‑답변에 적합한 의미 정렬 보상을 이용한 Preference Optimization을 도입해 복합 추론 능력을 강화한다. 실험 결과, 기존 인코더 기반 모델을 능가하면서 연산 효율과 해상도 강인성을 확보한다.

상세 분석

SAGE는 기존 3D‑MLLM이 직면한 세 가지 핵심 문제—(1) 기하학적 특징과 언어 의미 사이의 정렬 불일치, (2) 고정된 포인트 수에 의존하는 해상도 민감성, (3) 대규모 3D 인코더가 초래하는 연산 비용—를 근본적으로 재설계한다. 핵심 모듈인 3D 토크나이저는 먼저 Farthest Point Sampling(FPS)으로 전체 포인트 클라우드에서 대표적인 중심점 집합 N_s 를 추출하고, 각 중심점에 대해 K‑Nearest‑Neighbour(KNN)로 지역 이웃을 구성한다. 이렇게 형성된 로컬 서브클라우드에 대해 좌표와 색상 등 원시 피처를 선형 변환 후 상대 위치 임베딩을 더하고, Max‑Pooling을 적용해 고정 차원의 지역 특징 Z 를 만든다.

다음 단계에서는 학습 가능한 투사 행렬 W 를 통해 Z 를 LLM의 임베딩 차원 d_llm 으로 매핑하고, 얻어진 연속 벡터 H 에 대해 벡터 양자화(VQ) 과정을 수행한다. VQ는 코드북 C={e_k} (크기 C) 를 학습하면서 H 를 가장 가까운 코드벡터 e_k 로 대체해 이산 토큰 시퀀스 H_q 를 만든다. 이때 VQ 손실 L_VQ는 코드북 업데이트와 커밋 손실을 동시에 최적화해 양자화 오류를 최소화한다. 결과적으로 포인트 클라우드가 “외국어”처럼 LLM의 기존 토크나이저와 동일한 토큰 시퀀스로 변환되어, 텍스트 토큰과 자연스럽게 혼합 입력(

댓글 및 학술 토론

Loading comments...

의견 남기기