RGB열 영상 융합과 분리를 통한 강인한 의미분할

초록

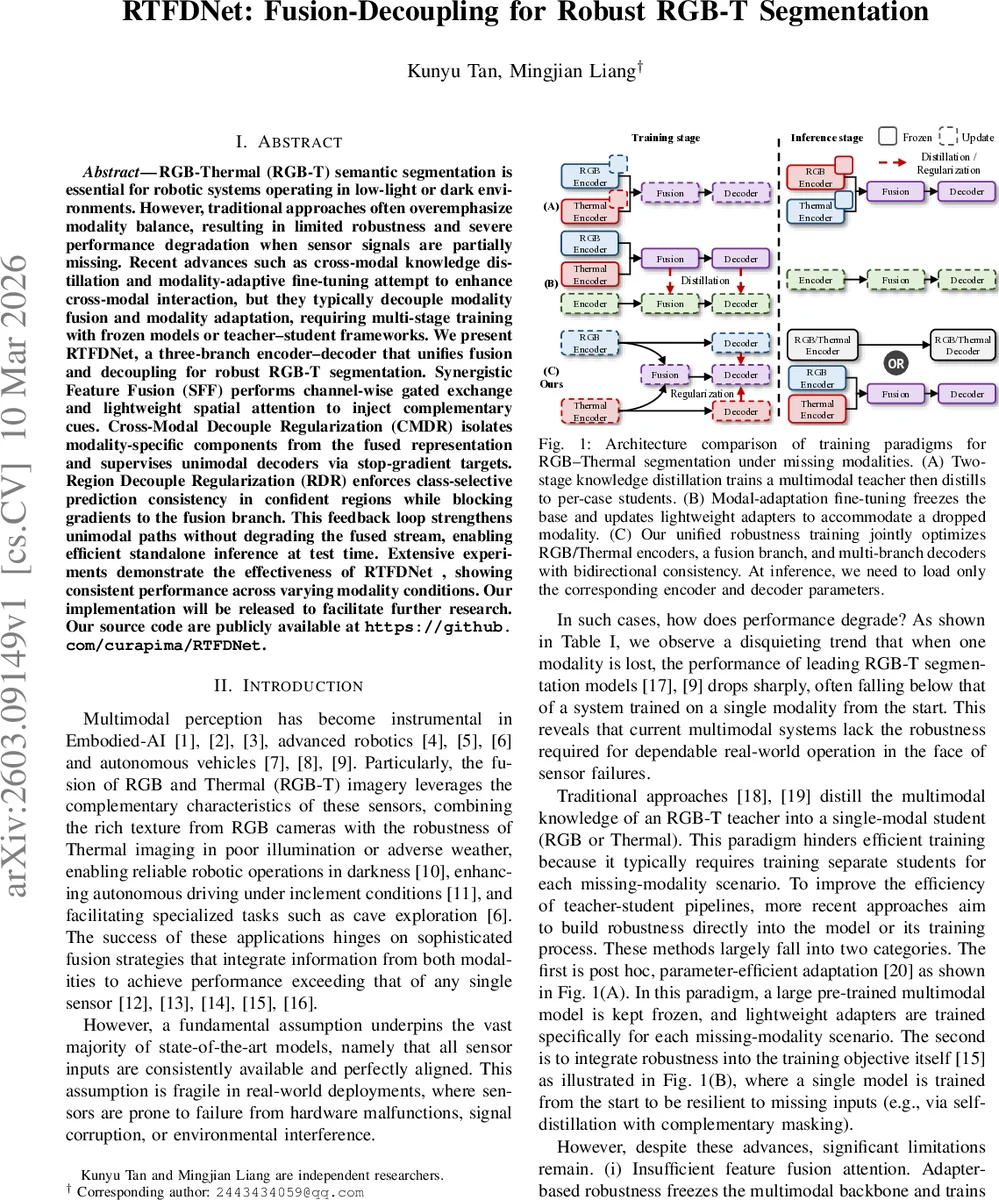

본 논문은 RGB와 열(Thermal) 영상을 동시에 활용하면서도, 어느 한 센서가 고장 나거나 신호가 손실될 경우에도 높은 분할 정확도를 유지할 수 있는 RTFDNet을 제안한다. 세 개의 인코더‑디코더 브랜치를 갖는 구조에 Synergistic Feature Fusion(SFF)으로 상호 보완 정보를 교환하고, Cross‑Modal Decouple Regularization(CMDR)과 Region Decouple Regularization(RDR)이라는 두 가지 정규화 기법으로 융합 특징을 분리·전달한다. 훈련 단계에서 통합된 피드백 루프를 형성해 단일 모달 경로를 강화하면서도 테스트 시에는 RGB 혹은 열 전용 브랜치만 단독으로 사용할 수 있다. 실험 결과, 다양한 모달리티 결손 상황에서도 기존 최첨단 모델보다 일관된 성능 향상을 보였다.

상세 분석

RTFDNet은 “융합‑분리(Fusion‑Decoupling)”라는 새로운 패러다임을 도입한다. 기본 설계는 RGB 인코더, 열 인코더, 그리고 두 인코더의 특징을 결합한 Fusion 브랜치로 구성된 3‑branch encoder‑decoder이다. 핵심 모듈인 Synergistic Feature Fusion(SFF)은 각 모달리티의 채널‑와이즈 attention 벡터(R, T)를 계산한 뒤, R·T가 부호가 다를 때(즉, 서로 다른 의미를 강조할 때) 시그모이드 게이트 1 − σ(R·T)를 이용해 상대 모달리티의 특징을 선택적으로 보강한다. 이렇게 강화된 f′rgb와 f′t를 다시 1×1 컨볼루션으로 결합해 fused feature f_fuse를 만든다. 이 과정은 채널‑레벨 교류와 가벼운 공간‑attention을 동시에 수행해 연산 비용을 최소화하면서도 풍부한 상호 보완 정보를 전달한다.

다음으로 Cross‑Modal Decouple Regularization(CMDR)은 fused feature와 각 모달리티의 채널‑attention(R, T) 사이의 부호 일치를 이용해 모달리티‑특이 성분을 추출한다. 구체적으로 σ(F·R)·f_fuse와 σ(F·T)·f_fuse를 각각 RGB, Thermal 전용 디코더의 목표 특징으로 만든 뒤, stop‑gradient 연산을 통해 역전파는 오직 Fusion 브랜치에서만 흐르게 한다. ℓ2 손실을 사용해 각 단일‑모달 디코더가 이 고품질 목표와 일치하도록 학습함으로써, Fusion 경로가 강력한 지식을 제공하면서도 단일‑모달 경로가 독립적으로 성능을 유지하도록 만든다.

Region Decouple Regularization(RDR)은 픽셀‑레벨에서의 정밀도를 높이기 위해 설계되었다. fused decoder의 softmax 출력을 one‑hot 마스크 M으로 변환하고, 이를 fused 예측에 곱해 confidence가 높은 영역만을 추출한다. 그런 뒤 stop‑gradient된 masked fused 예측을 RGB와 Thermal 디코더의 출력과 L1 손실로 정렬한다. 이때도 역전파는 Fusion 브랜치에 차단되므로, 각 모달리티는 자신만의 지역적 특징을 학습하면서도 fused 결과와 일관된 라벨을 유지한다.

전체 손실은 CrossEntropy와 CMDR, RDR을 가중치 λ, λ′, λ″ 로 결합한다. 훈련 과정에서 세 브랜치가 동시에 최적화되며, 특히 CMDR과 RDR이 제공하는 “역방향 피드백 루프”는 단일‑모달 디코더가 Fusion 브랜치에 의존하지 않고도 강인한 표현을 학습하게 만든다.

실험에서는 MFNet, FMB, PST900 등 세 개의 공개 RGB‑Thermal 데이터셋을 사용했으며, 모달리티 결손(완전 소실, 노이즈, 불안정) 상황을 시뮬레이션했다. 표 I에 나타난 바와 같이, 기존 모델(RTFNet, EAEFNet, CMXNet 등)은 RGB 혹은 열이 사라지면 mIoU가 20% 이상 급락하지만, RTFDNet은 최대 5% 이하의 감소에 그친다. 또한, 전체 모달리티가 모두 존재할 때도 SegFormer‑b2 기반의 베이스라인 대비 1~2% 정도의 절대적 향상을 기록한다. Ablation study에서는 SFF 없이 CMDR·RDR만 적용했을 때와, CMDR·RDR 없이 SFF만 적용했을 때의 성능 차이를 보여, 세 모듈이 상호 보완적으로 작용함을 입증한다.

한계점으로는 Fusion 브랜치가 여전히 가장 높은 연산량을 차지한다는 점과, 현재는 두 모달리티만을 대상으로 설계돼 있어 RGB‑Depth, RGB‑LiDAR 등 다중 모달리티 확장에 추가 연구가 필요하다는 점을 들 수 있다. 그러나 제안된 Fusion‑Decoupling 프레임워크는 모달리티 결손에 강인한 로봇 비전 시스템 구축에 실질적인 진전을 제공한다.

댓글 및 학술 토론

Loading comments...

의견 남기기