FreeTacMan: 인간 중심 로봇‑프리 비주·촉각 데이터 수집 시스템

초록

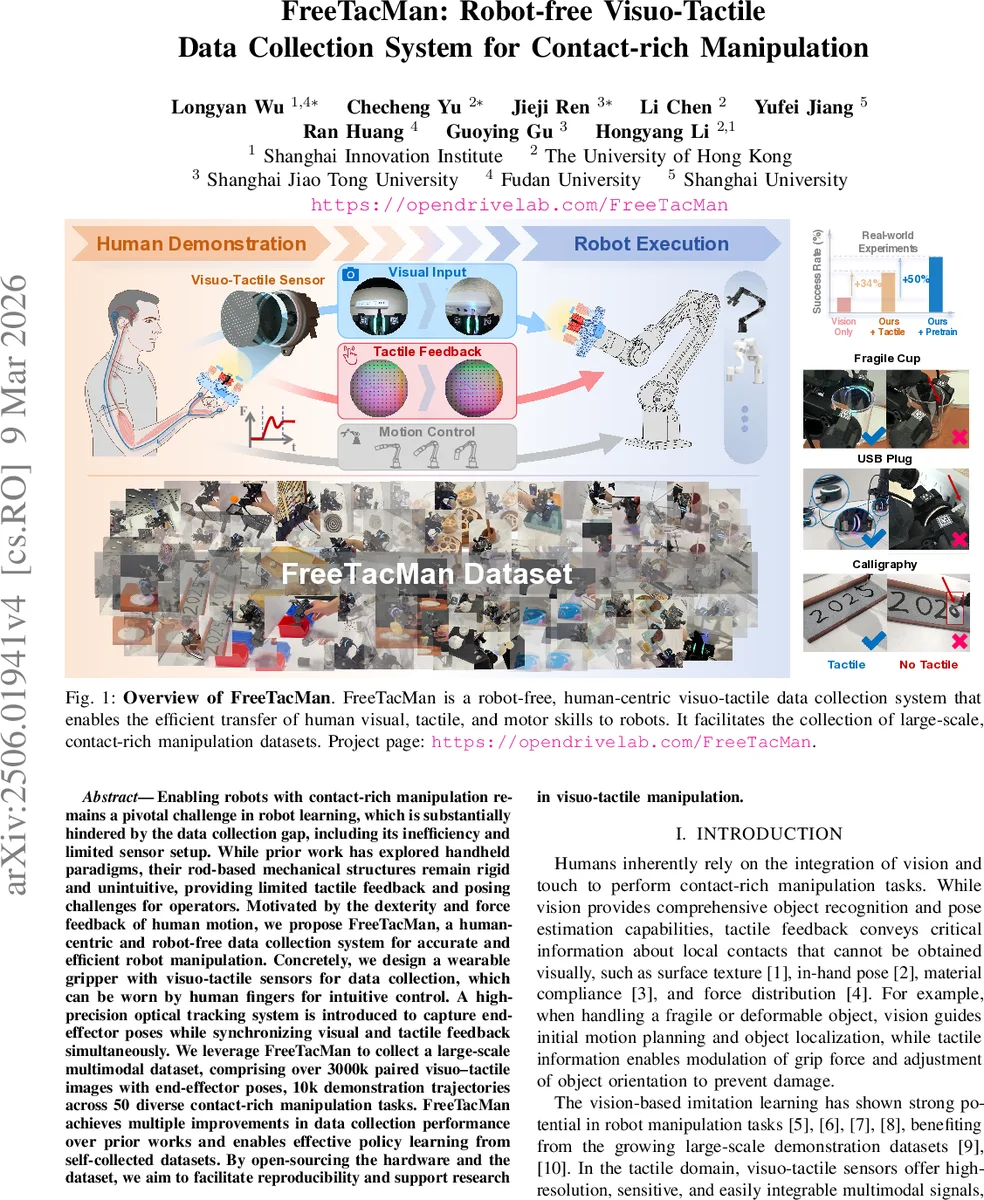

FreeTacMan은 손가락에 착용하는 그리퍼와 고정밀 광학 트래킹을 결합해, 실시간 비주·촉각 데이터를 동시에 수집한다. 3천만 장 이상의 이미지·포즈 쌍과 5천 개 이상의 시연 궤적을 50개의 접촉‑풍부 작업에 대해 제공하며, 기존 핸드헬드 방식보다 촉각 전달 경로를 1단계로 최소화해 데이터 품질과 수집 효율을 크게 향상시킨다.

상세 분석

FreeTacMan은 기존 로봇 기반 혹은 SLAM·IMU 기반 핸드헬드 데이터 수집 시스템이 안고 있던 “데이터 수집 격차”를 근본적으로 해소한다는 점에서 혁신적이다. 첫째, 착용형 그리퍼는 촉각 센서를 인간 손끝에 직접 부착함으로써 기계적 링크를 1개(손가락‑센서)로 축소한다. 이는 기존 4~5개의 링크가 존재하던 구조에 비해 전송 손실을 거의 없애고, 사용자가 실시간으로 미세한 접촉 변화를 느낄 수 있게 한다. 둘째, 고정밀 광학 모션 캡처(NOKOV) 시스템을 240 Hz, 서브밀리미터 정확도로 활용해 그리퍼의 6‑DoF 자세를 실시간으로 기록한다. IMU·SLAM 기반의 누적 오차와 달리 절대적인 위치 정보를 제공하므로, 촉각 데이터와 자세 데이터 간의 동기화 오류가 최소화된다. 셋째, 모듈식 설계는 센서·그리퍼·카메라를 각각 플러그‑인 형태로 교체 가능하게 하여, 동일한 하드웨어를 다양한 로봇 팔(예: Piper, Franka)이나 연구 환경에 재사용할 수 있다. 이는 데이터 수집 비용을 크게 낮추고, 재현성을 확보한다는 장점을 제공한다.

데이터 측면에서 저자들은 3,000k(≈3천만) 개의 비주·촉각 이미지 쌍과 10k 이상의 시연 궤적을 50개의 작업에 걸쳐 수집하였다. 각 프레임은 손목에 장착된 RGB 카메라 영상, 두 개의 촉각 이미지, 그리퍼 폭, 그리고 6‑DoF 자세 정보를 포함한다. 이러한 멀티모달 시퀀스는 30 Hz로 동기화되어, 시계열 기반 정책 학습에 바로 활용 가능하도록 설계되었다.

학습 파이프라인은 두 단계로 구성된다. 첫 단계에서는 CLIP‑style 대조 학습을 통해 촉각 인코더를 사전 학습한다. 시각 인코더는 사전 학습된 ResNet을 고정하고, 촉각 인코더만 미세조정한다. 여기서 기본 양성(현재 시각 특징)과 보조 양성(다음 시점 시각 특징)을 모두 활용해 시간적 연속성을 보존한다. 두 번째 단계에서는 사전 학습된 촉각 인코더와 시각 인코더의 임베딩을 결합해 Action Chunking Transformer( ACT )에 입력하고, 7‑DoF 관절 위치를 예측한다. 실험 결과, 이 비주·촉각 정책은 순수 시각 기반 정책 대비 성공률이 평균 50 % 이상 향상되었으며, 특히 섬세한 물체(깨지기 쉬운 컵, USB 플러그 삽입 등)에서 큰 차이를 보였다.

한편 한계점도 존재한다. 고정밀 모션 캡처 시스템은 실험실 환경에 국한될 가능성이 높으며, 대규모 현장 적용 시 비용과 설치 복잡도가 문제될 수 있다. 또한 착용형 그리퍼는 손 크기에 따라 맞춤형 스트랩이 필요하고, 장시간 사용 시 피로도가 증가할 수 있다. 촉각 센서는 현재 McTac 기반으로, 압력 범위와 내구성 측면에서 산업용 로봇에 바로 적용하기엔 추가 검증이 필요하다. 그럼에도 불구하고, FreeTacMan은 데이터 품질·양·다양성을 동시에 만족시키는 최초의 인간‑중심 비주·촉각 수집 플랫폼으로, 향후 로봇 학습 데이터 파이프라인의 표준이 될 잠재력을 지닌다.

댓글 및 학술 토론

Loading comments...

의견 남기기