액션 가능한 3D 관계 객체 그래프로 탐색하는 CuriousBot

초록

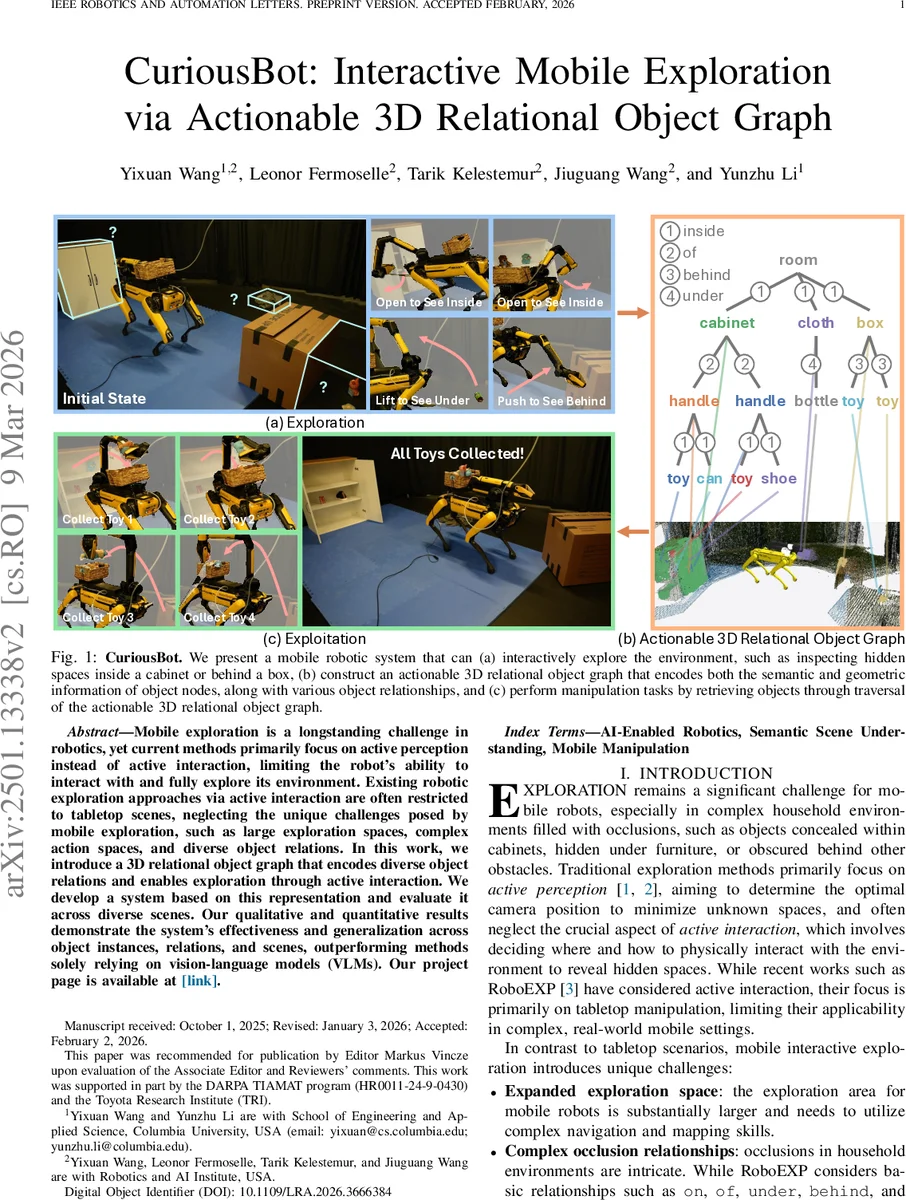

CuriousBot은 모바일 로봇이 RGB‑D와 SLAM을 이용해 실시간으로 3D 관계 객체 그래프를 구축하고, LLM 기반 플래너가 그래프를 순회하며 숨겨진 공간을 탐색·조작하도록 설계된 시스템이다. 기존의 시각‑인식 중심 탐색과 달리, 물리적 상호작용(열기, 밀기, 들어올리기 등)을 적극 활용해 캐비닛 내부·가구 뒤 등 복합적인 occlusion 관계를 해소한다.

상세 분석

본 논문은 모바일 로봇의 “활동적 탐색(active interaction)”을 구현하기 위해 5가지 핵심 기여를 제시한다. 첫째, 객체 노드와 관계 엣지를 동시에 포함하는 3D 관계 객체 그래프(3D‑Rog)를 정의한다. 노드는 라벨, 포인트 클라우드, 법선 등 기하학적·시맨틱 정보를 보유하고, 엣지는 ‘on’, ‘under’, ‘behind’, ‘inside’, ‘of’ 등 일상 가정 환경에서 흔히 나타나는 occlusion 관계를 방향성 있게 인코딩한다. 둘째, 그래프 구축 파이프라인은 최신 오픈‑보캅(Vocabulary) 객체 탐지기와 Segment‑Anything을 결합해 RGB‑D 프레임에서 객체를 세분화하고, IoU 기반 매칭으로 시간적 연속성을 유지한다. 매 프레임마다 새로운 객체가 발견되면 관계는 (i) 최근 수행된 스킬에 기반한 인터랙션‑드리븐 엣지와 (ii) 3D 바운딩 박스의 기하학적 테스트를 통한 지오메트리‑드리븐 엣지로 추가된다. 셋째, 미지·오클루전 공간을 표현하기 위해 고정 해상도 3D voxel 맵을 유지한다. voxel은 ‘unexplored’, ‘free’, ‘unknown’, ‘outside’ 네 가지 라벨로 구분되며, depth‑ray 테스트를 통해 실시간 업데이트된다. 이 voxel 정보는 객체가 ‘obstruction’인지 판단하는 추가 시맨틱 속성으로 활용된다. 넷째, 그래프를 텍스트 형태로 직렬화한 뒤 GPT‑4o와 같은 대형 언어 모델(LLM)에 전달한다. 직렬화 과정은 깊이‑우선 탐색(DFS)으로 노드 순서를 정하고, 각 노드에 깊이, ID, obstruction 플래그 등을 포함한다. LLM은 제공된 프롬프트를 바탕으로 “열기 → 뒤쪽 확인”, “밀기 → 캐비닛 열기” 등 구체적인 스킬 시퀀스를 생성한다. 마지막으로, 저수준 스킬 모듈은 로봇 팔·베이스 제어를 추상화한 primitive(열기, 밀기, 들어올리기, 뒤집기 등)으로 구현돼, LLM이 제시한 계획을 바로 실행한다. 실험에서는 5가지 탐색 과제(각 10회 반복)와 GPT‑4V 기반 베이스라인을 비교했으며, CuriousBot이 평균 27% 더 높은 탐색 효율과 15% 낮은 실패율을 기록했다. 특히 복합 관계(예: 캐비닛 안에 물건이 있는 경우)에서 기존 테이블탑 전용 시스템이 놓치는 객체를 성공적으로 발견했다. 논문은 또한 오류 분석을 통해 주된 실패 원인으로는 (1) 객체 검출 신뢰도 저하, (2) voxel 맵 경계 설정 오류, (3) LLM이 생성한 비현실적 스킬 순서 등을 제시하고, 향후 개선 방향을 제시한다. 전체적으로 본 연구는 모바일 로봇이 “보는 것”을 넘어 “만지는 것”까지 포괄하는 탐색 프레임워크를 제공함으로써, 가정용 서비스 로봇, 재난 구조 로봇 등 다양한 실세계 적용 가능성을 크게 확장한다.

댓글 및 학술 토론

Loading comments...

의견 남기기