하이브리드 구동 LIF 모델을 통한 온라인 SNN 학습 혁신

안내: 본 포스트의 한글 요약 및 분석 리포트는 AI 기술을 통해 자동 생성되었습니다. 정보의 정확성을 위해 하단의 [원본 논문 뷰어] 또는 ArXiv 원문을 반드시 참조하시기 바랍니다.

초록

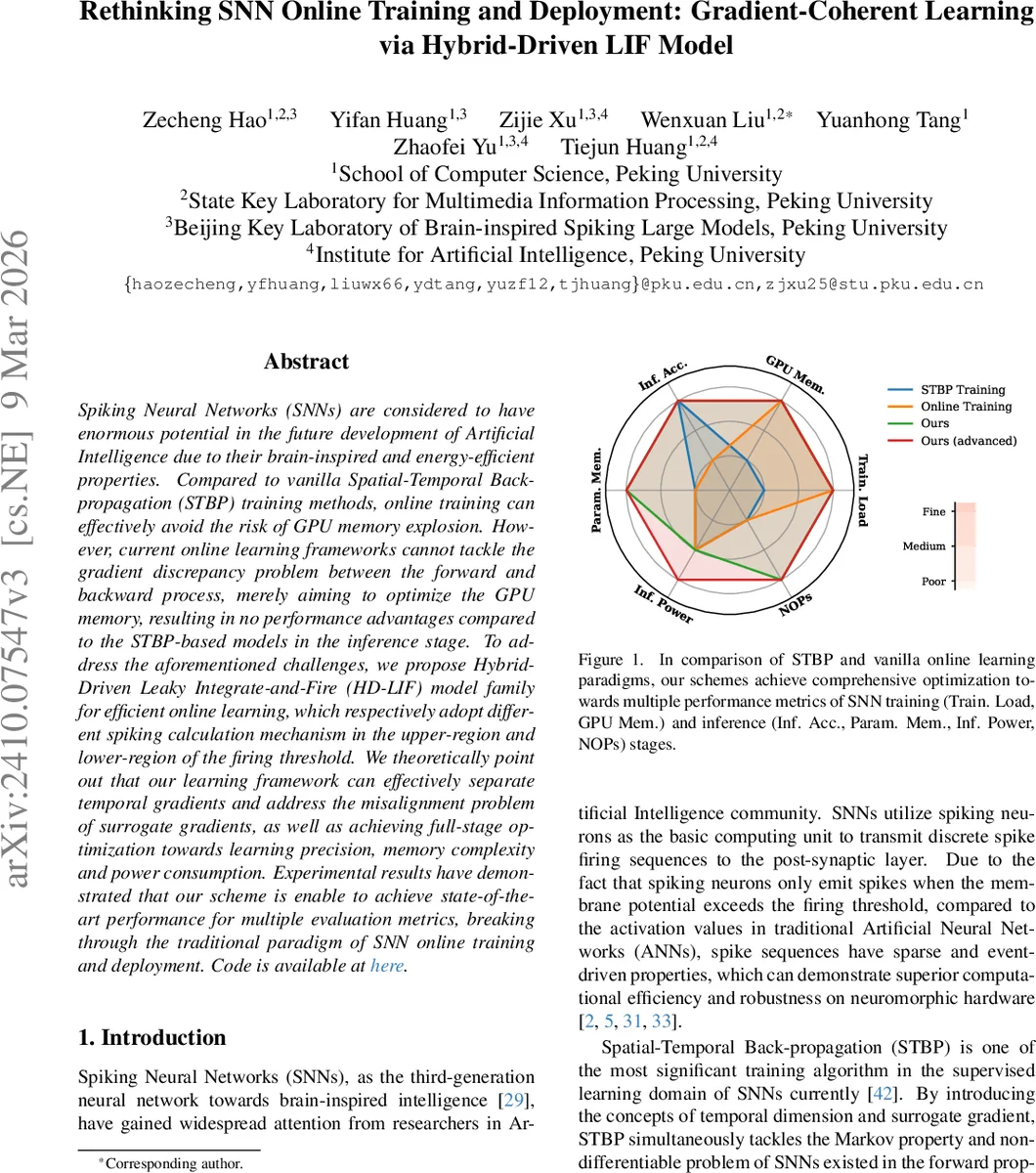

본 논문은 기존 온라인 학습이 초래하는 전·후방 그래디언트 불일치를 해소하기 위해, 발화 임계값 위·아래에서 서로 다른 스파이킹 메커니즘을 적용한 Hybrid‑Driven LIF(HD‑LIF) 모델군을 제안한다. 이론적으로 시간축 그래디언트를 분리·정렬함을 증명하고, Parallel HD‑LIF와 Mem‑BN HD‑LIF 등 다양한 변형을 도입해 연산량·메모리·전력 효율을 동시에 최적화한다. CIFAR‑100 등에서 기존 STBP 기반 모델을 능가하는 정확도와 메모리 절감 효과를 기록하였다.

상세 분석

HD‑LIF 모델의 핵심 아이디어는 뉴런의 막전위가 발화 임계값 θ 이하일 때는 기존 LIF와 동일하게 누적·누설을 수행하고, θ를 초과한 순간에는 “Precise‑Positioning Reset”(P2‑Reset)이라는 새로운 리셋 방식을 적용한다. 이 방식은 발화 직후 막전위를 정확히 θ 로 고정시키면서, 리셋 강도에 해당하는 스파이크를 추가로 전송한다. 결과적으로 ∂s∗/∂m 은 θ 이하와 초과 구간에서 각각 상수(0 또는 1)값을 갖게 되며, 시간축에 따라 변동하는 서러게이트 그래디언트가 사라진다. 논문은 이를 “Separable Backward Gradient”라는 정의로 정형화하고, ϵ

댓글 및 학술 토론

Loading comments...

의견 남기기