스트리밍 대형 언어 모델의 동적 상호작용 탐구

초록

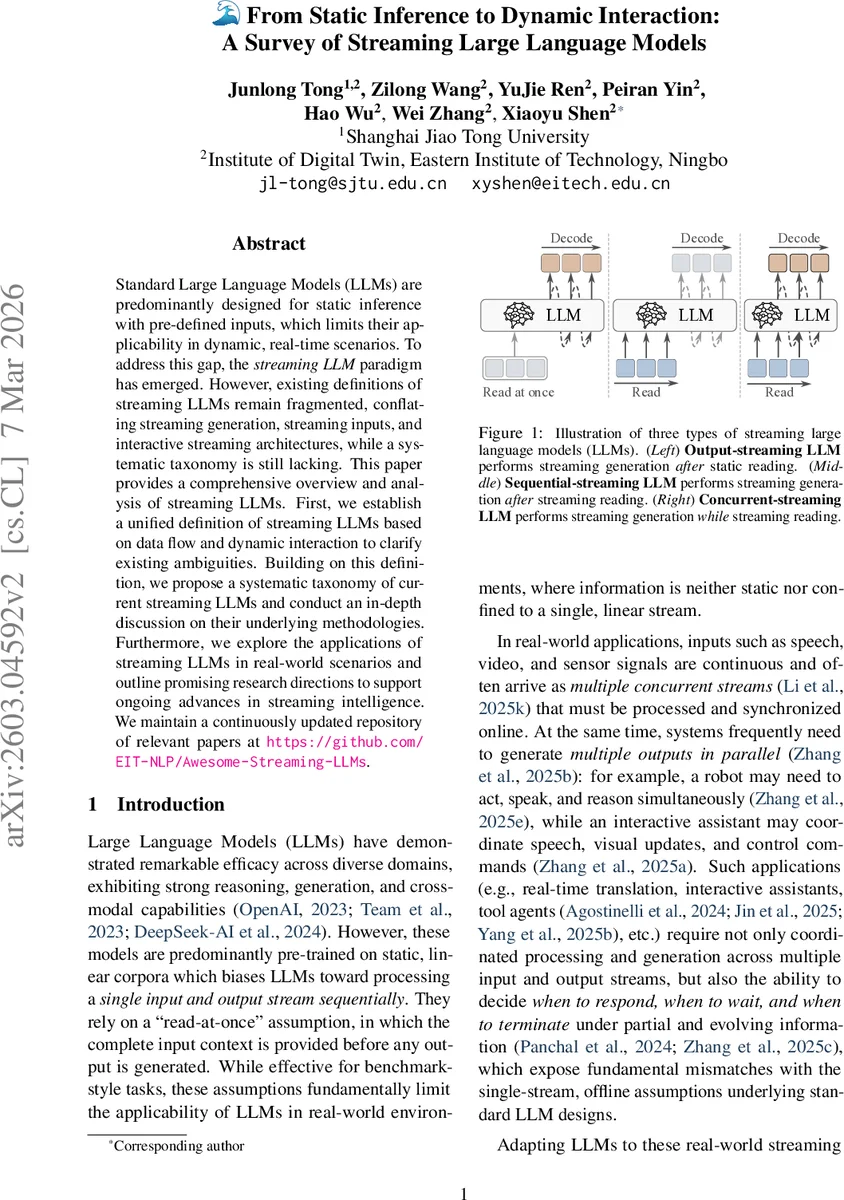

본 논문은 정적 입력을 전제로 하는 기존 대형 언어 모델(LLM)의 한계를 극복하고, 실시간 스트리밍 환경에서의 입력·출력 동시 처리를 목표로 하는 “스트리밍 LLM” 개념을 정의한다. 입력·출력 흐름과 상호작용 동시성을 기준으로 출력‑스트리밍, 순차‑스트리밍, 동시‑스트리밍 세 가지 유형을 제시하고, 각 유형별 핵심 기술·과제(생성 메커니즘, 증분 인코딩, 메모리 관리, 아키텍처 적응, 인터랙션 정책)를 체계적으로 정리한다. 또한 실제 응용 사례와 향후 연구 방향을 제시하며, 최신 논문을 지속적으로 업데이트하는 레포지터리를 제공한다.

상세 분석

논문은 먼저 LLM이 “읽고 한 번에 전체 입력을 제공받은 뒤 순차적으로 토큰을 생성한다”는 전통적인 배치 처리 방식을 비판하고, 실시간 음성·영상·센서 데이터와 같이 지속적으로 도착하는 멀티스트림을 처리하려면 입력과 출력이 동시에 흐르는 모델이 필요함을 강조한다. 이를 위해 저자들은 데이터 흐름과 동적 상호작용을 기준으로 스트리밍 LLM을 정의하고, ϕ(t)라는 결정 함수를 도입해 현재 시점 t에서 모델이 볼 수 있는 입력 프리픽스를 명시한다. 이 정의를 토대로 세 가지 서브타입을 수학적으로 구분한다.

-

출력‑스트리밍(Output‑Streaming): ϕ(t)=M(전체 입력 길이)로 고정되어 입력을 완전하게 사전 처리한 뒤, 토큰을 점진적으로 출력한다. 주요 과제는 저지연 스트리밍 디코딩과 토큰·블록 단위의 효율적 생성 메커니즘이다. 논문은 토큰‑단위 자동회귀, 블록‑단위 반자동회귀, 그리고 다중 스케일·디퓨전 기반 정제 방식 등 네 가지 생성 패러다임을 정리하고, Speculative Decoding, AdaInfer 등 토큰 경로 가속 및 레이어 스킵 기법을 통해 디코딩 지연을 감소시키는 최신 연구들을 소개한다.

-

순차‑스트리밍(Sequential‑Streaming): 입력이 스트리밍 형태로 도착하지만, 출력은 전체 입력이 확보된 뒤에 시작한다(ϕ(t)=M). 여기서는 입력을 증분적으로 인코딩하고, KV‑Cache 관리·메모리 압축이 핵심 이슈가 된다. 논문은 원자 토큰 인코딩, 고정 구간 파티셔닝, 의미 기반 파티셔닝 등 다양한 인코딩 전략을 제시하고, VideoScan, Flash‑vstream 등 장기 컨텍스트 유지와 KV‑Cache 효율화를 위한 최신 방법들을 비교한다.

-

동시‑스트리밍(Concurrent‑Streaming): 가장 복잡한 형태로, ϕ(t) 가 시점마다 증가하면서 입력과 출력을 동시에 처리한다. 이 경우 아키텍처 적응(재인코딩, 인터리브, 그룹 스트리밍)과 인터랙션 정책(규칙 기반, 적응 임계값, SFT‑기반, RL‑기반) 두 축이 추가된다. 저자들은 Simul‑LLM, Qwen3‑omni, SyncLLM 등 입력·출력 동시성을 지원하는 모델 구조와, STACL, DiG‑SST, MMDuet2 등 언제 응답하고 언제 대기할지를 결정하는 정책 학습 방법을 상세히 정리한다.

전체적으로 논문은 세 단계가 서로 누적적인 기술 난이도를 갖는 로드맵을 제시한다. 출력‑스트리밍은 저지연 생성에 집중하고, 순차‑스트리밍은 증분 인코딩·컨텍스트 관리, 동시‑스트리밍은 전체 시스템 설계와 정책 학습까지 포괄한다. 이러한 체계적 분류는 기존 연구들이 “스트리밍 LLM”이라는 포괄적 용어 아래 섞여 있던 문제를 해소하고, 각 파라다임별 성능·효율·응용 가능성을 명확히 비교할 수 있게 한다. 또한, 실시간 번역, 인터랙티브 어시스턴트, 로봇 제어 등 멀티모달·멀티스트림 시나리오에 대한 적용 가능성을 제시함으로써, 앞으로의 연구 방향을 구체적으로 제시한다.

댓글 및 학술 토론

Loading comments...

의견 남기기