효과 메이커: 맞춤형 비주얼 이펙트 생성의 새로운 패러다임

초록

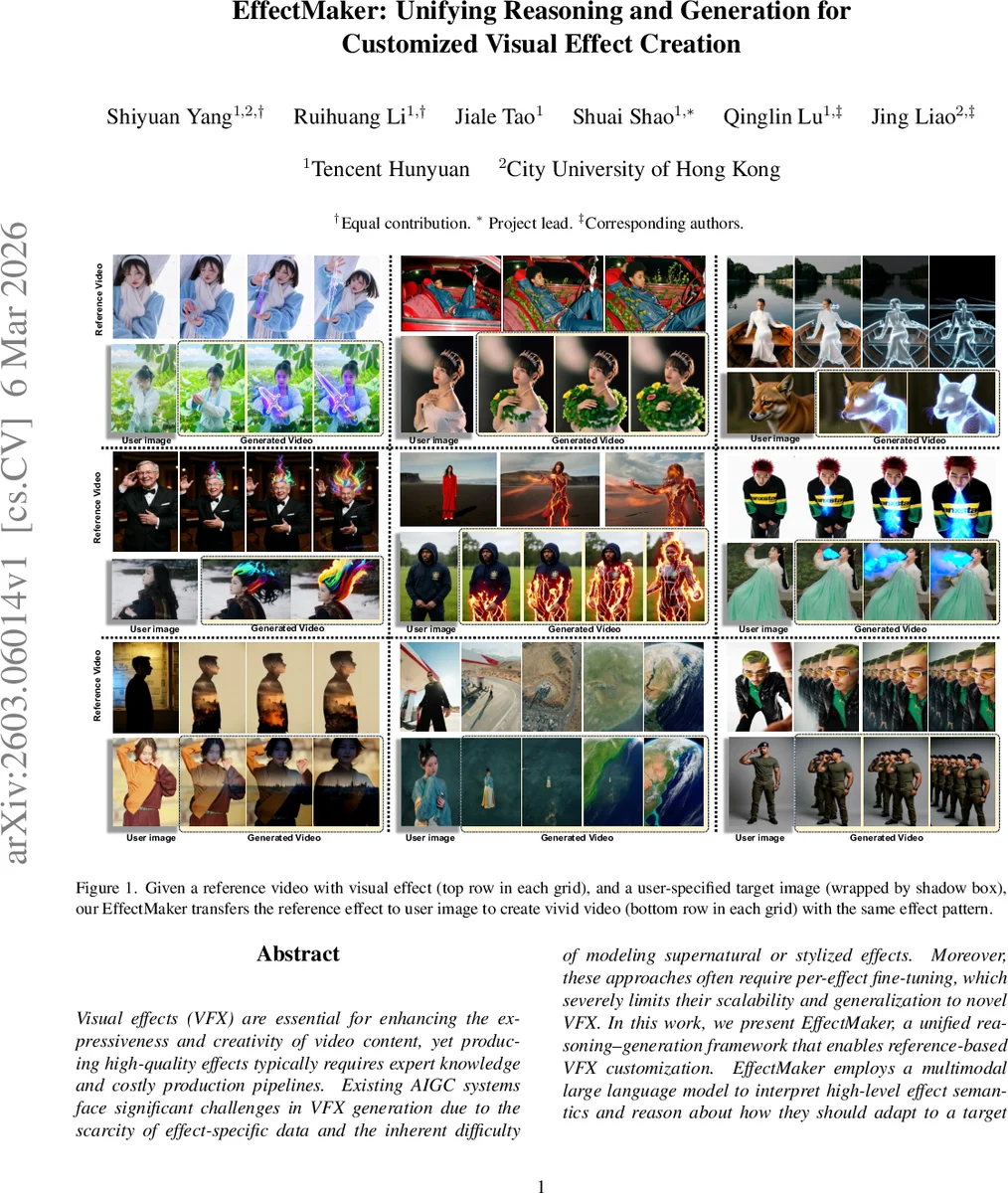

EffectMaker는 멀티모달 대형 언어 모델과 디퓨전 트랜스포머를 결합해, 레퍼런스 비디오에서 시각 효과를 이해·추론하고 이를 사용자 제공 이미지에 맞춰 고품질 동영상으로 변환한다. 별도 LoRA 파인튜닝 없이도 3천 개 이상의 효과 카테고리를 포괄하는 대규모 합성 데이터셋 EffectData(130k 영상)와 함께 높은 효과 일관성과 시각적 품질을 달성한다.

상세 분석

본 논문은 VFX 생성이라는 특수 도메인에 대한 두 가지 핵심 난관—데이터 부족과 효과의 초현실적·스타일리시한 특성—을 동시에 해결하고자 한다. 첫 번째로, 멀티모달 대형 언어 모델(MLLM, Qwen3‑VL‑8B 기반)을 활용해 레퍼런스 비디오의 고수준 의미를 추출하고, “어떤 효과가 존재하며, 이를 타깃 이미지에 어떻게 적용할 것인가”를 텍스트 형태로 추론한다. 여기서 모델은 이해 피처와 추론 피처를 별도로 수집한다. 이해 피처는 마지막 레이어의 은닉 상태에서 얻어지는 다중모달 표현이며, 추론 피처는 자동 회귀 방식으로 생성된 텍스트 토큰 시퀀스의 임베딩이다. 두 피처는 서로 다른 의미적 정보를 담고 있어, 효과 전이 시 세밀한 제어가 가능하도록 설계되었다.

두 번째로, 생성 측면에서는 Diffusion Transformer(DiT, Wan2.2‑TI2V‑5B)를 채택하고, 인‑컨텍스트 학습을 통해 레퍼런스 비디오의 저차원 라티스 표현을 직접 타깃 라티스와 결합한다. 구체적으로, 레퍼런스와 타깃 라티스를 시퀀스 차원에서 연결하고, 각각에 대해 별도의 Query‑Key‑Value 프로젝션을 적용한 이중 스트림 셀프‑어텐션을 도입한다. 이는 두 비디오 간의 정보 흐름을 보존하면서도 서로 간섭을 최소화한다. 또한, 타깃에 대한 RoPE(3D Rotary Positional Embedding)를 편향시켜 시간 축에서 위치 인코딩을 구분함으로써, 레퍼런스와 타깃의 시공간 정보를 명확히 구분한다.

시멘틱‑비주얼 듀얼‑패스 가이던스는 두 모듈을 교차 어텐션을 통해 결합한다. 텍스트 기반 시멘틱 조건은 기존 DiT의 텍스트 인코더와 별도 어텐션 브랜치를 두어, 이해 피처와 추론 피처를 각각 독립적으로 처리한다. 시각적 조건은 레퍼런스 라티스 자체를 키‑밸류로 사용해, 세밀한 텍스처·모션 정보를 직접 전달한다. 이러한 설계는 “무엇을 만들 것인가”(시멘틱)와 “어떻게 만들 것인가”(비주얼) 사이의 격차를 메우며, 기존 LoRA 기반 방법이 겪는 스케일·일반화 문제를 근본적으로 회피한다.

데이터 측면에서는 3천 개 효과 카테고리와 130k 영상으로 구성된 EffectData를 자체 구축하였다. 기존 VFX 데이터셋이 수십~수백 개 카테고리에 머물렀던 것과 달리, 본 데이터는 효과 라벨, 캡션, 편집 지시문을 모두 제공한다. 이는 MLLM이 효과를 정확히 이해하고, DiT가 세밀한 비주얼 디테일을 학습하는 데 필수적인 풍부한 어노테이션을 제공한다.

실험 결과, EffectMaker는 텍스트‑투‑비디오 기반 베이스라인 및 LoRA‑Mixture 모델 대비 FID, CLIP‑Score, 사용자 설문에서 일관성·품질 모두 우수함을 보였다. 특히, 레퍼런스와 타깃 간 형태·배경 차이가 클 때도 효과 패턴을 정확히 복제하는 능력이 돋보인다. 한계점으로는 현재 2D 이미지 → 3D 동영상 전이만 지원하며, 복합 효과(다중 레이어·다중 오브젝트)에서의 세밀한 제어는 추가 연구가 필요하다.

댓글 및 학술 토론

Loading comments...

의견 남기기