오스모시스 디스틸레이션: 최소 샘플로 모델 탈취

초록

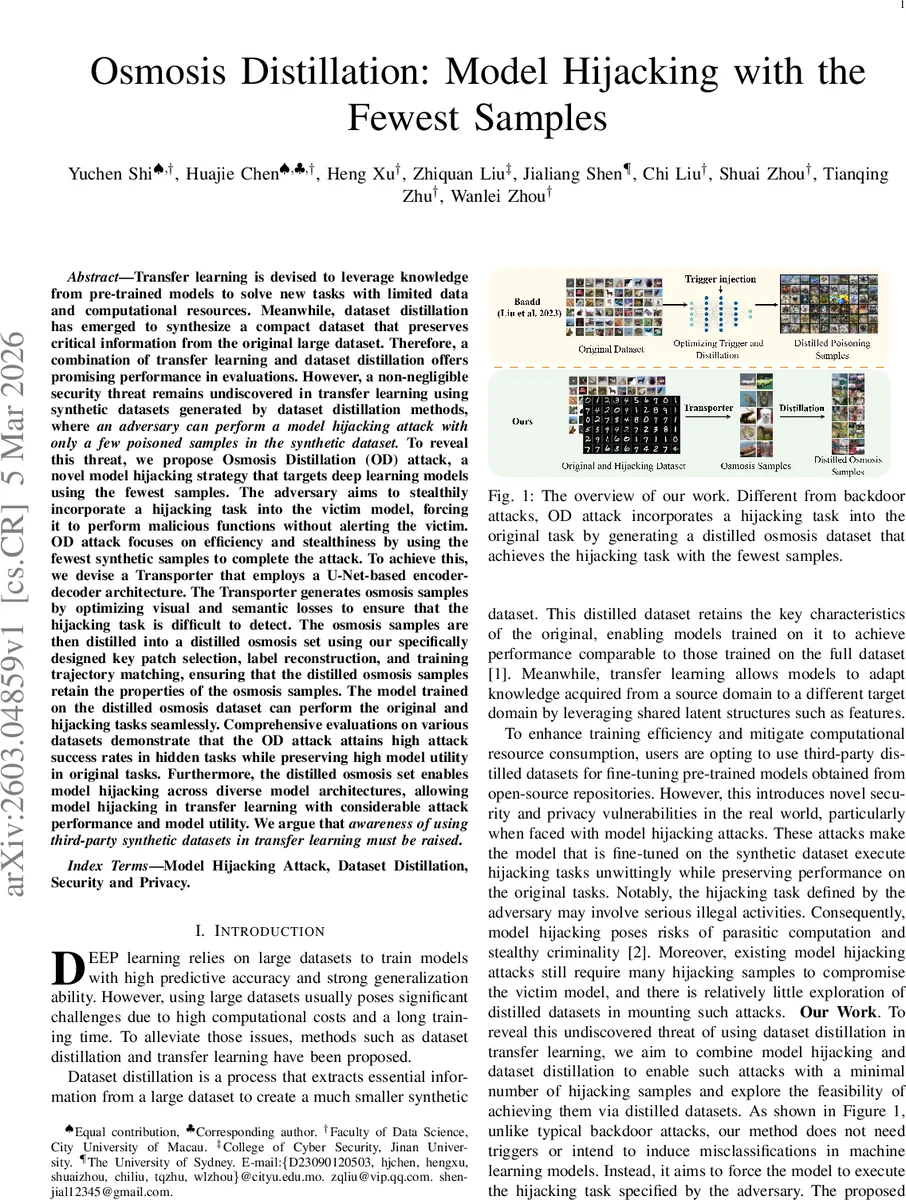

본 논문은 데이터셋 디스틸레이션으로 만든 소형 합성 데이터셋을 이용해 전이 학습 과정에서 모델을 탈취하는 새로운 공격인 “오스모시스 디스틸레이션(OD) 공격”을 제안한다. 공격자는 시각적으로는 원본 데이터와 거의 구분되지 않으면서, 의미적으로는 탈취하고자 하는 숨은 작업을 내포한 오스모시스 샘플을 생성한다. 이후 핵심 패치 선택·라벨 재구성·학습 궤적 매칭을 통해 극소수(클래스당 50개)만 남긴 distilled osmosis dataset을 만들고, 이를 이용해 fine‑tuning된 모델이 원본 작업과 숨은 작업을 모두 높은 정확도로 수행하도록 만든다. 실험 결과, 다양한 데이터셋·모델 아키텍처에서 높은 공격 성공률과 원본 성능 보존을 확인했으며, 합성 데이터셋 사용 시 보안 위험을 경고한다.

상세 분석

오스모시스 디스틸레이션(OD) 공격은 기존 모델 하이재킹 연구와 데이터셋 디스틸레이션 기술을 결합한 점에서 혁신적이다. 먼저, 공격자는 U‑Net 기반의 두 인코더‑디코더 구조인 “Transporter”를 설계한다. 하나의 인코더는 원본 데이터(xₒ)를, 다른 인코더는 탈취 목표 데이터(xₕ)를 처리하고, 두 특징 맵을 결합해 디코더가 osmosis 샘플(x_c)을 생성한다. 이때 시각 손실(L_visual)과 의미 손실(L_semantic)을 각각 L1 거리로 정의하고, λ_v, λ_s 가중치를 통해 시각적 유사성과 의미적 일치를 조절한다. 시각 손실은 원본 이미지와 거의 동일한 픽셀 레벨 차이를 최소화해 인간 눈에 띄지 않게 하고, 의미 손실은 사전 학습된 피처 추출기(F)를 이용해 x_c와 xₕ의 고차원 특징을 일치시켜 숨은 작업을 모델에 학습시킨다.

생성된 osmosis 샘플은 여전히 대량이므로, 논문은 “Distillation” 단계에서 핵심 패치(key patch)를 선택한다. 각 샘플을 동일 크기 패치로 분할하고, 현실성 점수 S = –ℓ(…) 로 평가해 가장 높은 점수를 가진 패치를 선택한다. 선택된 패치를 기반으로 이미지 재구성을 수행하고, 라벨은 소프트 라벨 방식과 학습 궤적 매칭(trajectory matching) 기법을 결합해 재구성한다. 이 과정은 원본 데이터와의 손실을 최소화하면서도 탈취 작업에 필요한 정보를 보존한다.

실험에서는 CIFAR‑10, SVHN, Tiny‑ImageNet 등 여러 공개 데이터셋과 ResNet, VGG, ConvNet 등 다양한 아키텍처에 대해 OD 공격을 수행했다. 클래스당 50개의 distilled osmosis 샘플만 사용했음에도 원본 작업 정확도는 1~2% 이하로 감소하지 않았으며, 숨은 작업(예: 새로운 라벨 매핑)에서는 85% 이상 성공률을 기록했다. 또한, 공격 데이터가 다른 모델에 전이될 때도 높은 성공률을 유지해 “Transferability”를 입증했다.

강점으로는 (1) 샘플 수 최소화로 비용·시간 효율성 확보, (2) 시각적·의미적 손실을 동시에 최적화해 스텔스성 강화, (3) 다양한 모델·학습 환경에 적용 가능한 범용성이다. 반면, 한계점은 (가) 사전 학습된 피처 추출기의 선택에 따라 의미 손실이 달라질 수 있어 공격 성공률이 변동될 가능성, (나) 현실성 점수 계산 및 패치 선택 과정이 추가 연산을 요구한다는 점이다. 또한, 방어 측면에서 데이터셋 검증·특징 분포 모니터링, 라벨 스무딩 등의 기존 백도어 방어 기법이 부분적으로 효과를 보일 수 있으나, OD 공격은 트리거가 없고 라벨 자체가 변형되지 않아 기존 방어를 회피한다는 점을 강조한다.

전반적으로 OD 공격은 데이터셋 디스틸레이션이 보편화되는 현재 AI 생태계에서 새로운 위협 벡터를 제시한다. 연구자는 합성 데이터셋 사용 시 출처 검증과 디스틸레이션 과정의 투명성을 강화할 것을 권고한다.

댓글 및 학술 토론

Loading comments...

의견 남기기