대규모 셀프슈퍼바이즈드 음성 모델의 화자 특성 인코딩 메커니즘 분석

초록

본 연구는 11가지 최신 음성 SSL 모델을 대상으로 화자 고유 속성(성별, 피치, 템포, 에너지, 감정)을 층별로 프로빙하여, 초기 층은 기본 음향 정보를, 중간 층은 추상적 화자 특성을, 최종 층은 언어 내용에 집중한다는 기존 가설을 재검증한다. 특히 대형 모델은 깊은 층에서도 화자 정체성을 유지한다는 새로운 현상을 발견했으며, 중간 층이 동적 프로소디 정보를 전문 스피커 임베딩보다 잘 포착함을 보여준다.

상세 분석

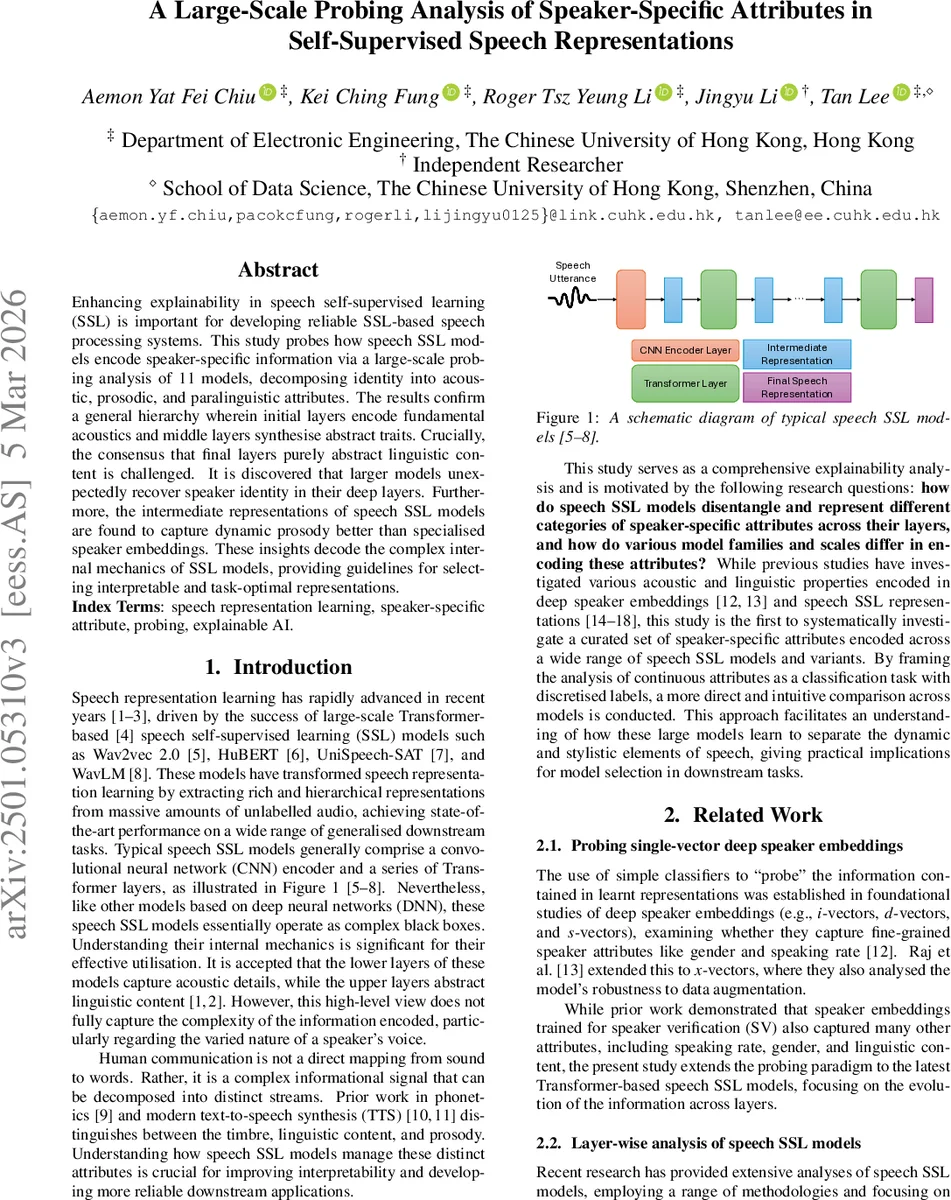

본 논문은 셀프슈퍼바이즈드 음성 표현 학습(SSL)의 내부 메커니즘을 해석하기 위해 ‘프로빙’이라는 간단한 분류기 기반 방법을 적용하였다. 11개의 모델(Wav2vec 2.0, HuBERT, UniSpeech‑SAT, WavLM)과 그 변형(Base, Base‑Plus, Large, XLarge)을 선정하고, 각 모델의 CNN 인코더와 12~48개의 Transformer 층에서 추출한 프레임‑averaged 벡터를 입력으로 사용하였다. probing 네트워크는 은닉 유닛 500개의 단일 은닉층 MLP이며, 교차 엔트로피 손실과 Adam 옵티마이저(learning rate 0.001)로 학습하였다.

데이터는 TextrolSpeech(330 시간, 1,327명 화자)에서 성별·감정·피치·템포·에너지 라벨을 확보했으며, 피치·템포·에너지는 전체 분포를 기준으로 High/Normal/Low로 이산화하였다. 각 속성별 정확도를 층별로 측정한 결과, 다음과 같은 일관된 계층 구조가 드러났다.

-

초기 층(0‑3): 피치와 에너지와 같은 동적 프로소디 특성이 최고 정확도를 보이며, 이는 CNN 기반 저수준 음향 필터가 주파수·진폭 변화를 직접 포착함을 의미한다. 성별은 안정적인 스펙트럼 특성으로 인해 모든 층에서 높은 정확도를 유지한다.

-

중간 층(4‑12): 템포와 감정이 점진적으로 상승한다. 특히 템포는 언어적 리듬과 연관되어 있어, 중간 층에서 음향‑언어 간의 추상화가 진행되는 시점에 최적의 표현을 만든다. 감정 역시 초기부터 일정 수준을 유지하지만, 중간 층에서 약간의 향상이 관찰된다.

-

최종 층(>12): 대부분의 모델에서 화자 정체성(Speaker ID) 정확도가 감소하고, 언어 내용에 특화된 표현이 강화된다. 그러나 WavLM‑Large, WavLM‑Base‑Plus, HuBERT‑XLarge 등 대형 모델은 최종 층에서도 화자 식별 정확도가 다시 상승하는 현상을 보였다. 이는 모델 규모와 사전학습 데이터(노이즈·다중 화자) 가중치가 깊은 층에서도 화자 고유 정보를 보존하도록 학습되었음을 시사한다.

스케일 효과도 두드러졌다. Large·XLarge 변형은 Small·Base 대비 평균 3‑5%p의 정확도 향상을 보였으며, 특히 감정과 화자 정체성 같은 고차원 특성에서 큰 폭의 개선을 나타냈다. 반면 기본적인 피치·에너지와 같은 저차원 특성은 모델 크기에 크게 의존하지 않아, 경량 모델도 충분히 경쟁력 있는 성능을 제공한다.

마지막으로, 전통적인 딥 스피커 임베딩(E‑TDNN, ResNet‑r‑vector, CAM++)과 비교했을 때, SSL 모델은 프로소디와 감정 같은 동적·정서적 특성을 더 풍부하게 인코딩한다는 점이 확인되었다. 이는 일반 목적 SSL 모델이 화자 특성을 다차원적으로 학습함을 의미하며, downstream 작업에서 중간 층을 선택하면 화자 스타일 제어와 같은 세밀한 조작이 가능함을 암시한다.

댓글 및 학술 토론

Loading comments...

의견 남기기