아라비아어를 위한 신뢰성 높은 도구 호출: 데이터 중심 파인튜닝으로 구조화된 액션 구현

본 논문은 270M 파라미터 FunctionGemma 기반 모델을 아라비아어 도구 호출에 특화시키기 위해 데이터 감사·스키마 복구·툴 샘플링·전체 파라미터 파인튜닝을 수행한다. 파인튜닝 후 파싱 실패율을 87%에서 1% 이하로 낮추고, 함수명 정확도를 8배 이상 향상시켰으며, 방언·도메인 전반에 걸쳐 인자 정렬을 크게 개선한다. 또한 중간 추론을 삽입한 LoRA 변형을 탐색한다.

저자: Omer Nacar, Deema Alquffari, Saleh Alsharideh

본 논문은 아라비아어 환경에서 함수 호출(툴 사용) 기능을 안정적으로 제공하기 위한 종합적인 시스템을 제시한다. 연구 배경으로, 대형 언어 모델(LLM)이 텍스트 생성뿐 아니라 외부 API 호출을 통해 실제 작업을 수행하는 ‘에이전트’ 역할을 수행하게 되면서, 구조화된 출력(JSON, AST 등)의 정확성이 핵심 과제로 부각되었다. 특히 다국어 모델은 영어에서는 비교적 높은 성공률을 보이지만, 형태소가 복잡하고 방언이 다양한 아라비아어에서는 파싱 오류, 인자 누락, 툴 선택 오류 등이 빈번히 발생한다.

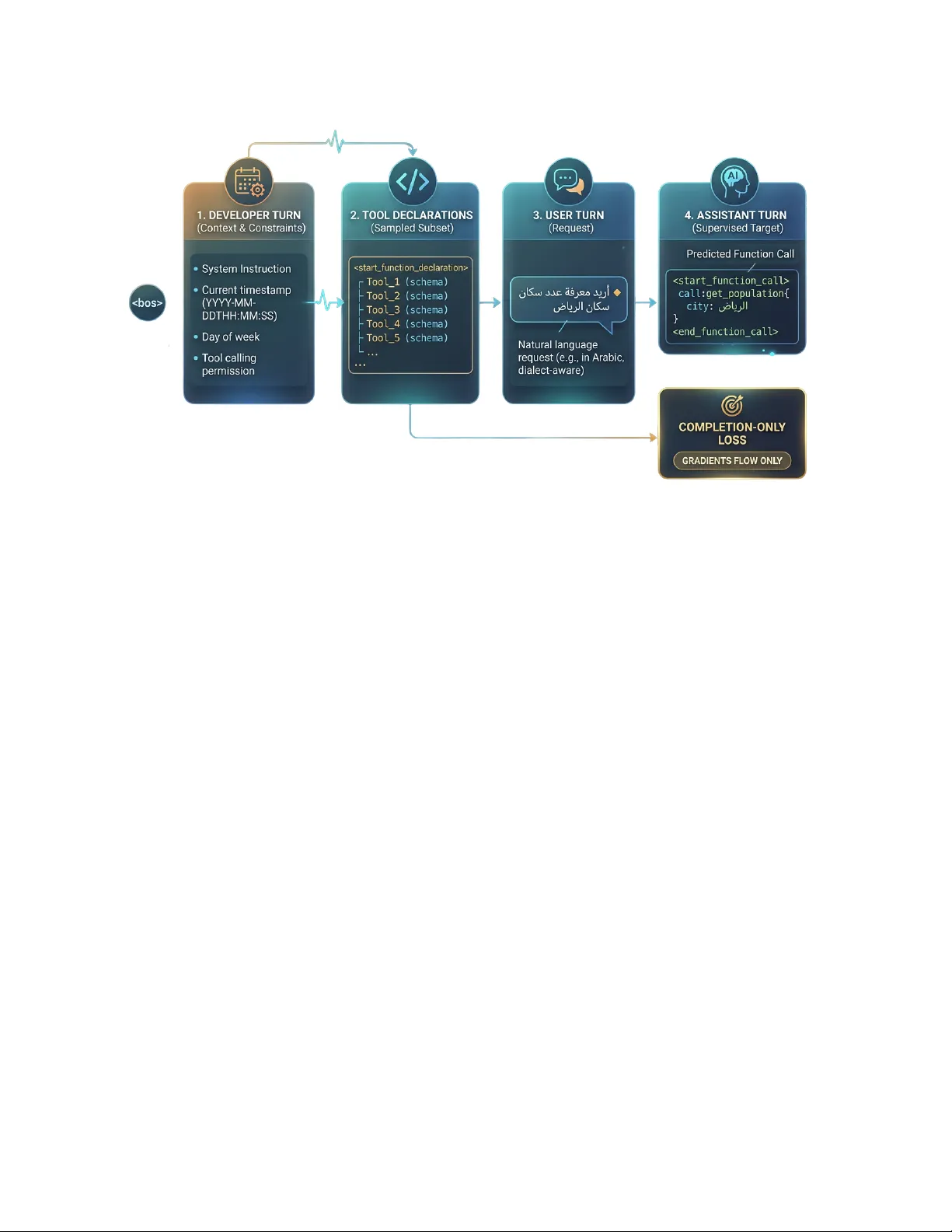

이를 해결하기 위해 저자들은 270M 파라미터 FunctionGemma(‘FunctionGemma‑270M‑it’)를 베이스 모델로 삼고, 전통적인 프롬프트 엔지니어링을 넘어 데이터 중심(data‑centric) 파인튜닝 파이프라인을 구축했다. 파이프라인은 크게 네 단계로 구성된다.

1️⃣ **데이터 구조 감사 및 스키마 복구**

- 원본 아라비아어 함수 호출 데이터셋(≈50k 샘플, 36개 툴, 5개 방언)을 자동 감사하여 빈 쿼리, enum 위반, 툴 중복 등을 탐지한다.

- enum 파라미터에 ‘None‑is‑valid’ 규칙을 적용해 옵션 값이 비어 있어도 유효하도록 수정함으로써 수천 개의 샘플을 복구하고, 6개의 툴을 ‘죽은’ 상태에서 회복한다.

- 다양한 표기(아라비아어 표면형, 영문 변형, 자유 텍스트)를 표준 enum 값으로 매핑하고, 스키마 일관성을 강화한다.

2️⃣ **툴 최적화 및 프롬프트 길이 감소**

- 중복·노이즈가 높은 툴을 제거하고, 툴 인벤토리를 36→27개로 축소한다.

- 모든 툴 선언을 포함하면 4,900 토큰을 초과해 2,048 토큰 제한에 걸리므로, ‘툴 샘플링’ 알고리즘을 도입한다. 각 학습 예시는 정확한 툴 1개와 무작위 방해 툴 4개를 포함해 총 5개 툴만 선언한다. 이는 프롬프트 길이를 1,200 토큰 이하로 유지하면서도 모델이 툴 선언을 충분히 인식하도록 만든다.

3️⃣ **FunctionGemma 포맷에 맞춘 채팅 직렬화**

- 툴 선언, 사용자 질의, 어시스턴트 응답을 FunctionGemma 전용 제어 토큰(

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기