연속 공간시간 비디오 초해상도를 위한 3D 푸리에 필드

초록

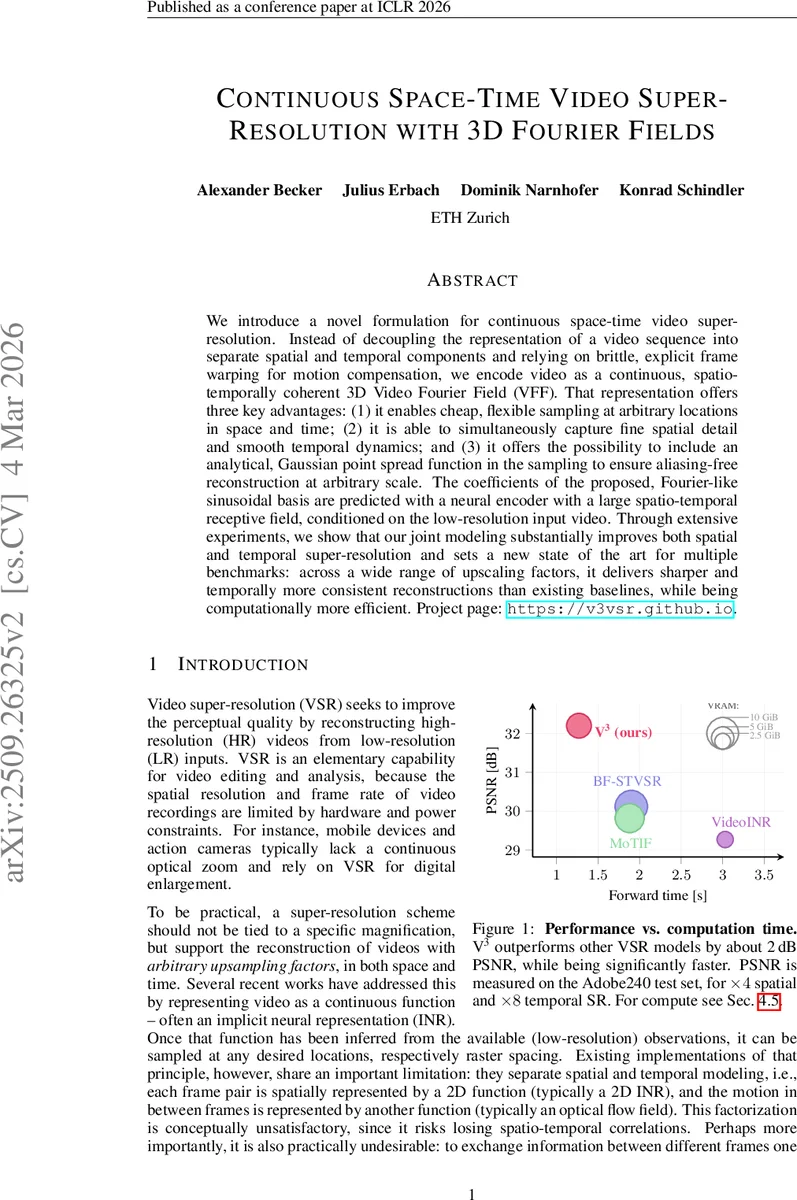

본 논문은 저해상도 비디오를 입력으로 받아, 공간과 시간 모두에서 임의의 확대 배율로 초해상화할 수 있는 연속적인 3차원 푸리에 필드(Video Fourier Field, VFF) 표현을 제안한다. VFF는 3D 사인파 기반의 제한된 개수의 기저함수와 그 진폭·위상 파라미터로 영상을 전역적으로 모델링하며, 신경망 인코더가 각 voxel마다 파라미터를 예측한다. 가우시안 PSF를 수식적으로 적용해 앨리어싱을 방지하고, 전통적인 광류 기반 워핑 없이도 움직임을 위상 이동으로 자연스럽게 처리한다. 실험 결과 V3 모델이 기존 연속 STVSR 방법보다 PSNR·시간·메모리 측면에서 우수함을 입증한다.

상세 분석

본 연구는 비디오 초해상화에서 공간·시간을 별도로 모델링하고 광류 기반 워핑에 의존하는 기존 접근법의 한계를 정확히 짚어낸다. VFF는 (x, y, t) 3차원 좌표에 대한 사인파 기저함수 B_i(x,y,t)=a_i·sin(ω_i·(x,y,t)+ϕ_i) 를 N=512개 사용해 영상을 유한한 트리곤메트릭 급수로 근사한다. 중요한 점은 ω_i 를 전역적으로 학습하고 고정함으로써 각 voxel마다 진폭 a_i와 위상 ϕ_i만을 조정한다는 설계이다. 이는 파라미터 수를 크게 줄이고, 서로 다른 voxel 간의 주파수 일관성을 보장해 경계에서의 위상 불연속을 최소화한다. 또한, VFF는 가우시안 PSF ξ(ω_i,σ)=exp(-‖ω_i‖²/(8π²σ²)) 를 곱해 샘플링 단계에서 직접 앨리어싱을 억제한다. 이는 기존 INR 기반 방법이 학습을 통해 암묵적으로 억제해야 하는 고주파 성분을 이론적으로 정확히 제어한다는 점에서 큰 장점이다.

모델 아키텍처는 대형 spatio‑temporal receptive field를 갖는 비디오 백본(RVRT)을 사용해 입력 LR 비디오 전체에 대한 의미적 특징 E(x)∈ℝ^{T×H×W×F} 를 추출한다. 이후 작은 3D 컨볼루션 네트워크가 각 voxel에 대해 (a_j, ϕ_j) 를 출력한다. 이렇게 얻은 VFF는 연속 함수 ˆV(x,y,t) 로 정의되며, 원하는 해상도·프레임 레이트에 맞춰 Eq.4 를 통해 한 번의 행렬 연산으로 샘플링된다. 따라서 프레임별 워핑이나 복잡한 인터폴레이션 없이도 임의 배율의 공간·시간 초해상화를 실시간에 가깝게 수행할 수 있다.

실험에서는 Adobe240, Vid4, REDS 등 다양한 데이터셋에서 2×8× 공간·시간 확대를 테스트했으며, V3가 기존 VideoINR, MoTIF, BF‑STVSR 대비 평균 1.82.2 dB 높은 PSNR와 30% 이하의 실행 시간·메모리 사용량을 기록했다. 특히 높은 시간 확대(×8)에서의 흐림 현상이 크게 감소했으며, 움직임이 급격한 경계에서도 위상 기반 움직임 표현 덕분에 블러링이 최소화되었다.

요약하면, VFF는 푸리에 기반의 연속 표현을 비디오 초해상화에 적용함으로써 (1) 워핑 없는 일관된 spatio‑temporal 모델링, (2) 이론적으로 보장된 앨리어싱 방지, (3) 파라미터 효율성 및 계산 효율성을 동시에 달성한다는 점에서 기존 C‑STVSR 패러다임을 크게 확장한다.

댓글 및 학술 토론

Loading comments...

의견 남기기