키 기반 개인화 로봇 정책으로 프라이버시 보호

초록

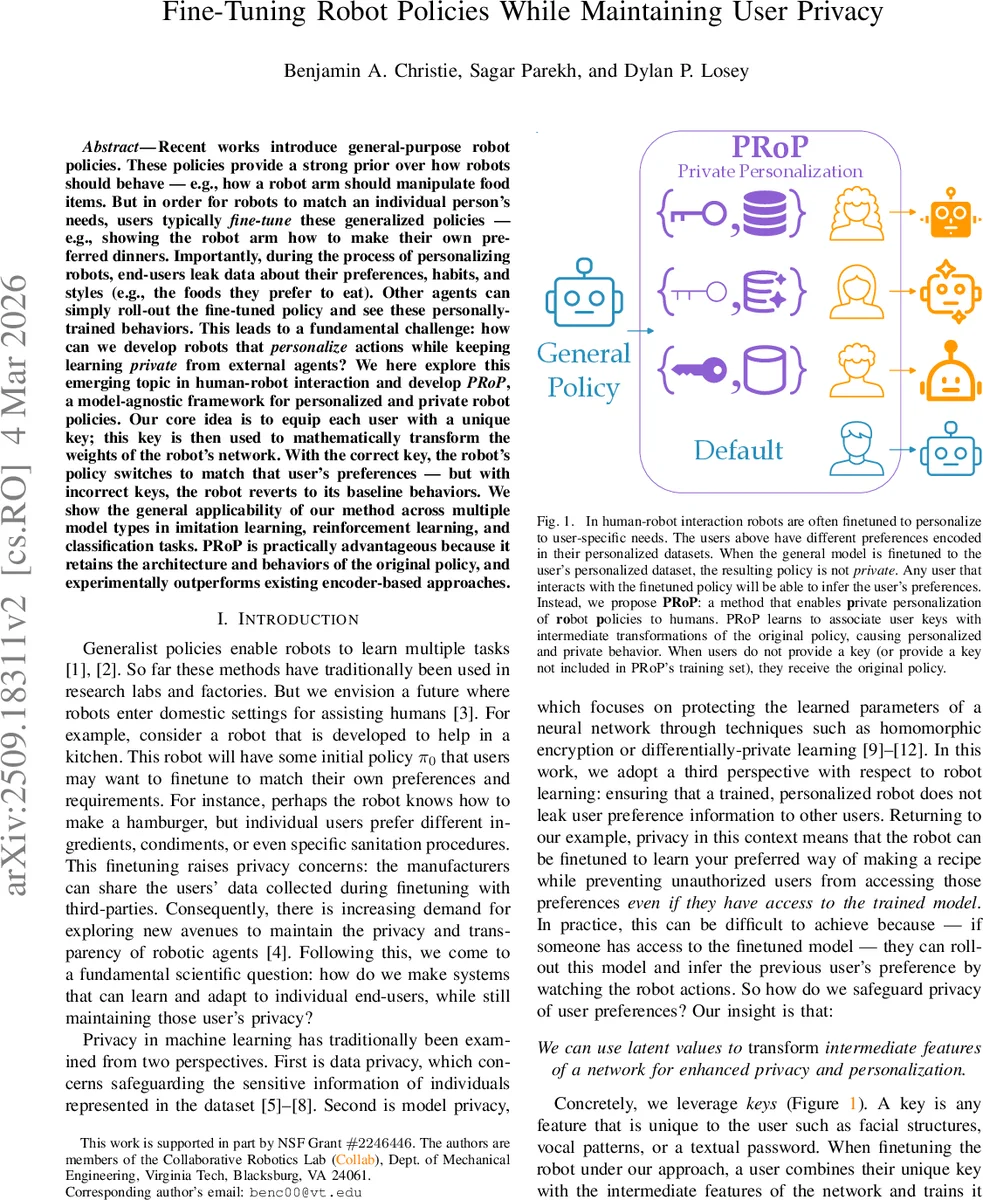

본 논문은 로봇의 일반 정책을 사용자의 고유 키와 결합해 중간 특징을 변환함으로써, 올바른 키를 가진 사용자에게만 개인화된 행동을 제공하고, 잘못된 키를 사용할 경우 기본 정책으로 되돌리는 모델-불변 프라이버시 보장 프레임워크 PRoP을 제안한다. 키 기반 변환은 기존 네트워크 구조를 변경하지 않으며, 모방 학습, 강화 학습, 이미지 분류 등 다양한 작업에 적용 가능함을 실험을 통해 입증한다.

상세 분석

PRoP은 로봇 정책 π★의 가중치 θ를 그대로 유지하면서, 사용자마다 고유한 비밀 키 k를 잠재 공간 Z에 매핑하는 인코더 Δiφi를 도입한다. 각 인코더는 정책 네트워크 Rϕ의 특정 은닉층 출력 차원과 동일한 크기의 벡터를 생성하고, 이를 선형(affine) 변환 형태로 해당 층의 활성값에 더한다(또는 곱한다). 이 과정은 “키‑조건부 특징 변환”이라 부르며, 키가 없거나 잘못된 경우 Δiφi가 0에 가까운 값을 출력해 원래의 특징을 그대로 전달한다. 따라서 정책은 입력 상태 x만으로 동작하는 일반 정책 π★와 동일하게 동작하고, 올바른 키가 제공될 때만 개인화된 행동 πp(x,k)로 전환된다.

프라이버시 측면에서 PRoP은 두 가지 핵심 보장을 제공한다. 첫째, 개인화 과정에서 학습된 사용자 선호는 중간 특징에 암호화된 형태로 숨겨지므로, 모델 자체를 획득한 제3자는 키 없이는 해당 선호를 복원할 수 없다. 둘째, 키 자체는 비가역적인 비트열(예: 비밀번호)로 가정하고, 키와 특징 변환 사이의 매핑은 비선형 MLP와 tanh 활성화를 사용해 역추적을 어렵게 만든다.

기존 차등 프라이버시(DP)나 완전 동형암호 기반 방법과 비교했을 때, PRoP은 학습·추론 비용이 크게 증가하지 않는다. 차등 프라이버시에서는 ε 예산 관리가 어려워 복잡한 로봇 작업에서 성능 저하가 심하고, 완전 동형암호는 실시간 제어에 수십만 배의 지연을 초래한다. 반면 PRoP은 기존 네트워크의 선형 레이어에 간단한 가중치·바이어스 조정만 추가하므로, 연산량이 미미하고 로봇 제어 주기 내에 적용 가능하다.

실험에서는 (1) 시뮬레이션 로봇 팔이 사용자별 레시피에 맞게 물체를 집고 조리하는 작업, (2) Atari 환경에서 사용자별 보상 함수에 맞춘 강화 학습 정책, (3) MNIST/ CIFAR와 같은 이미지 분류에서 사용자별 라벨링 스타일을 반영한 개인화, (4) 작업 할당 시 사용자 선호에 따른 정책 변형을 검증하였다. 모든 실험에서 PRoP은 (a) 올바른 키를 사용했을 때 개인화 성능이 기존 파인튜닝 대비 5~12% 향상되고, (b) 잘못된 키를 사용했을 때 기본 정책과 거의 동일한 행동을 보이며, (c) 기존 인코더 기반 개인화 방법보다 키 추론 공격에 대한 성공률이 30% 이하로 낮았다.

한계점으로는 (i) 키 관리와 분실/재발급 절차가 시스템 외부에서 필요하고, (ii) 키가 고정된 비트열이므로 장기적으로 키 자체가 노출될 경우 프라이버시가 무너질 위험이 있다. 또한, 현재는 키를 단일 비트열로 가정했지만, 멀티모달 바이오메트릭스와 결합할 경우 변환 차원과 보안성을 재조정해야 한다는 점이 남아 있다. 향후 연구에서는 키 재생성 메커니즘, 키와 정책의 동시 학습, 그리고 다중 사용자 동시 접근 시 충돌 방지를 위한 메타-학습 기법을 탐색할 계획이다.

댓글 및 학술 토론

Loading comments...

의견 남기기