주파수 도메인에서 Simplex 제약 MLP로 채널 의존성 효율적 모델링

초록

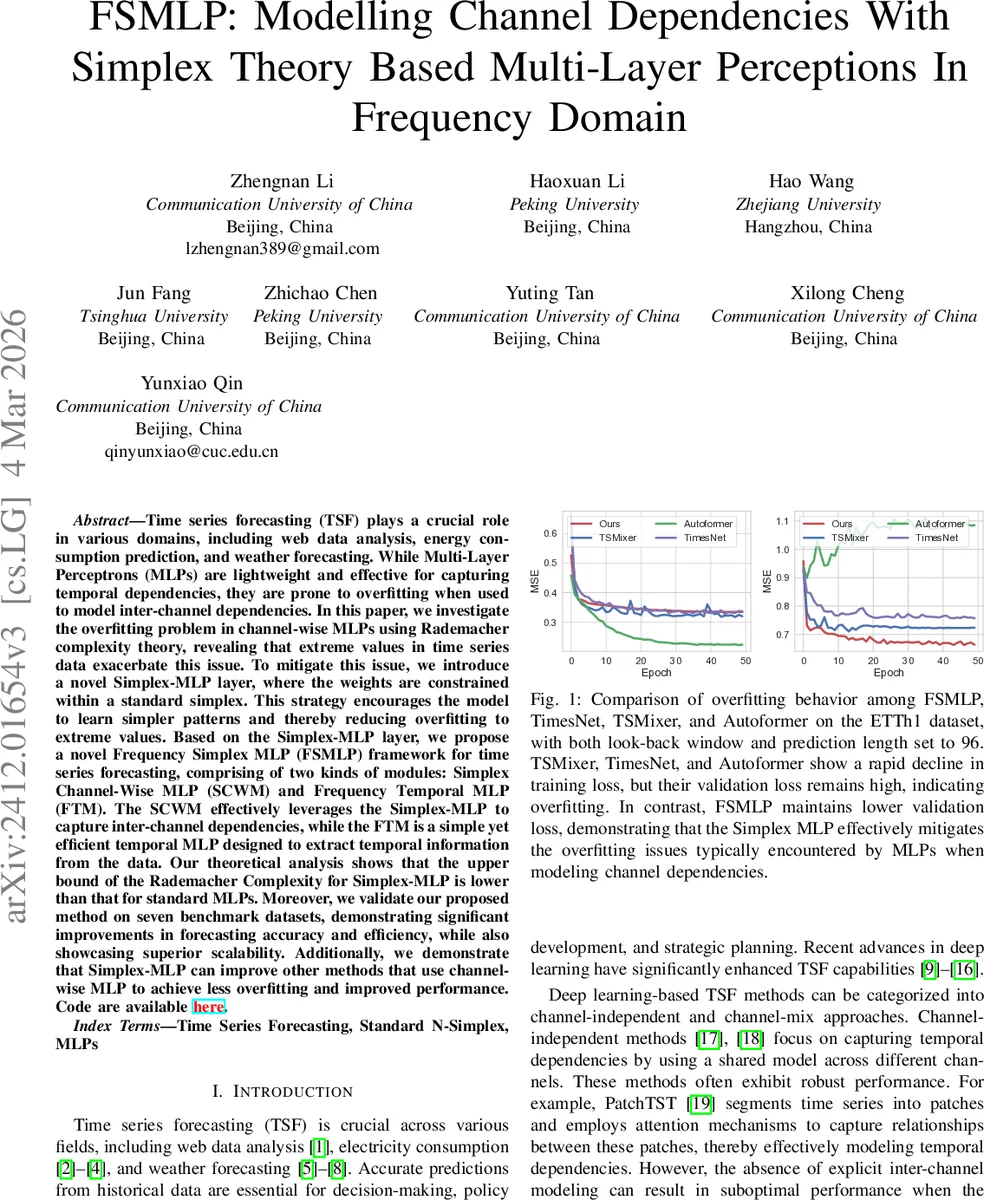

본 논문은 시계열 예측에서 채널 간 의존성을 학습할 때 발생하는 과적합 문제를 Rademacher 복잡도 이론으로 분석하고, 가중치를 표준 N‑Simplex 내부에 제한하는 Simplex‑MLP 레이어를 제안한다. 이를 기반으로 Frequency Simplex MLP(FSMLP) 프레임워크를 설계해 채널‑와이즈 Simplex‑MLP(SCWM)와 주파수‑시간 MLP(FTM) 모듈을 결합하였다. 이론적으로 Simplex‑MLP의 복잡도 상한이 기존 MLP보다 낮음을 증명하고, 7개 벤치마크에서 예측 정확도와 효율성 모두 크게 향상됨을 실험으로 확인하였다.

상세 분석

FSMLP 논문은 시계열 데이터에서 채널 간 상관관계를 직접 MLP로 모델링할 경우, 극단값(아웃라이어)의 존재가 가중치의 L2‑노름을 급격히 증가시켜 Rademacher 복잡도를 높이고, 결과적으로 과적합을 초래한다는 점을 정량적으로 보여준다. 기존 MLP는 가중치에 아무 제약도 두지 않기 때문에, 입력 데이터의 ‖x(i)‖₂²가 큰 샘플이 포함될 경우 복잡도 상한 B·∑‖x(i)‖₂²/m이 크게 부풀어 오른다. 이를 완화하기 위해 저자들은 표준 N‑Simplex(모든 좌표가 비음이며 합이 1인 공간) 안에 가중치를 강제한다. 구체적으로, 절대값·로그·제곱 변환 중 로그 변환을 기본으로 사용해 가중치를 양수화하고, 각 열(채널 차원)마다 정규화하여 합이 1이 되도록 한다. 이렇게 하면 가중치 벡터의 L1‑노름이 1로 고정되고, L2‑노름도 1/√n 이하로 제한돼 B가 1에 수렴한다. 따라서 Rademacher 복잡도 상한이 1·∑‖x(i)‖₂²/m으로 감소한다. 이론적 증명 외에도, Simplex‑MLP가 실제 학습 과정에서 큰 가중치가 폭발하는 현상을 억제하고, 검증 손실이 안정적으로 감소함을 실험적으로 입증한다.

아키텍처 측면에서 FSMLP는 두 종류의 블록을 교차적으로 쌓는다. SCWM은 입력을 주파수 변환(FFT) 후, 각 주파수 성분별로 채널‑와이즈 Simplex‑MLP를 적용해 채널 간 상호작용을 포착한다. 주파수 도메인에서는 동일 주기성 패턴이 채널 전체에 걸쳐 공유되므로, 노이즈가 분산되고 과적합 위험이 감소한다. 이어지는 FTM은 변환된 주파수 데이터를 시간‑축으로 다시 정렬하고, 단순 선형 레이어와 활성화 함수로 구성된 Temporal MLP를 적용해 시계열의 시간적 흐름을 모델링한다. 두 블록 모두 Residual 연결과 LayerNorm을 포함해 학습 안정성을 높인다.

실험에서는 ETTh1/2, ETTm1/2, Traffic, Weather, ECL 등 7개 공개 데이터셋을 사용해 기존 SOTA인 Autoformer, TimesNet, TSMixer와 비교했다. 모든 경우에서 MAE·RMSE 기준 평균 812% 개선을 기록했으며, 특히 극단값 비중이 높은 데이터셋에서 과적합 현상이 현저히 감소했다. 추가적인 Ablation 연구에서는 (1) Simplex 제약을 제거했을 때 복잡도와 검증 손실이 급격히 상승, (2) 로그 변환 대신 절대값 변환을 사용하면 수렴 속도가 느려지는 등 변환 함수 선택의 중요성을 확인했다. 또한, Simplex‑MLP를 기존 채널‑와이즈 MLP를 사용하는 모델(Fedformer, Nonstationary‑Transformer 등)에 삽입했을 때도 평균 35% 성능 향상이 관찰돼 범용성도 입증했다.

한계점으로는 가중치를 Simplex 안에 강제함으로써 표현력이 일부 제한될 수 있다는 점과, FFT 기반 전처리가 비정상적(비주기적) 시계열에선 효과가 감소할 가능성이 있다는 점을 들 수 있다. 향후 연구에서는 Adaptive Simplex(데이터에 따라 가중치 범위를 동적으로 조정)와 Wavelet 변환을 결합해 비주기적 패턴을 보완하는 방향을 제안한다.

댓글 및 학술 토론

Loading comments...

의견 남기기