시각‑언어 모델의 혼동을 줄이는 혼동 인식 프롬프트 튜닝

초록

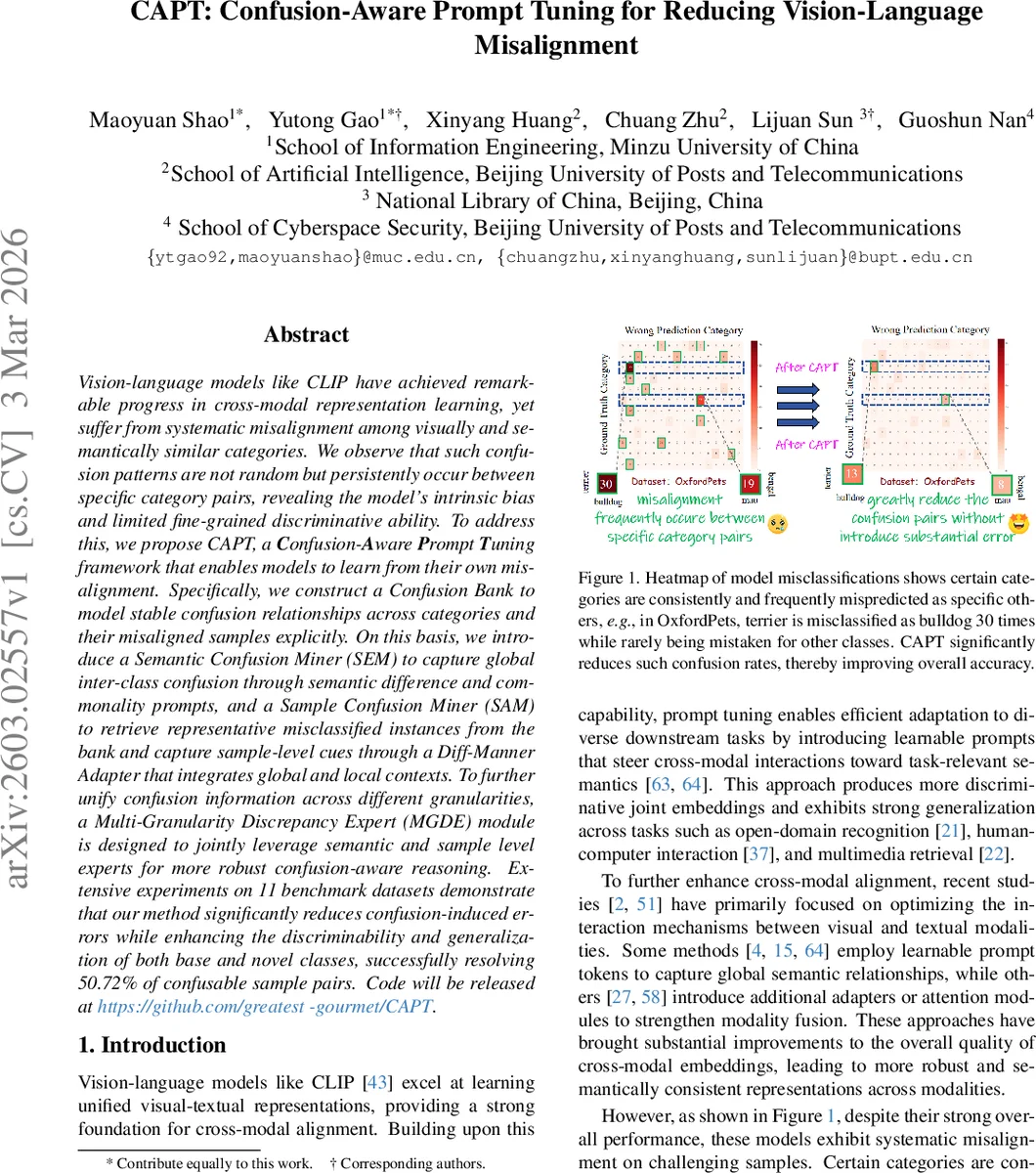

CAPT는 CLIP과 같은 대형 시각‑언어 모델이 비슷한 시각·텍스트 클래스 사이에서 지속적으로 발생시키는 혼동을 정량화·저장하는 ‘혼동 은행’과, 이를 활용해 전역(semantic)·국부(sample) 수준의 혼동을 각각 추출·보정하는 두 마이너(SEM, SAM)를 도입한다. 두 마이너의 정보를 다중‑Granularity 차이 전문가(MGDE)로 통합해 프롬프트를 조정함으로써, 기존 대비 50 % 이상의 혼동 샘플을 바로잡고, 베이스·노벨 클래스 모두에서 정확도를 크게 향상시킨다.

상세 분석

CAPT는 기존 CLIP 기반 프롬프트 튜닝이 전역 이미지‑텍스트 유사도만을 최적화해 미세한 클래스 구분 능력이 부족하다는 점을 정확히 짚어낸다. 논문은 먼저 “혼동 은행(Confusion Bank)”을 구축한다. 이는 모델이 훈련 중에 오분류한 샘플을 해당 오분류 클래스와 연결해 저장하는 데이터 구조로, 클래스 간 지속적인 혼동 관계를 정량화한다. 이 은행을 기반으로 두 단계의 마이너가 설계된다.

-

Semantic Confusion Miner (SEM)

- pseudo‑GT를 이용해 모델 자체의 최고 신뢰도 예측을 ‘잠재적 정답’으로 정의하고, 해당 클래스의 혼동 통계(n_i)를 은행에서 추출한다.

- 혼동 점수 S_i = (1 + n_i / Σ n_i)·C_i 로 계산해, 단순 신뢰도만을 보는 것보다 모델이 실제로 자주 혼동하는 클래스를 강조한다.

- LLM(대형 언어 모델)을 활용해 혼동 클래스 쌍에 대한 “공통성 프롬프트”와 “차이점 프롬프트”를 자동 생성한다. 이는 텍스트 프롬프트 공간에 클래스 간 미묘한 의미 차이를 명시적으로 삽입해, CLIP이 두 클래스 사이의 경계선을 더 명확히 학습하도록 돕는다.

-

Sample Confusion Miner (SAM)

- SEM이 제시한 혼동 클래스 쌍을 기준으로, 혼동 은행에서 해당 클래스에 속한 오분류 샘플들을 조회한다.

- 각 혼동 클래스당 가장 대표적인 샘플 I*_c 를 코사인 유사도로 선정해, 잡음이 많은 다수 샘플 대신 핵심 혼동 인스턴스만을 사용한다.

- 선택된 샘플과 현재 입력 이미지 I 사이의 차이를 추출하기 위해 “Diff‑Manner Adapter”를 도입한다. 이 어댑터는 ViT 블록의 CLS 토큰을 이용한 전역 어텐션과, 2D depthwise convolution을 통한 지역 디테일을 동적으로 가중치 α로 결합한다. 결과적으로 전역적인 클래스 간 차이와 국부적인 픽셀‑레벨 차이를 동시에 포착한다.

-

Multi‑Granularity Discrepancy Expert (MGDE)

- SEM과 SAM에서 얻은 전역(semantic)·국부(sample) 차이 특징을 각각 “전문가” 모듈로 처리한다.

- 각 전문가의 출력은 가중합을 통해 최종 혼동‑보정 프롬프트에 반영되며, 학습 단계에서는 InfoNCE 기반의 혼동 손실 L_confuse를 적용해 긍정·부정 쌍을 명시적으로 구분한다.

- 또한, semantic 프롬프트 토큰을 클러스터링해 토큰 수를 압축하면서도 표현력을 유지한다. 이는 저분산 토큰이 혼동 클래스 예측에 미치는 부정적 영향을 최소화한다.

실험에서는 11개 데이터셋(예: OxfordPets, ImageNet‑R 등)에서 CAPT가 기존 프롬프트 튜닝 기법 대비 평균 2~4%p의 정확도 상승을 보였으며, 특히 “confusable” 샘플 쌍의 50.72%를 올바르게 분류했다. 베이스와 노벨 클래스 모두에서 Harmonic Mean(HM) 83.90%를 달성, 기존 최고 기록을 넘어섰다.

핵심 기여는 (1) 모델 자체의 혼동 패턴을 정량화·저장하는 체계적인 인프라, (2) 전역·국부 수준의 혼동을 각각 특화된 마이너로 추출, (3) 이를 다중‑Granularity 전문가로 통합해 프롬프트를 직접 보정한다는 점이다. 이러한 설계는 기존 프롬프트 튜닝이 놓치던 “고정된 혼동 패턴”을 학습 신호로 전환함으로써, 미세한 클래스 구분 능력을 크게 향상시킨다.

댓글 및 학술 토론

Loading comments...

의견 남기기