과정 중심 검증: 일반화 가능한 다중모달 조작 탐지를 위한 포렌식 추론 강화

초록

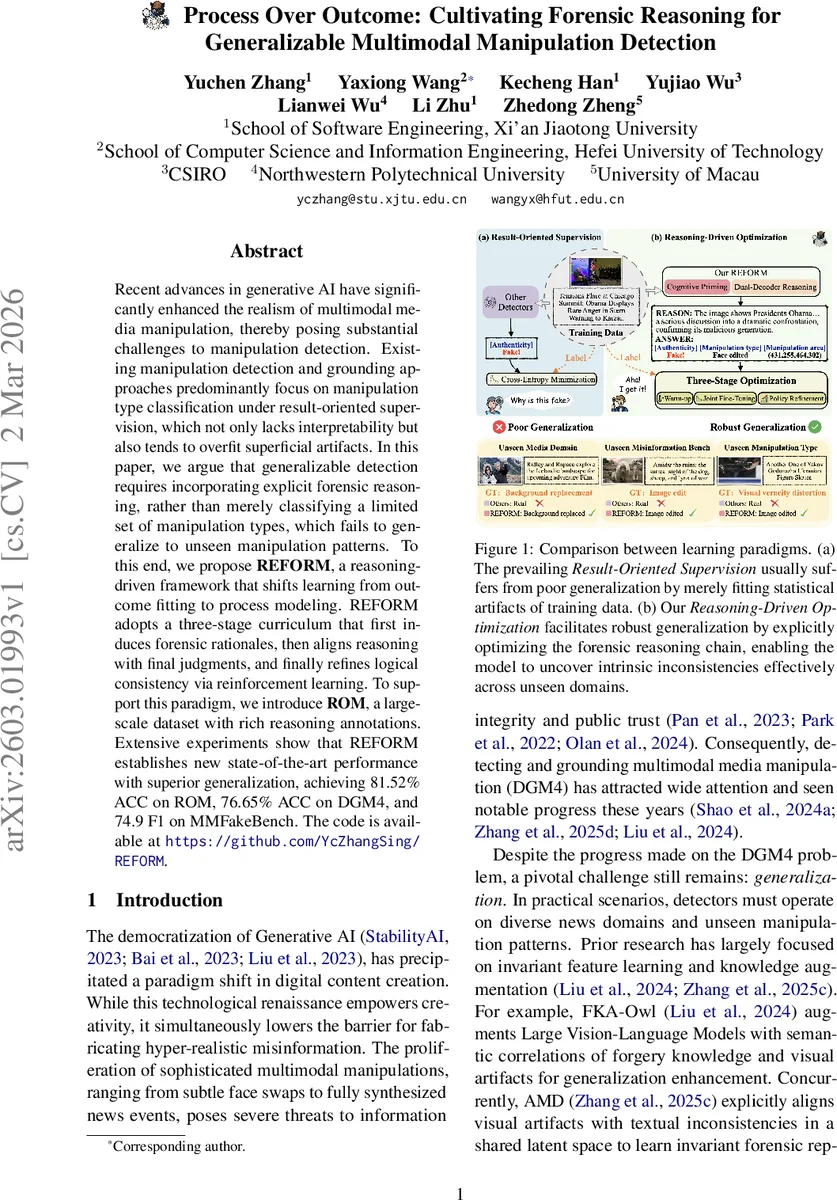

본 논문은 결과‑지향적 학습이 조작 탐지의 일반화에 한계를 보인다는 점을 지적하고, 포렌식 추론 과정을 명시적으로 학습하도록 설계된 REFORM 프레임워크를 제안한다. 세 단계 커리큘럼과 강화학습 기반 정책 최적화를 통해 추론 일관성을 강화하고, 풍부한 이유 주석을 제공하는 ROM 데이터셋을 구축해 실험적으로 우수한 성능과 도메인 간 일반화 능력을 입증한다.

상세 분석

본 연구는 최근 생성 AI가 만든 고품질 다중모달 조작이 기존 탐지기들의 표면적 특징에만 의존하는 결과‑지향적(supervised) 학습으로는 충분히 대응하지 못한다는 근본적인 문제를 제기한다. 저자들은 “결과‑맞춤” 방식이 데이터셋에 존재하는 통계적 편향을 과도하게 학습하게 만들고, 새로운 조작 패턴이나 도메인 전이 시 급격히 성능이 저하되는 현상을 실증한다. 이를 극복하기 위해 제안된 REFORM은 “과정‑중심” 학습(paradigm shift)을 구현한다.

첫 번째 단계인 Cognitive Reasoning Warm‑up에서는 대규모 데이터 증류(distillation)를 통해 모델이 포렌식적 근거(예: 시각적 불일치, 텍스트‑이미지 의미 불일치, 메타데이터 이상 등)를 자연어 형태로 서술하도록 사전 학습한다. 이 과정은 단순 라벨 예측이 아니라 “왜 이 조작인가?”라는 질문에 대한 설명을 생성하게 함으로써, 모델 내부에 추론용 표현 공간을 형성한다.

두 번째 단계인 Reasoning‑Endowed Joint Fine‑Tuning에서는 앞 단계에서 생성된 이유와 최종 판정(진위) 사이의 정합성을 학습한다. 구체적으로, 이유 텍스트와 이미지‑텍스트 페어를 다중모달 트랜스포머에 입력하고, 이유‑판정 일관성 손실(reason‑consistency loss)을 추가한다. 이는 모델이 이유가 논리적으로 모순될 경우 판정 점수를 낮추도록 강제한다.

세 번째 단계는 Constraint‑Aware Policy Refinement이다. 여기서는 그룹 상대 정책 최적화(GRPO) 기반 강화학습을 도입해, 이유 생성 과정 자체를 정책(policy)으로 보고, 최종 판정 정확도와 이유 일관성을 보상함수로 설정한다. 강화학습은 탐색 편향(exposure bias)을 완화하고, 모델이 “최적의 이유 경로”를 스스로 탐색하도록 만든다. 특히, 정책 업데이트 시 그룹 간 상대적 보상을 사용해 전체 배치 수준에서 일관성을 유지하도록 설계하였다.

데이터 측면에서 저자들은 ROM (Reasoning‑enhanced Omnibus Manipulation) 데이터셋을 구축했다. 기존 DGM4·MMFakeBench와 달리, ROM은 얼굴 교체, 배경 합성, 텍스트‑이미지 의미 불일치 등 다양한 조작 유형을 포함하며, 704k 이상의 샘플에 대해 인간 주석자가 상세한 포렌식 이유를 제공한다. 이는 모델이 “왜 조작인가”를 학습할 수 있는 풍부한 감독 신호를 제공한다.

실험 결과, REFORM은 ROM에서 81.52% 정확도, DGM4에서 76.65% 정확도, MMFakeBench에서 74.9 F1 점수를 기록하며, 기존 최첨단 모델(FKA‑Owl, AMD 등)을 크게 앞선다. 특히, 교차 도메인 테스트에서 이유 기반 학습이 통계적 편향에 덜 민감함을 확인했으며, 이유 텍스트의 품질을 인위적으로 저하시켜도 판정 성능이 크게 떨어지지 않는 점에서 일반화 능력이 입증된다.

한계점으로는 이유 생성 과정이 아직도 대규모 언어 모델에 의존하고 있어, 복잡한 논리 구조를 완전하게 표현하기엔 한계가 있다. 또한 강화학습 단계에서 보상 설계가 도메인에 따라 민감하게 작동할 수 있어, 보상 파라미터 튜닝이 필요하다. 향후 연구에서는 보다 구조화된 논리 체계(예: 증명 트리)와 멀티‑에이전트 협업을 도입해 이유의 신뢰성을 더욱 강화할 여지가 있다.

요약하면, REFORM은 “결과‑맞춤”에서 “과정‑맞춤”으로 학습 목표를 전환함으로써, 포렌식 추론을 명시적으로 모델링하고, 강화학습을 통해 논리적 일관성을 최적화한다. 이는 다중모달 조작 탐지 분야에서 일반화와 해석 가능성을 동시에 달성할 수 있는 새로운 패러다임을 제시한다.

댓글 및 학술 토론

Loading comments...

의견 남기기