꿈을 통한 연속 학습: Dream2Learn

초록

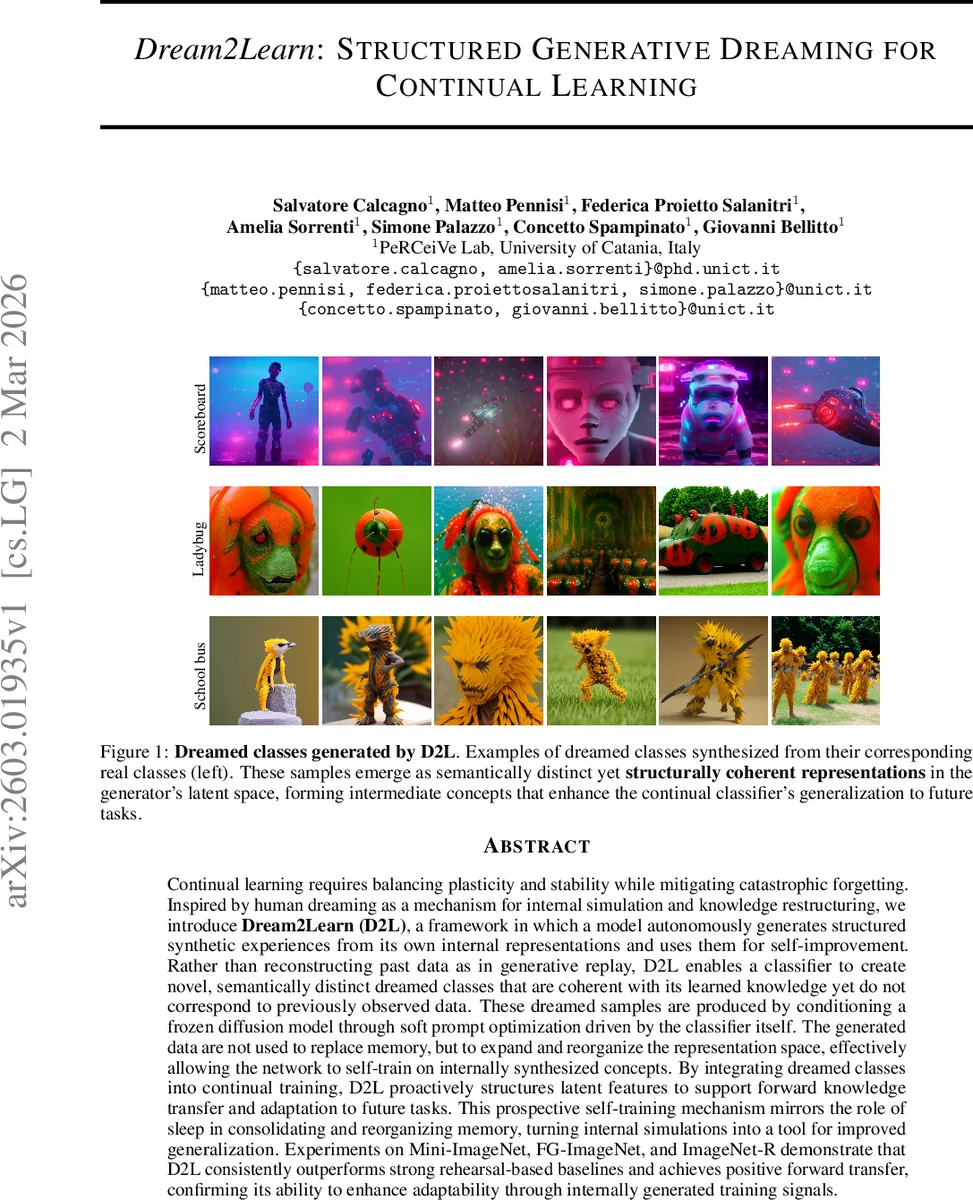

Dream2Learn(D2L)은 고정된 확산 모델을 소프트 프롬프트로 조절해 내부 표현으로부터 새로운 “꿈” 클래스를 자동 생성하고, 이를 연속 학습 과정에 보조 데이터로 활용한다. 실제 과거 데이터를 재현하는 기존 생성 리플레이와 달리, D2L은 의미적으로 구분되면서도 기존 지식과 구조적으로 일치하는 합성 샘플을 만들어 표현 공간을 사전에 재구성한다. 실험 결과 Mini‑ImageNet, FG‑ImageNet, ImageNet‑R에서 재현 기반 방법들을 지속적으로 능가하며, 전방 전이(positive forward transfer)를 달성한다.

상세 분석

본 논문은 연속 학습(Continual Learning, CL)에서 플라스티시티와 스테이빌리티 사이의 균형을 맞추는 기존 접근법들의 한계를 인지하고, 인간의 수면 중 꿈을 통한 기억 재구성 메커니즘을 모델링한다. 핵심 아이디어는 “꿈”이라는 형태의 자체 생성 데이터를 활용해 미래 과업에 대비하도록 표현 공간을 사전에 구조화하는 것이다. 이를 위해 저자들은 사전 학습된 라텍스 기반 확산 모델(Latent Diffusion Model, LDM)을 고정하고, 각 클래스마다 학습 가능한 소프트 프롬프트(p_soft)와 고정 텍스트 프롬프트(p_text)를 결합한 조건 p_c를 만든다. 프롬프트 최적화는 현재 모델 F_θ가 해당 프롬프트로 생성된 이미지 x_d를 목표 클래스 c로 올바르게 분류하도록 교차 엔트로피 손실을 최소화함으로써 수행된다. 중요한 점은 최적화 과정에서 실제 클래스 c에 속하는 이미지들을 제외하고, 모델이 아직 보지 못한 “중간” 개념을 탐색하도록 유도한다는 것이다. 이렇게 생성된 꿈 클래스는 실제 데이터와 시각적으로 유사하지만 의미적으로는 구분되는 영역에 위치한다.

꿈 클래스는 버퍼에 저장되지 않고, 프롬프트 자체만이 “꿈 인벤토리”에 보존된다. 매 학습 단계(t>1)에서는 새로운 실제 클래스들을 기존 꿈 클래스와 매핑하여 가장 높은 평균 로그우도 출력 뉴런에 연결한다. 이는 새로운 과업이 기존 꿈 클래스와 연관된 특징을 재활용하도록 하여 급격한 가중치 변동을 방지한다. 이후 실제 데이터 D_t와 남은 꿈 데이터 D*_t‑1를 합친 혼합 분포에 대해 표준 CL 손실(L_CE)과 리플레이 기반 정규화(L_CL)를 동시에 최적화한다. 꿈 데이터는 버퍼에 저장된 실제 샘플을 조건으로 사용해 다양성을 확보하고, 프롬프트는 매 과업마다 재학습된다.

또한, 꿈 생성 과정에서 “Oracle Net”이라는 별도 네트워크가 생성 이미지와 원본 이미지 사이의 구조적 붕괴를 감지해 최적화 종료 시점을 판단한다. 이는 프롬프트가 과도하게 수렴해 다양성을 잃는 현상을 방지한다.

실험에서는 D2L을 기존 Rehearsal 기반 방법(CLS‑ER, iCaRL 등)과 결합하거나 단독으로 적용했을 때, 평균 정확도와 전방 전이 지표 모두에서 유의미하게 개선됨을 보였다. 특히 Mini‑ImageNet에서 3‑task 설정 시 2~3%p 상승, ImageNet‑R에서 4%p 이상의 향상을 기록했다. 이는 꿈 클래스가 미래 과업에 대한 사전 특성 학습을 가능하게 함을 의미한다.

한계점으로는 고정된 대형 확산 모델에 대한 의존성, 프롬프트 최적화 비용, 그리고 꿈 클래스가 실제 데이터와 얼마나 의미적으로 겹치는지에 대한 정량적 평가가 부족한 점을 들 수 있다. 향후 연구에서는 경량화된 생성기, 다중 모달 꿈 생성, 그리고 꿈 클래스의 자동 라벨링 메커니즘을 탐구할 여지가 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기