신경 연산자 기반 연속 텐서 함수 표현 및 응용

안내: 본 포스트의 한글 요약 및 분석 리포트는 AI 기술을 통해 자동 생성되었습니다. 정보의 정확성을 위해 하단의 [원본 논문 뷰어] 또는 ArXiv 원문을 반드시 참조하시기 바랍니다.

초록

연속 텐서 함수의 표현 한계를 극복하기 위해, 저자들은 기존의 이산·선형 모드‑n 연산을 연속·비선형 신경 연산자로 대체한다. 이를 토대로 제안된 NO‑CTR(Neural Operator‑Grounded Continuous Tensor Representation)는 연속 코어 텐서 함수와 연속 모드‑n 연산자를 결합해 복잡한 실세계 데이터를 보다 정확히 재현한다. 이론적으로 모든 연속 텐서 함수를 근사할 수 있음을 증명하고, 다차원 데이터 복원 실험에서 기존 방법들을 크게 능가함을 보였다.

상세 분석

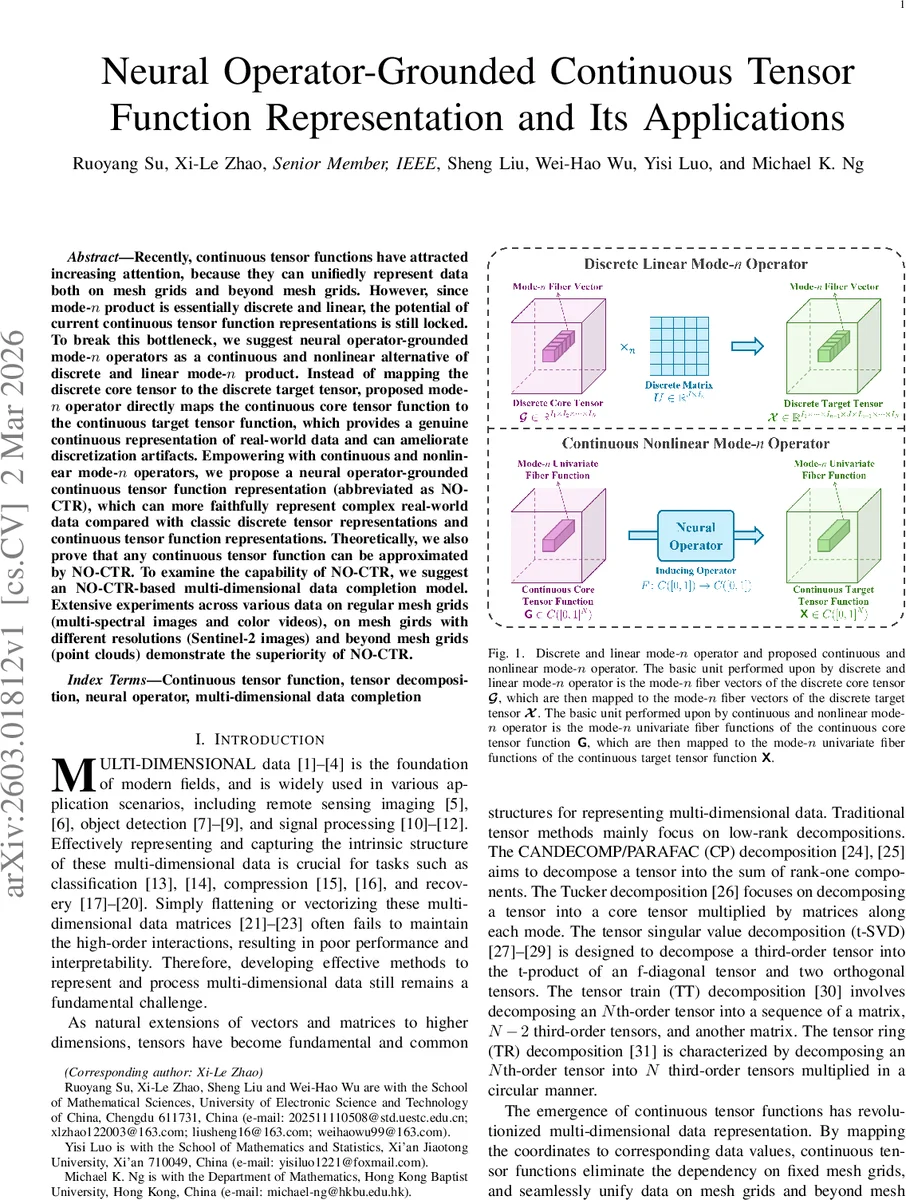

본 논문은 텐서 분해 분야에서 가장 근본적인 연산인 모드‑n 곱을 재해석한다. 전통적인 모드‑n 곱은 이산 코어 텐서와 행렬을 이용해 각 모드의 섬유 벡터를 선형 변환하는 방식으로, 좌표가 고정된 격자 위에서만 의미를 갖는다. 이러한 이산·선형 특성은 연속 텐서 함수가 제공하는 좌표‑값 매핑의 장점을 충분히 활용하지 못하고, 특히 격자 해상도가 변하거나 비격자 데이터(예: 포인트 클라우드)에서 심각한 근사 오류와 이산화 아티팩트를 초래한다.

저자들은 이 한계를 극복하기 위해 ‘연속·비선형 모드‑n 연산자’를 정의한다. 핵심 아이디어는 연속 코어 텐서 함수 G∈C(

댓글 및 학술 토론

Loading comments...

의견 남기기