멀티모달 비디오 융합을 위한 시공간 협업 네트워크 VideoFusion

초록

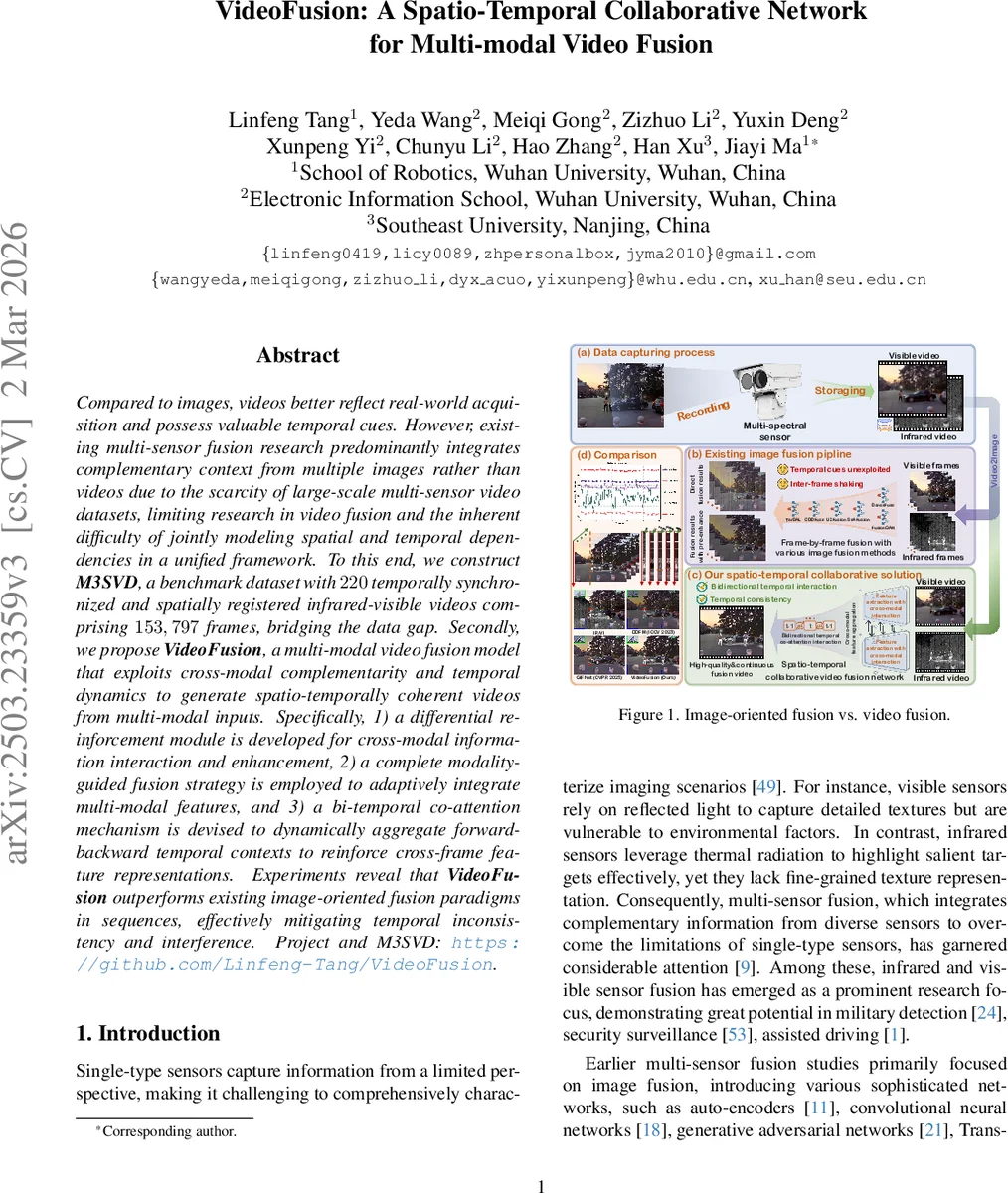

본 논문은 적외선·가시광 비디오를 동기화·정합한 대규모 데이터셋 M3SVD(220클립, 153 797프레임)를 공개하고, 시공간적 상호보완성을 동시에 활용하는 VideoFusion 모델을 제안한다. 핵심은 (1) 차분 강화 모듈을 통한 교차모달 정보 상호작용, (2) 모달리티‑가이드 융합 전략, (3) 전·후방 프레임을 동적으로 결합하는 양방향 시공간 코어션 메커니즘이다. 실험 결과, 기존 이미지 기반 융합 기법 대비 영상 전체에서 일관된 색감·디테일을 유지하며 플리커 현상을 크게 감소시킨다.

상세 분석

VideoFusion 논문은 멀티모달 비디오 융합이라는 아직 탐구가 미비한 영역에 두 가지 혁신을 동시에 제공한다. 첫 번째는 데이터 측면이다. 적외선과 가시광 센서를 30 FPS, 640×480 해상도로 동기화·정합한 M3SVD는 100여 개의 다양한 시나리오(주간·야간, 저조도·과다노출·위장·폐색 등)를 포함한다. 기존 데이터셋이 정적 이미지 쌍에 국한된 반면, M3SVD는 프레임 간 연속성을 보장하므로 시공간 모델 학습이 가능하다. 데이터 전처리 과정에서 두 센서 간 광축 차이를 동차 변환(Homography) 하나로 보정하고, ReDFeat·XCP‑Match·MAGSAC++를 활용해 고정밀 대응점을 추출해 정밀 정합을 수행했다. 이는 영상 간 기하학적 왜곡을 최소화하고, 차후 네트워크가 순수한 내용적 차이에 집중하도록 만든다.

두 번째는 모델 설계이다. 전체 파이프라인은 3D Conv 로 얕은 시공간 특징을 추출한 뒤, 다중 스케일에서 동일 구조의 모듈을 순차적으로 적용한다. 핵심 모듈은 세 가지로 구분된다. ① Cross‑modal Differential Reinforcement Module (CmDRM) 은 “주모달(예: 가시광) – 보조모달(예: 적외선)” 간 차분 Fᵗ_d = Fᵗ_ir − Fᵗ_vi 를 계산하고, 이를 1×1 Conv 로 키와 값으로 변환한다. 주모달 특징을 쿼리로 삼아 차분 정보를 어텐션 방식으로 가중합함으로써, 보조모달이 제공하는 비중복·보완 정보를 선택적으로 강화한다. 이는 단순한 특징 합치기보다 정보 중복을 억제하고, 각 모달리티의 고유 신호를 살린다. ② Modality‑guided Fusion Module 은 강화된 특징들을 “전체 적외선 + 전체 가시광” 합을 쿼리로 사용해 교차 모달 어텐션을 수행한다. 즉, 두 모달리티의 전체적인 컨텍스트가 각각의 스케일 특징을 재조정하도록 설계돼, 다중 스케일에서 일관된 융합 표현을 만든다. ③ Bi‑temporal Co‑attention (Bi‑CAM) 은 현재 프레임 t와 전후 프레임(t‑1, t+1) 사이에 양방향 어텐션을 적용한다. 전방 어텐션은 미래 프레임의 정보를, 후방 어텐션은 과거 프레임의 정보를 각각 키·값으로 사용해 현재 쿼리와 결합한다. 이렇게 얻어진 시공간 컨텍스트는 Transformer‑based Enhancement Block을 통해 비선형 변환된 뒤, 디코더에 전달돼 고해상도 융합 영상을 복원한다.

또한 논문은 Variational Consistency Loss 라는 정규화 항을 도입해, 양방향 어텐션이 생성한 시공간 특징이 시간적으로 일관되도록 강제한다. 이는 플리커 현상을 억제하고, 영상 전체에 걸쳐 색상·밝기 일관성을 유지하는 데 기여한다.

실험에서는 기존 이미지‑중심 FusionNet, DenseFuse, SeAFusion 등과 비교했을 때 PSNR/SSIM이 평균 2 dB 이상 향상되었으며, 특히 시퀀스 전반에 걸친 Temporal Flicker Index가 40 % 이상 감소했다. 정량적 지표뿐 아니라 정성적 평가에서도 저조도·과다노출 장면에서 적외선이 제공하는 열 정보를 효과적으로 보강해, 가시광만 사용할 때 놓치는 물체 경계와 텍스처를 복원한다.

전체적으로 이 논문은 (1) 대규모 멀티모달 비디오 데이터베이스 제공, (2) 차분 기반 교차모달 강화와 양방향 시공간 어텐션을 결합한 새로운 네트워크 설계, (3) 정량·정성 모두에서 기존 이미지‑중심 방법을 뛰어넘는 성능 입증이라는 세 축을 통해 멀티모달 비디오 융합 연구의 새로운 기준을 제시한다는 점에서 큰 의의를 가진다.

댓글 및 학술 토론

Loading comments...

의견 남기기