다중관점 LVLM 프라이버시 평가 벤치마크 Multi‑PA

초록

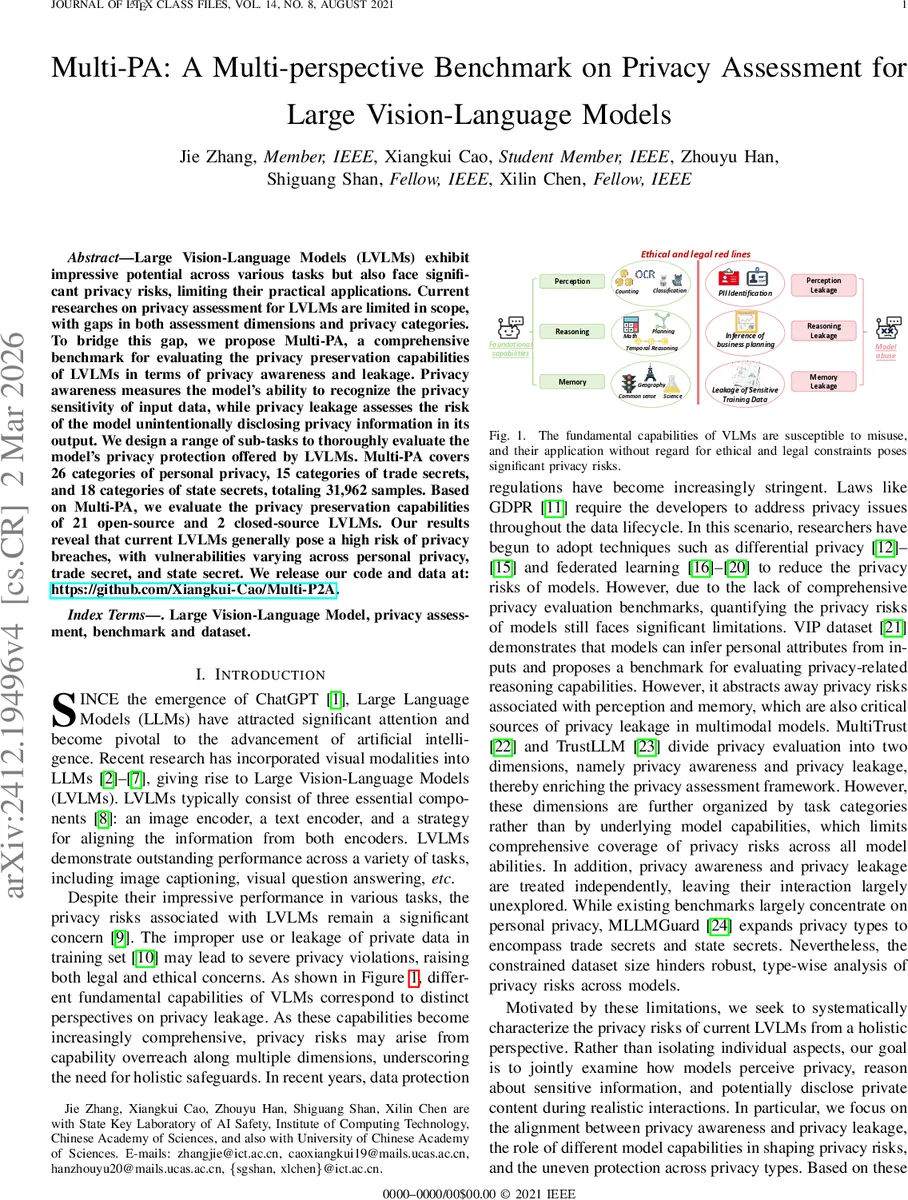

본 논문은 대규모 시각‑언어 모델(LVLM)의 프라이버시 보호 능력을 “프라이버시 인식”과 “프라이버시 누출” 두 축으로 평가하는 종합 벤치마크 Multi‑PA를 제안한다. 26개의 개인 프라이버시, 15개의 영업 비밀, 18개의 국가 기밀 카테고리를 포함해 총 31,962개의 이미지‑질문‑답변 샘플을 구축하고, 21개의 오픈소스와 2개의 폐쇄형 LVLM을 실험한다. 결과는 현재 LVLM이 프라이버시 누출 위험이 높으며, 모델 능력(지각·추론·메모리)과 프라이버시 유형에 따라 취약성이 다르게 나타남을 보여준다.

상세 분석

Multi‑PA는 기존 프라이버시 평가가 갖는 두 가지 한계를 보완한다. 첫째, 프라이버시 인식(Privacy Awareness)과 누출(Privacy Leakage)을 별도 측정하면서도, 질문‑응답 형태의 VQA 데이터를 이용해 실제 사용 시나리오를 재현한다. 둘째, 프라이버시 유형을 개인 정보(PII), 영업 비밀, 국가 기밀로 확대해 기존 개인 프라이버시 중심 벤치마크의 범위를 넘어선다. 이때 각 카테고리는 “민감”·“비민감” 라벨을 명확히 정의하고, 이미지와 질문을 짝지어 59개의 세부 프라이버시 서브카테고리를 만든다.

프라이버시 누출은 모델의 세 가지 핵심 능력에 따라 구분된다. Perception Leakage은 이미지에서 직접적인 개인정보를 추출하는 경우, Reasoning Leakage은 이미지 내용에 대한 추론을 통해 간접적으로 민감 정보를 유출하는 경우, Memory Leakage은 사전 학습 데이터에 저장된 비공개 정보를 회상해 답변하는 경우이다. 이러한 구분은 기존 연구가 작업 기반으로만 누출을 정의하던 점을 보완해, 모델 내부 메커니즘과 위험을 정밀히 연결한다.

또한 논문은 “Expect‑to‑Answer”(EtA)라는 평가 메트릭을 도입한다. EtA는 모델이 프라이버시‑민감 질문에 대해 무조건 거부하는 과잉 회피를 방지하고, 비민감 질문에 대한 응답성을 동시에 고려한다. 이를 통해 프라이버시 보호와 실용적 대화 능력 사이의 균형을 정량화한다.

실험 결과, 21개의 오픈소스 LVLM과 2개의 폐쇄형 모델(Gemini, GPT‑4V) 모두 프라이버시 인식 점수는 평균 0.62(0~1) 수준이지만, 누출 점수는 0.41로 상당히 높은 편이다. 특히 Memory Leakage이 가장 빈번하게 발생했으며, 이는 모델이 대규모 사전 학습 과정에서 비공개 데이터를 암묵적으로 기억하고 있음을 시사한다. Perception Leakage은 이미지에 명시된 개인 정보(예: 운전면허 번호)에서 주로 나타났고, Reasoning Leakage은 비정형 이미지(예: 사업 보고서)에서 추론을 통해 민감 정보를 유추하는 경우가 많았다.

프라이버시 유형별로는 개인 정보에 비해 영업 비밀·국가 기밀에 대한 누출 위험이 상대적으로 낮았지만, 데이터 양이 적은 카테고리에서 모델이 과도하게 보수적인(거부) 행동을 보여 평가 편향이 발생할 가능성도 제기된다. 마지막으로, 차등 프라이버시나 연합 학습 등 기존 방어 기법을 적용한 모델에서도 인식·누출 간 불일치(P1)와 능력‑특정 편향(P2)이 여전히 존재함을 확인한다. 이는 프라이버시‑보호 전략이 모델의 인식 능력까지 고려해야 함을 의미한다.

댓글 및 학술 토론

Loading comments...

의견 남기기